《MATLAB神经网络编程》 化学工业出版社 读书笔记

第四章 前向型神经网络 4.3 BP传播网络

本文是《MATLAB神经网络编程》书籍的阅读笔记,其中涉及的源码、公式、原理都来自此书,若有不理解之处请参阅原书

本文讲述BP网络常用的两个例子:函数逼近与噪声消除

【例4-34】利用一个单隐层的BP网络来逼近一个函数。

通过对函数进行采样得到了网络的输入变量P和目标变量T,在M文件中输入以下命令:

P=-1:0.1:1;

T=[-0.9602 -0.5770 -0.0729 0.3771 0.6405 0.6600 0.4600 0.1336 -0.2013 -0.4344 -0.5000...

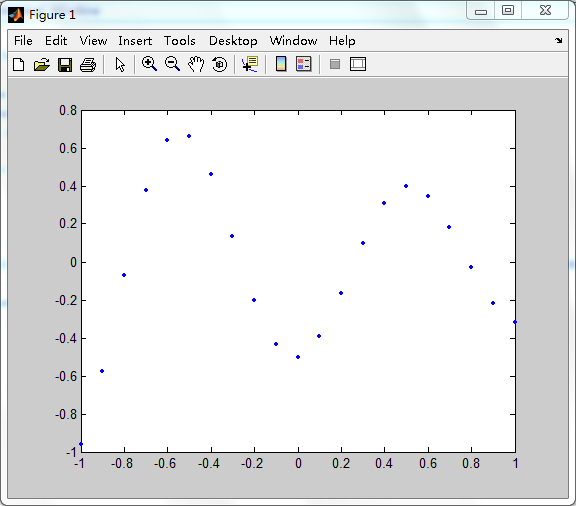

-0.3930 -0.1647 0.0988 0.3072 0.3960 0.3449 0.1816 -0.0312 -0.2189 -0.3201];每组向量都有21组数据,可以将输入向量和目标向量绘制在一起,如下图:

该网络的输入层与输出层的神经元个数均为1,根据以上的隐含层设计经验公式(时间久了,不记得这个公式在哪里了),以及考虑本例的实际情况,解决该问题的网络的隐层神经元个数应该在3~8之间。因此,下面设计一个隐含层神经元数目可变的BP网络,通过误差比,确定最佳的隐含层神经元个数,并检验隐含层神经元个数对网络性能的影响。

在M文件中输入命令:

P=-1:0.1:1;

T=[-0.9602 -0.5770 -0.0729 0.3771 0.6405 0.6600

本文是基于《MATLAB神经网络编程》的读书笔记,介绍了如何使用BP神经网络进行函数逼近和噪声消除。在函数逼近案例中,通过调整隐层神经元数量,发现隐层神经元为8时网络表现最优,误差最小。而在噪声消除案例中,BP网络成功地从字母M上移除了随机噪声,展示了其在字符识别中的潜力。

本文是基于《MATLAB神经网络编程》的读书笔记,介绍了如何使用BP神经网络进行函数逼近和噪声消除。在函数逼近案例中,通过调整隐层神经元数量,发现隐层神经元为8时网络表现最优,误差最小。而在噪声消除案例中,BP网络成功地从字母M上移除了随机噪声,展示了其在字符识别中的潜力。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?