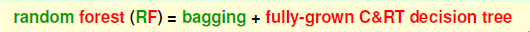

用Bagging的方式把一堆Decision Tree合起来---Random Forest

优点:

1. Bagging部分平行化,学习比较高效。

2. 继承了CART---DecisionTree的高效,继承了CART能处理多种class,多种特征(那几种?)。

3. 消除了CART对资料太敏感,容易overfit的缺陷。

---------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

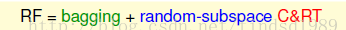

Bagging:

1.

1. 每次从总特征中选出一部分特征子集 ,即投影操作。

2. 特征子集基础上再re-sample,得到subspace,根据subspace里的特征进行切割,获得“小区”。

3. Bagging可以应用到除了CART外的其他算法中。

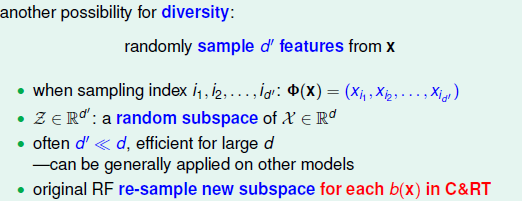

2.

注:P为投影矩阵,X为特征矩阵。

1.,Pi为投影向量。

2.通常选择的投影方式

即在Pi中只有相对较少个非零组成元素。(每次投影很少量的特征来进行切割)。

3.?

4.每一次要做Branch的时候都用一次新的。

Ps :1.random不仅存在于Bagging过程中,也存在于CART的每一次Branch中。

2. Fun time:

Q:

A:

每次Branch过程和感知机比较类似。

5188

5188

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?