现实痛点

DeepSeek作为最快流行的工具(7天破亿用户),使用者众多,所以经常会遇到使用时,弹出“服务器繁忙,请稍后再试” 提示。如何可以流畅使用满血版的DeepSeek成了刚需,所以我们给出一个不错的方案,同时附有实现案例,以飨读者。

解决方案

1、使用腾讯云大模型知识引擎

参考官方的说明文档,可以使用腾讯云大模型知识引擎(LLM Knowledge Engine),进行产品体验,新用户有50万token的免费额度,对于日常应用足够了。

2、发布自己的应用

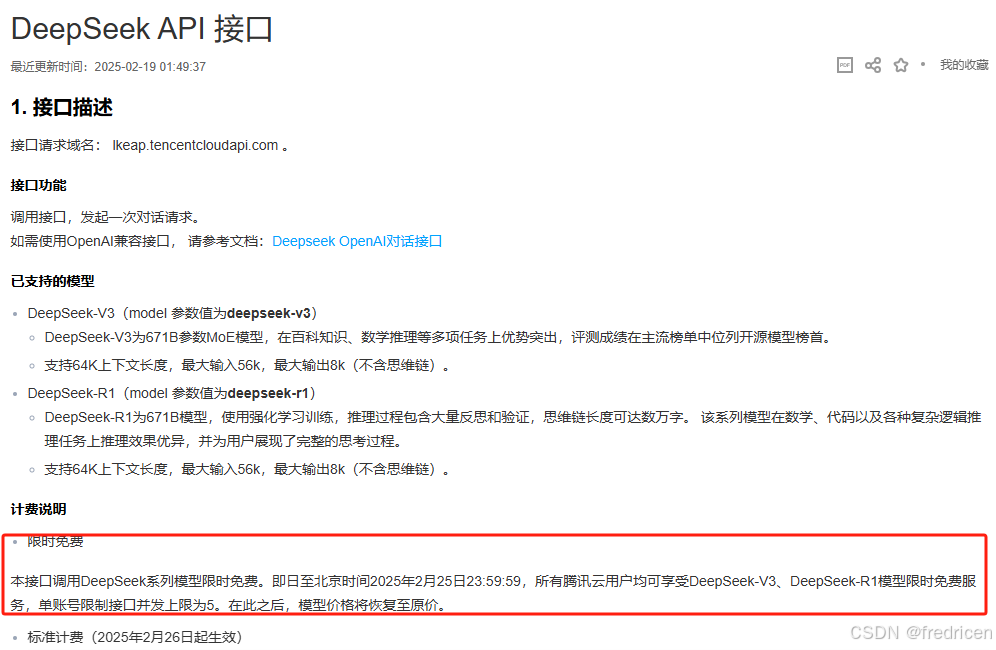

在腾讯云大模型知识引擎平台,可以创建应用,选择指定的模型,我们就选择DeepSeek R1,然后其余设置保持默认,直接发布,就可以用API的方式进行调用接口。推荐使用这种方式,因为有免费期(即日到2025.2.25):

3、开发自己的小助手

腾讯大模型知识引擎提供了官方的示例

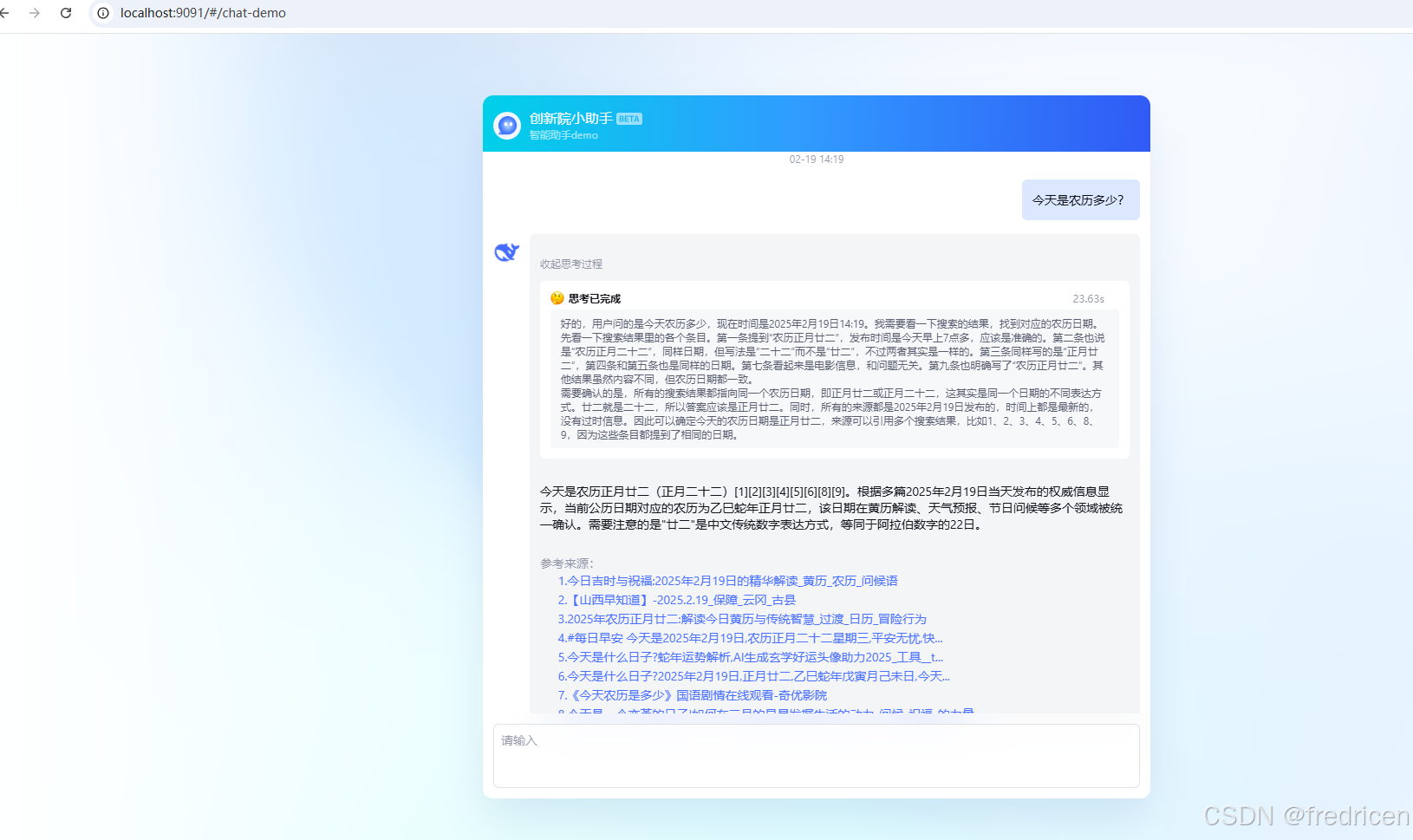

我们选择JS版本即可,默认提供的版本是不带思维过程和参考列表的,需要自己进行修改,可喜的是,我们已经修改好了(并支持websocket和http两种方式),提供给大家,地址是https://gitee.com/fredricen/tecent-lke-chat-demo。

最后上一张图和一个视频。

ChatDemoUI

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?