Requests基本用法

requests是一个很强大的库,可用于Cookies、登录验证、代理设置等操作。

requests请求网页的方式是get(),代码如下:

import requests

r = requests.get('https://www.baidu.com/')

print(type(r))

print(r.status_code)

print(type(r.text))

print(r.text)

print(r.cookies)

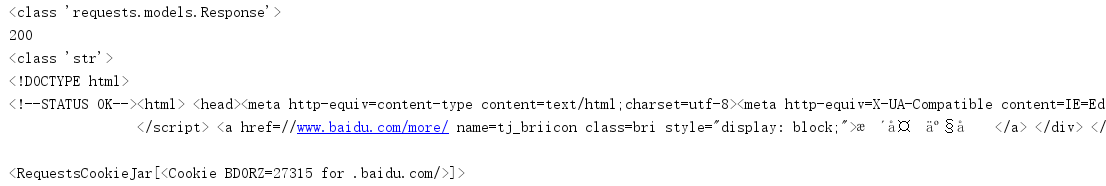

结果如图1:

有结果可以得出结论:get方法得到一个Response对象,然后分别输出了Response的类型、状态码、响应体的类型、内容以及Cookies。

除了get方法,其他的方法也是很方便实现的:

r = requests.post('http://httpbin.org/post')

r = requests.put('http://httpbin.org/put')

r = requests.delete('http://httpbin.org/delete')

r = requests.head('http://httpbin.org/get')

r = requests.options('http://httpbin.org/get')

抓取网页示例

import requests

import re

headers = {

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_11_4) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36'

}

r = requests.get("https://www.zhihu.com/explore", headers=headers)

#正则表达式(需要根据当前时期网站内容而改变,不返回数据,说明正则表达式没有生效)

pattern = re.compile('ExploreSpecialCard-title.*?noreferrer noopener.*?>(.*?)</a>', re.S)

titles = re.findall(pattern, r.text)

print(titles)

该段代码是我们通过构造headers信息,其中包含User-Agent字段信息,也就是浏览器标识信息。如果不加这个,知乎会禁止抓取。

通过简单的正则表达式获取返回信息中的部分我们所需要的数据。(不懂的可以去菜鸟教程上看看:正则表达式 - 教程)

网站建设在网站生命周期里都会进行的,版面设计更新之后相应的正则表达式也会失效,要根据当前时间段,我们所获取的数据,来进行筛选,正则表达式才能发挥作用。

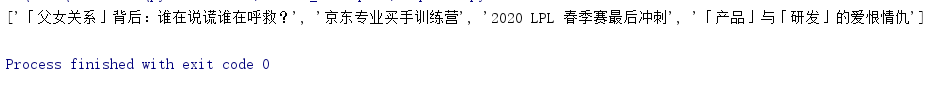

返回结果如图2:

图3是当时的网页:

请关注个人公众号:

1719

1719

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?