1,同步时间

上网找一个最新的时间服务器,同步时间,保证整个集群的每台机器时间都一样。

yum install ntp //在各个节点安装ntp命令

ntpdate ntp1.aliyun.com //同步时间

2,配置免密登录

node01-->node01

node01-->node02

node01-->node03

node01-->node04

命令操作

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa //现在node01节点生成公钥

//在node01节点执行,将node01的公钥分别发送给其他节点

ssh-copy-id -i ~/.ssh/id_rsa.pub root@node01

ssh-copy-id -i ~/.ssh/id_rsa.pub root@node02

ssh-copy-id -i ~/.ssh/id_rsa.pub root@node03

ssh-copy-id -i ~/.ssh/id_rsa.pub root@node04

检验ssh免密是否成功

ssh+ip

ssh 192.168.23.130

3,配置JDK(和window相似)

在所有节点配置JDK运行环境

①两种上传文件方式:FTP、RZ,将jdk安装包上传到每一个节点上。

rz安装命令

yum -y install lrzsz

rz //上传文件

②解压缩,找合适的文件位置存放

tar -zxvf jdk-8u151-linux-x64.tar.gz /usr/local

③配置环境变量

#接着需要配置JAVA环境变量.

vim ~/.bashrc

# 在文件最后添加

export JAVA_HOME=/usr/local/jdk-9.0.1-1

export PATH=$JAVA_HOME/bin:$PATH

# 接下来需要使用source命令是环境变量生效.

source ~/.bashrc

④检验jdk是否安装成功

java -version

4,安装hadoop

sudo tar -zxvf hadoop-2.8.2.tar.gz -C /usr/local

# 将hadoop解压到/usr/local

sudo mv hadoop-2.8.2 hadoop

# 将文件夹重命名为hadoop(可选,方便后续添加环境变量)

5,hadoop相关文件配置

①配置环境变量

vim ~/.bashrc

# 在文件最后添加:

export HADOOP_HOME=/usr/local/hadoop

export HADOOP_INSTALL=$HADOOP_HOME

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export YARN_HOME=$HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin

# 保存推出 :wq

# 使用source命令,是环境变量生效.

source ~/.bashrc

②修改hdfs-site.xml配置文件

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>node02:50090</value>

</property>

③修改core-site.xml配置文件

<property>

<name>fs.defaultFS</name>

<value>hdfs://node01:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/var/abc/hadoop/cluster</value>

</property>

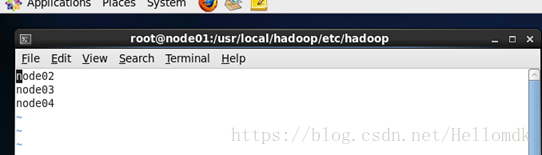

④修改slaves配置文件

node01

node02

node03

⑤将配置好的hadoop安装包发送(同步)到各个节点上

scp -r hadoop root@node02:/usr/local/

scp -r hadoop root@node03:/usr/local/

scp -r hadoop root@node04:/usr/local/

注意:一定要保证每个节点的安装位置一致

6,将所有的HDFS相关的进程关闭

stop-dfs.

7,格式化NameNode

格式化的时候:创建目录以及文件

hdfs namenode -format

8,启动HDFS

start-dfs.sh

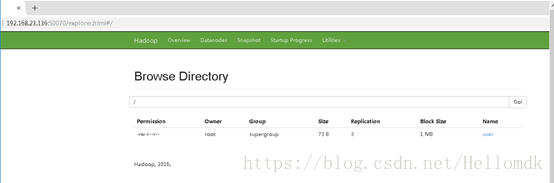

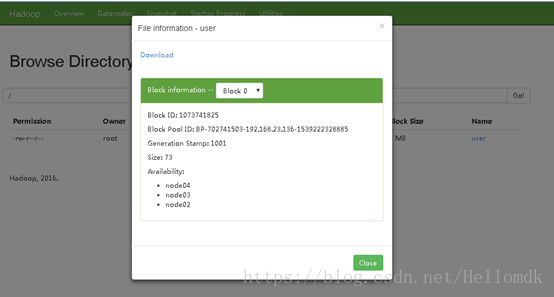

9,操作HDFS文件系统

①创建目录

hdfs dfs -mkdir -p /user/root

②上传文件

hdfs dfs -D dfs.blocksize=1048576 -put /home/node02/hello.txt /user

10,安装过程中可能遇到的问题

①jps查看每个节点的角色都对,但浏览器无法访问?

解决:关闭防火墙

sudo service iptables stop # 关闭防火墙服务。

sudo chkconfig iptables off # 禁止防火墙开机自启。

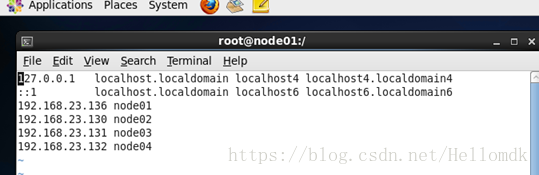

②浏览器可以访问,但存活的节点为0,死亡的节点也为0

原因一:/etc/hosts文件配置出错,没有做每个节点的ip映射

配置如图:

原因二:hadoop配置文件slaves配置出错

配置如图:

原因三:没有配置外网ip,导致几个节点之间无法通信

测试通不通:

ping+ip

配置外网ip命令:

//修改ifcfg-eth0文件

cd /etc/sysconfig/network-scripts/

vi ifcfg-eth0

//修改内容

ONBOOT=yes

BOOTPROTO=none

//添加内容 注意ip要在同一网段

IPADDR=192.168.23.130

PREFIX=24

GATEWAY=192.168.23.2

DNS1=8.8.8.8

//重新启动服务(每次修改完配置文件)

service network restart

原因四:只关了node01的防火墙,其他节点没有关闭

原因五:每次修改配置,note01都要停止服务,但是没有清除所有节点的临时存储文件

(/var/abc/cluster文件),导致重新启动时,集群各个节点的blockId不一致。

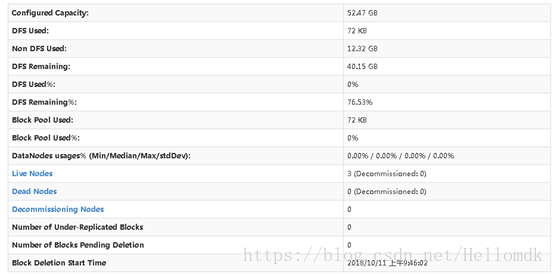

③配置成功图示

如图:存活节点数3,正常运行

2606

2606

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?