Canal简述

Github开源地址:https://github.com/alibaba/canal

MySQL主备复制原理

- MySQL master 将数据变更写入二进制日志( binary log, 其中记录叫做二进制日志事件binary log events,可以通过 show binlog events 进行查看)。

- MySQL slave 将 master 的 binary log events 拷贝到它的中继日志(relay log)。

- MySQL slave 重放 relay log 中事件,将数据变更反映它自己的数据。

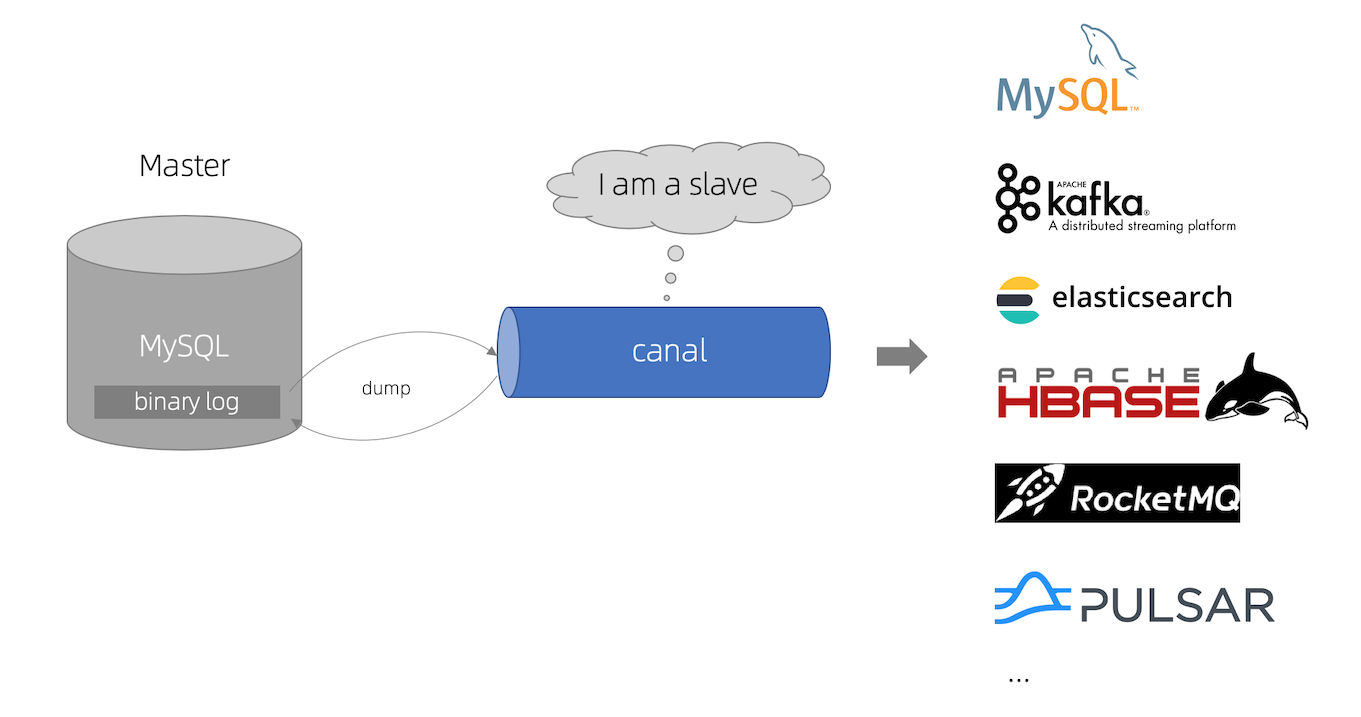

Canal工作原理

- canal 模拟 MySQL slave 的交互协议,伪装自己为 MySQL slave ,向 MySQL master 发送dump 协议。

- MySQL master 收到 dump 请求,开始推送 binary log 给 slave (即 canal )。

- canal 解析 binary log 对象(原始为 byte 流)。

Canal服务范围

- 当前Canal支持源端MYSQL的版本包括:5.1.x、5.5.x、5.6.x、5.7.x、8.0.x。

- Canal直接支持的写入目标类型包括:MYSQL、Kafka、elasticsearch、Hbase、RocketMQ等。由于Datahub直接支持Kafka协议的写入,所以Canal服务也可以支持往Datahub中写入Binary Log数据。

Canal消费方式

Canal在伪装成为目标MySQL的一个Slave节点后,获取到来自主节点的BinaryLog日志内容。那么作为BinaryLog消费者该如何使用canal监听得到的内容呢。Canal为我们提供了两种类型的方式,直接消费和投递。直接消费即使用Canal配套提供的客户端程序,即时消费Canal的监听内容。投递是指配置指定的MQ类型以及对应信息,Canal将会按照BinaryLog的条目投递到指定的MQ下,再交由MQ为各种消费形式提供数据消费。

Canal客户端消费

Canal官方SDK提供地址:https://github.com/alibaba/canal/wiki/ClientExample

- 消费使用代码摘要与简单说明:

// List<Entry>为一次消费包含的多条BinaryLog数据内容

private static void printEntry(List<Entry> entrys) {

for (Entry entry : entrys) {

if (entry.getEntryType() == EntryType.TRANSACTIONBEGIN || entry.getEntryType() == EntryType.TRANSACTIONEND) {

continue;

}

RowChange rowChage = null;

try {

// 行变动数据存放对象,其中rowDatasList为更新前后数据内容

rowChage = RowChange.parseFrom(entry.getStoreValue());

} catch (Exception e) {

throw new RuntimeException("ERROR ## parser of eromanga-event has an error , data:" + entry.toString(),

e);

}

// 当前BinaryLog动作类型

EventType eventType = rowChage.getEventType();

// entry.getHeader()存放当前变动数据对应的Schema、Table信息

System.out.println(String.format("================> binlog[%s:%s] , name[%s,%s] , eventType : %s",

entry.getHeader().getLogfileName(), entry.getHeader().getLogfileOffset

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1405

1405

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?