一、本机环境

1.硬件环境:

CPU:锐龙5600X

显卡:GTX3070

内存:32G

注:硬件配置仅为博主的配置,不是最低要求配置,也不是推荐配置。该配置下计算速度约为40tokens/s。实测核显笔记本(i7-1165g7)也能跑,速度3tokens/s。

2.软件环境:

Windows系统版本:Win11专业版23H2

Python版本:3.11

Cuda版本:12.3.2

VS版本:VS2022 17.8.3

langchain版本:0.0.352

llama-cpp-python版本:0.2.27

二、安装准备工作

1.模型下载

大模型有很多种格式,比如Meta官网下载的pth格式,Huggingface下载的ggml格式、gguf格式等。(博主最开始下的Meta官网的版本,结果发现langchain框架用不了,走了不少弯路)

langchain框架使用的是gguf格式(老版本则是ggml格式 llama.cpp <= 0.1.48),所以我们在Huggingface上下载gguf格式的模型,下载链接为TheBloke/Llama-2-7B-Chat-GGUF at main (huggingface.co),本文选择的模型为llama-2-7b-chat.Q4_K_M.gguf。

不同模型的大小、硬件需求、计算速度、精度不同,具体区别详见网站的README.md文档。

| 模型名称 | 量化方式 | 模型精度 | 大小 | 最小内存要求 | 备注 |

|---|---|---|---|---|---|

| llama-2-7b-chat.Q2_K.gguf | Q2_K | 2 | 2.83 GB | 5.33 GB | 模型最小, 质量最差 - 不推荐 |

| llama-2-7b-chat.Q3_K_S.gguf | Q3_K_S | 3 | 2.95 GB | 5.45 GB | 模型很小, 质量较差 |

| llama-2-7b-chat.Q3_K_M.gguf | Q3_K_M | 3 | 3.30 GB | 5.80 GB | 模型很小, 质量较差 |

| llama-2-7b-chat.Q3_K_L.gguf | Q3_K_L | 3 | 3.60 GB | 6.10 GB | 模型小, 质量略差 |

| llama-2-7b-chat.Q4_0.gguf | Q4_0 | 4 | 3.83 GB | 6.33 GB | 常规;模型小, 质量很差 - 相比更推荐 Q3_K_M |

| llama-2-7b-chat.Q4_K_S.gguf | Q4_K_S | 4 | 3.86 GB | 6.36 GB | 模型小, 质量稍好 |

| llama-2-7b-chat.Q4_K_M.gguf | Q4_K_M | 4 | 4.08 GB | 6.58 GB | 模型中等, 质量中等 - 推荐 |

| llama-2-7b-chat.Q5_0.gguf | Q5_0 | 5 | 4.65 GB | 7.15 GB | 常规; 模型中等, 质量中等 - 相比更推荐 Q4_K_M |

| llama-2-7b-chat.Q5_K_S.gguf | Q5_K_S | 5 | 4.65 GB | 7.15 GB | 模型大, 质量稍好 - 推荐 |

| llama-2-7b-chat.Q5_K_M.gguf | Q5_K_M | 5 | 4.78 GB | 7.28 GB | 模型大, 质量较好 - 推荐 |

| llama-2-7b-chat.Q6_K.gguf | Q6_K | 6 | 5.53 GB | 8.03 GB | 模型很大, 质量很好 |

| llama-2-7b-chat.Q8_0.gguf | Q8_0 | 8 | 7.16 GB | 9.66 GB | 模型很大, 质量最好 - 不推荐 |

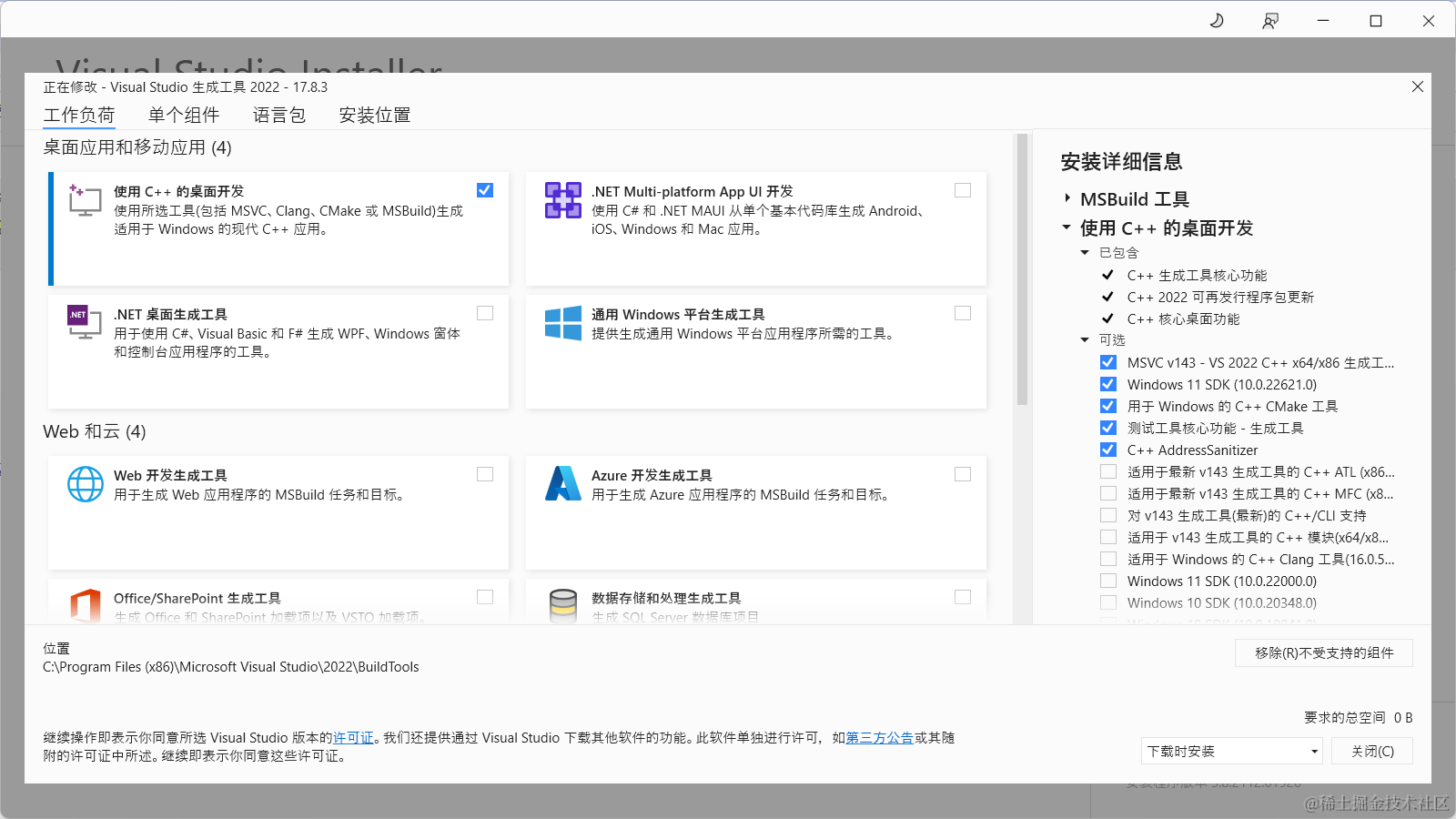

2.VS2022安装

下载Microsoft C++ 生成工具 - Visual Studio,在安装页面勾选使用C++的桌面开发,完成安装。

3.Cuda安装

注:Cuda用于N卡加速模型计算,langchain+llama2支持只用cpu加速,如不用gpu加速可不安装。

下载Cuda完成安装,下载链接CUDA Toolkit 12.3 Update 2 Downloads | NVIDIA Developer

注:后续安装python包llama-cpp-python时可能会遇到No Cuda toolset found问题,需要将Cuda安装包当作压缩包打开,在cuda_12.3.2_546.12_windows.exe\visual_studio_integration\CUDAVisualStudioIntegration\extras\visual_studio_integration\MSBuildExtensions\文件夹中找到以下4个文件,将这4个文件放入VS2022的目录中,博主的路径为C:\Program Files (x86)\Microsoft Visual Studio\2022\BuildTools\MSBuild\Microsoft\VC\v170

4.Python及其余pip包安装

python安装

Python安装方式请查阅其余教程:安装 python at windows - PanPan003 - 博客园 (cnblogs.com)

langchain安装

打开powershell,输入以下命令安装langchain框架

pip install langchain

llama-cpp-python安装

由于我们要用cuda加速模型计算,安装llama-cpp-python前需要配置powelshell环境,使llama-cpp-python启用cuda。如果仅用cpu跑模型,可不输入此行代码,不同配置的详细说明参照abetlen/llama-cpp-python:llama.cpp 的 Python 绑定 (github.com)

$env=CMAKE_ARGS="-DLLAMA_CUBLAS=on"

输入以下命令安装llama-cpp-python包

pip install llama-cpp-python

如果之前已经安装过llama-cpp-python,想用不同的配置方式重新安装,需要在配置好环境变量后输入

pip install --upgrade --force-reinstall llama-cpp-python

三、运行代码

请将模型与python代码文件放在同一目录下,或自行修改目录。

from langchain.callbacks.manager import CallbackManager

from langchain.callbacks.streaming_stdout import StreamingStdOutCallbackHandler

from langchain.chains import LLMChain

from langchain.prompts import PromptTemplate

from langchain_community.llms import LlamaCpp

template = """Question: {question}

Answer: Let's work this out in a step by step way to be sure we have the right answer."""

prompt = PromptTemplate(template=template, input_variables=["question"])

# Callbacks support token-wise streaming

callback_manager = CallbackManager([StreamingStdOutCallbackHandler()])

n_gpu_layers = 40 # Change this value based on your model and your GPU VRAM pool.

n_batch = 512 # Should be between 1 and n_ctx, consider the amount of VRAM in your GPU.

# Make sure the model path is correct for your system!

llm = LlamaCpp(

model_path="llama-2-7b.Q4_K_M.gguf",

n_gpu_layers=n_gpu_layers,

n_batch=n_batch,

callback_manager=callback_manager,

verbose=True, # Verbose is required to pass to the callback manager

)

llm_chain = LLMChain(prompt=prompt, llm=llm)

question = "What NFL team won the Super Bowl in the year Justin Bieber was born?"

llm_chain.run(question)

如何系统的去学习AI大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

阶段1:AI大模型时代的基础理解

- 目标:了解AI大模型的基本概念、发展历程和核心原理。

- 内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践 - L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

- 目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

- 内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例 - L2.2 Prompt框架

- L2.2.1 什么是Prompt

- L2.2.2 Prompt框架应用现状

- L2.2.3 基于GPTAS的Prompt框架

- L2.2.4 Prompt框架与Thought

- L2.2.5 Prompt框架与提示词 - L2.3 流水线工程

- L2.3.1 流水线工程的概念

- L2.3.2 流水线工程的优点

- L2.3.3 流水线工程的应用 - L2.4 总结与展望

- L2.1 API接口

阶段3:AI大模型应用架构实践

- 目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

- 内容:

- L3.1 Agent模型框架

- L3.1.1 Agent模型框架的设计理念

- L3.1.2 Agent模型框架的核心组件

- L3.1.3 Agent模型框架的实现细节 - L3.2 MetaGPT

- L3.2.1 MetaGPT的基本概念

- L3.2.2 MetaGPT的工作原理

- L3.2.3 MetaGPT的应用场景 - L3.3 ChatGLM

- L3.3.1 ChatGLM的特点

- L3.3.2 ChatGLM的开发环境

- L3.3.3 ChatGLM的使用示例 - L3.4 LLAMA

- L3.4.1 LLAMA的特点

- L3.4.2 LLAMA的开发环境

- L3.4.3 LLAMA的使用示例 - L3.5 其他大模型介绍

- L3.1 Agent模型框架

阶段4:AI大模型私有化部署

- 目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

- 内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

学习计划:

- 阶段1:1-2个月,建立AI大模型的基础知识体系。

- 阶段2:2-3个月,专注于API应用开发能力的提升。

- 阶段3:3-4个月,深入实践AI大模型的应用架构和私有化部署。

- 阶段4:4-5个月,专注于高级模型的应用和部署。

这份完整版的所有 ⚡️ 大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

全套 《LLM大模型入门+进阶学习资源包》↓↓↓ 获取~

8135

8135

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?