这里我们选用的是docker安装方式

1. 从docker中拉取镜像,Docker 上获取 Elasticsearch,简单到只要向 Elastic Docker 仓库发出 docker pull 命令一样。

docker pull docker.elastic.co/elasticsearch/elasticsearch:7.21.1

由于镜像太大,直接拉取很慢,我这里采用导入的方式

docker load -i es.tar

由于我们需要运行kibana容器,kibana容器需要和es互联,所以需要创建一个network

docker network create es-net

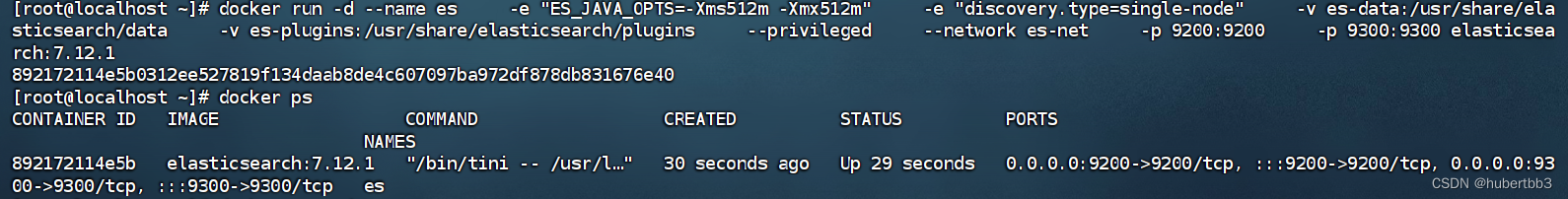

2.运行es,给es-data和es-plugins创建数据卷挂载,方便我们后续修改配置和添加新的插件。

docker run -d \

--name es \

-e "ES_JAVA_OPTS=-Xms512m -Xmx512m" \

-e "discovery.type=single-node" \

-v es-data:/usr/share/elasticsearch/data \

-v es-plugins:/usr/share/elasticsearch/plugins \

--privileged \

--network es-net \

-p 9200:9200 \

-p 9300:9300 \

elasticsearch:7.12.1

3.部署kibana

docker run -d \

--name kibana \

-e ELASTICSEARCH_HOSTS=http://es:9200 \

--network=es-net \

-p 5601:5601 \

kibana:7.12.1

docker logs -f kibana可以查看是否启动成功

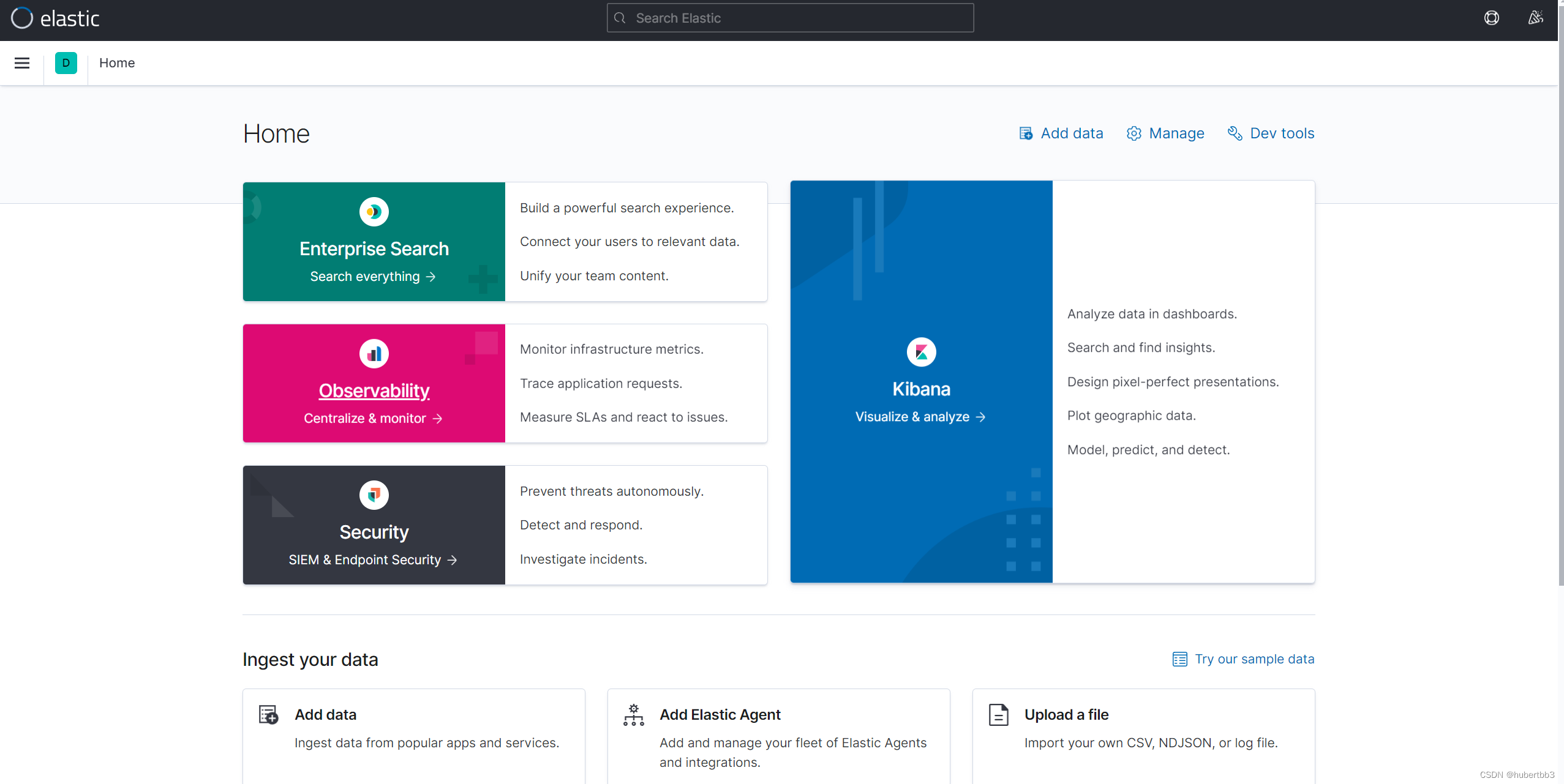

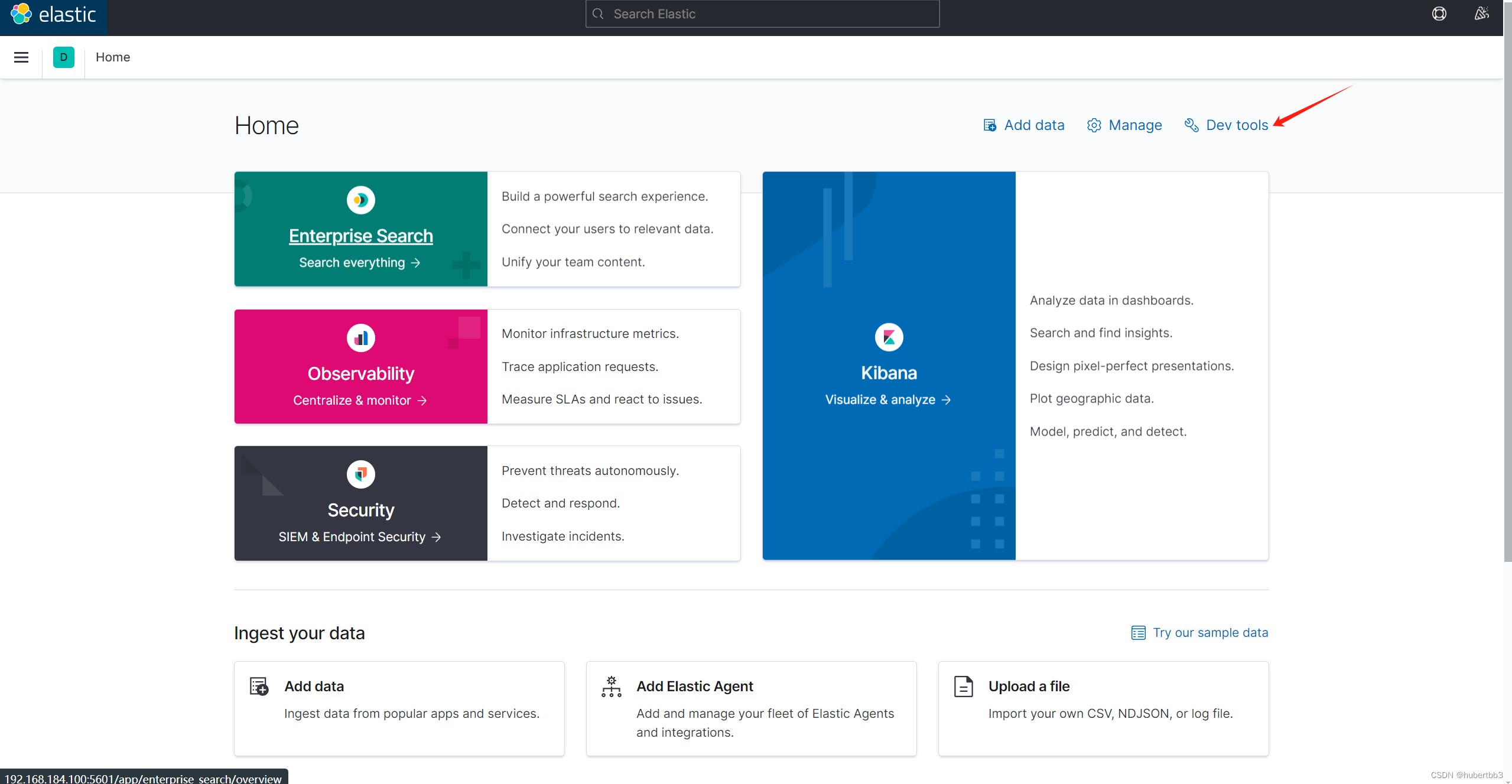

在浏览器输入地址访问:http://192.168.150.101:5601,即可看到结果

4.IK分词器的安装

由于es内置的几个分词器无法满足我们对中文词汇的分词需求,所以在此安装IK分词器

4.1 在线安装

# 进入容器内部

docker exec -it elasticsearch /bin/bash

# 在线下载并安装

./bin/elasticsearch-plugin install https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.12.1/elasticsearch-analysis-ik-7.12.1.zip

#退出

exit

#重启容器

docker restart elasticsearch

4.2.离线安装

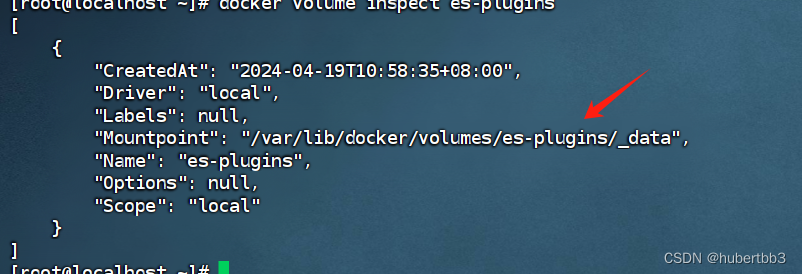

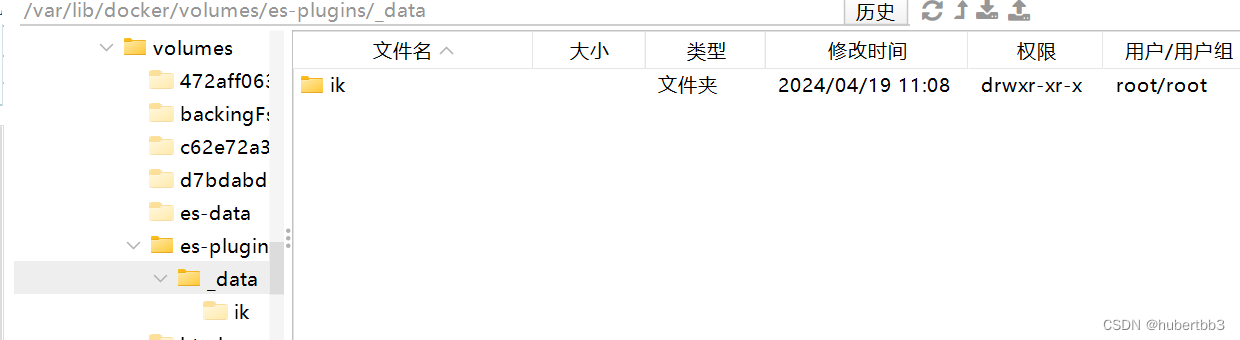

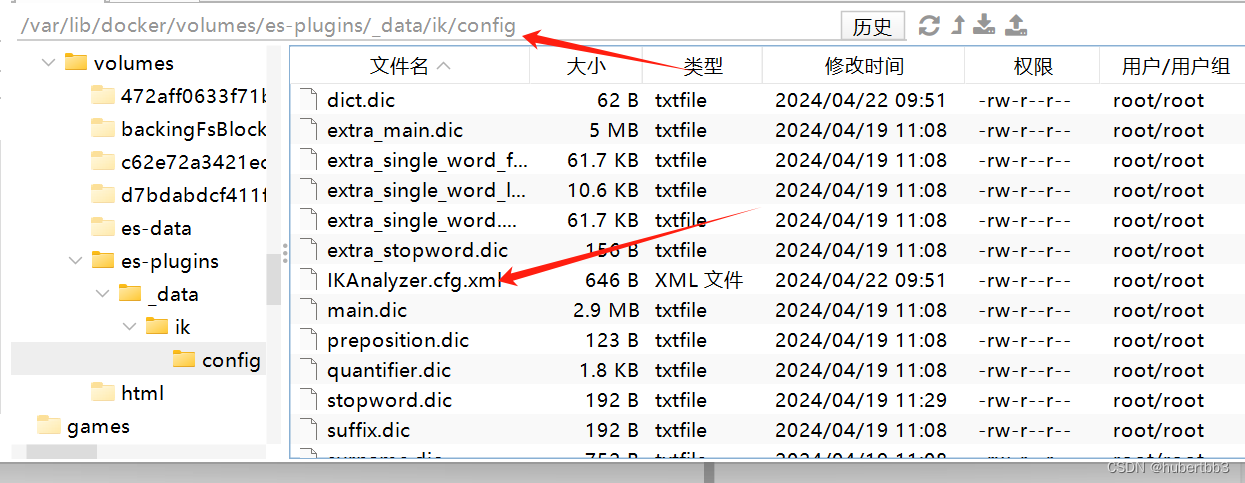

docker volume inspect es-plugins 查看数据卷所在位置

找到对应位置后,上传在网上下载好的IK分词器到_data文件目录下

然后重启容器

docker restart es

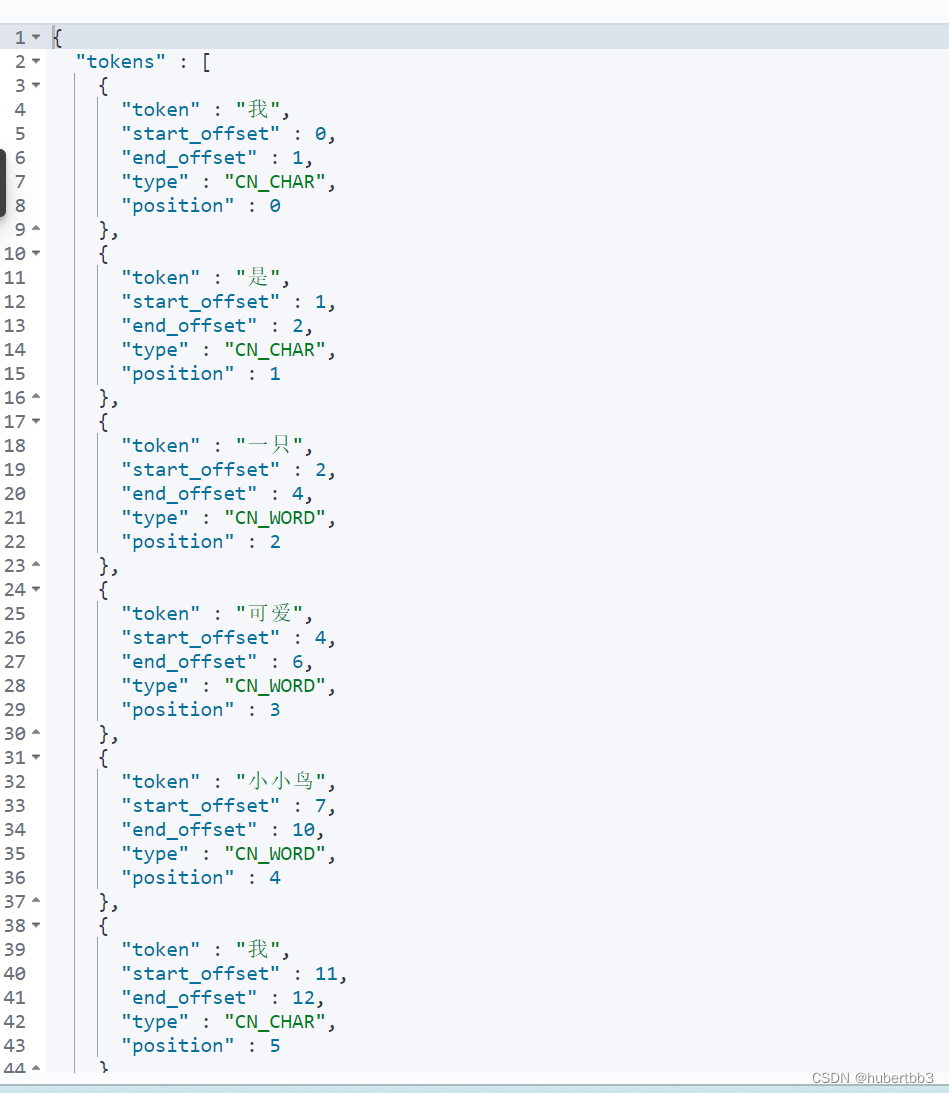

可在指定位置进行测试:

测试:

4.3 扩展词词典

如果有些新的词汇在默认词典中不存在,我们可以通过以下方式进行自定义扩展。

1)打开IK分词器config目录,找到IKAnalyzer.cfg.xml配置文件内容添加:

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典 -->

<entry key="ext_dict">dict.dic</entry>

<!--用户可以在这里配置自己的扩展停止词字典-->

<entry key="ext_stopwords">stopwords.dic</entry>

<!--用户可以在这里配置远程扩展字典 -->

<!-- <entry key="remote_ext_dict">words_location</entry> -->

<!--用户可以在这里配置远程扩展停止词字典-->

<!-- <entry key="remote_ext_stopwords">words_location</entry> -->

</properties>

然后自己新建一个dict.dic和stopwords.dic文件,在文件中添加自己新增或屏蔽词汇就可以了。然后记得重启容器生效。

4207

4207

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?