天天都在开大会,天天都做给老师做ppt。呜呜呜

为什么有的模型大batchsize效果更好?

怎么用小的batchsize模仿大的?一种方法:每n个batchsize 清零一次梯度

pytorch为什么要zerograd: 关于batch normalization和layer normalization的理解_batch normalization 和layer_mishidemudong的博客-CSDN博客xd

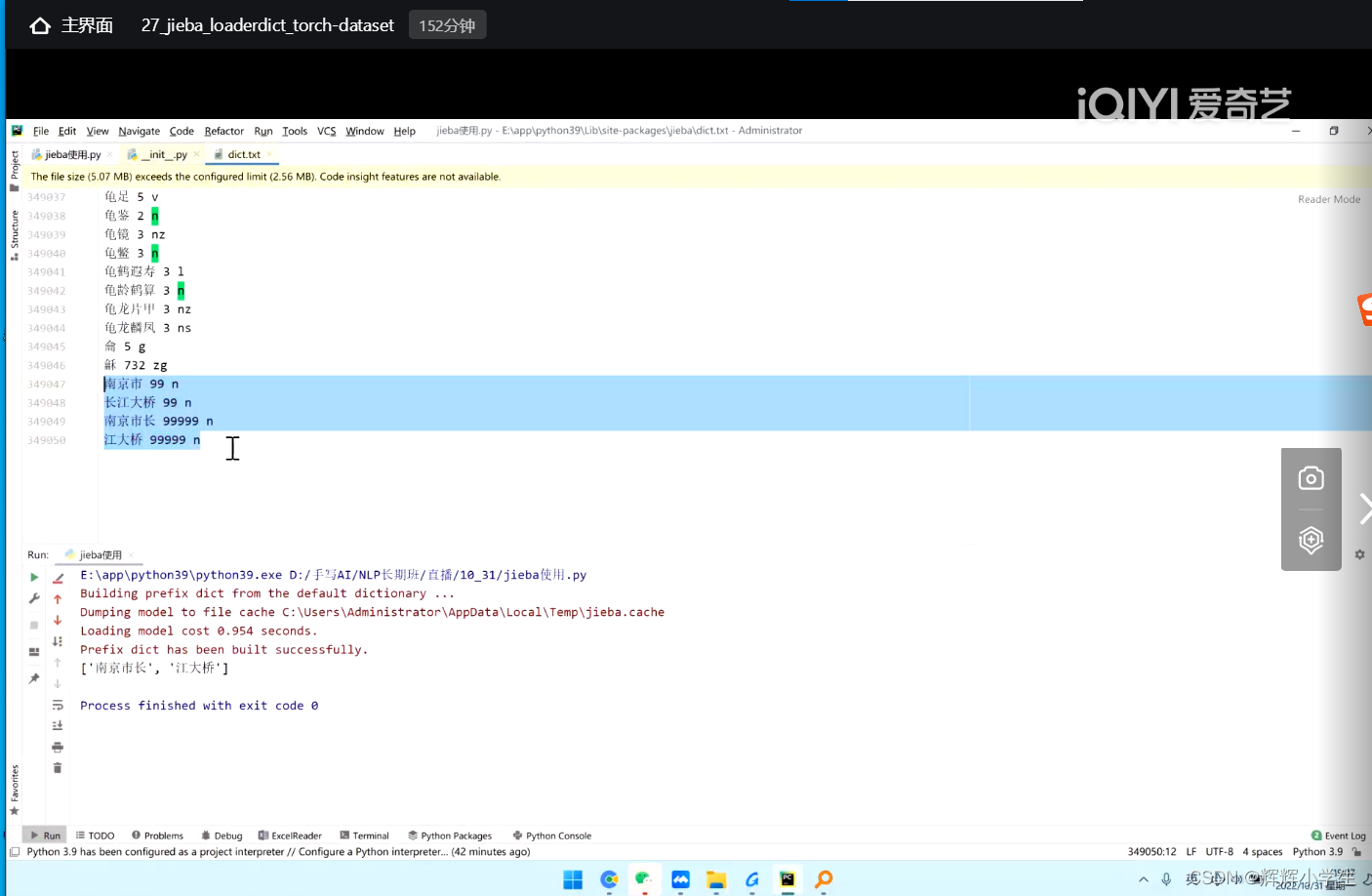

改变jieba源码的txt,来改变词频分布权重,从而影响分词结果,注意,要删掉cache

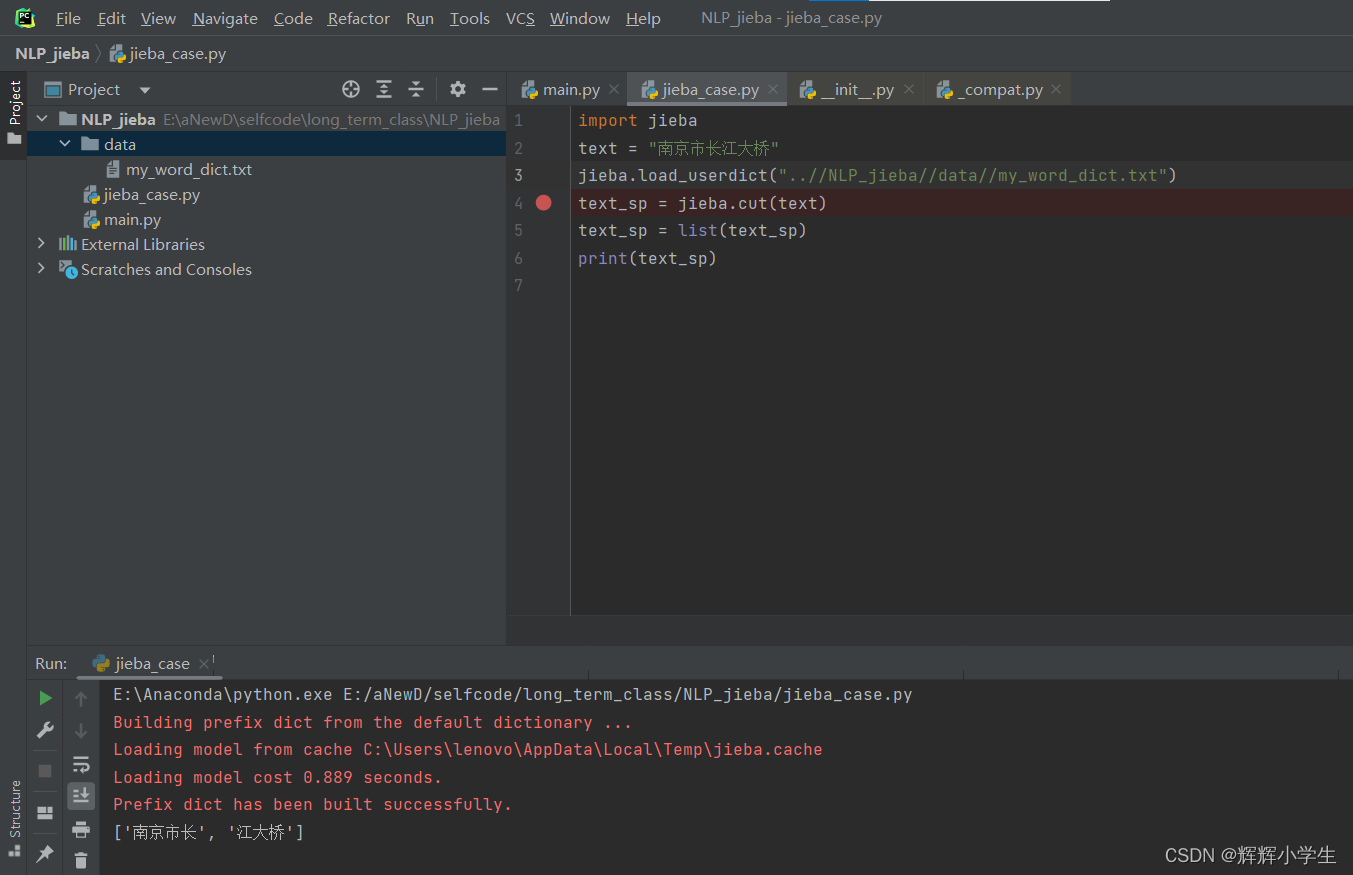

也可以导入自己的权重字典

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?