在Android平台上,若要将MediaStream推送到Web应用,通常涉及使用WebRTC技术,这是一种支持网页浏览器之间进行实时通信(Real-Time Communication, RTC)的开源协议。以下是实现这一功能的基本步骤:

-

配置WebRTC环境

在Web端:确保你的Web应用已经集成了WebRTC库,如adapter.js,用于兼容不同浏览器的WebRTC实现。

在Android端:你可能需要使用诸如libjingle(Google的WebRTC native库的Java封装)或者更现代的库如OpenWebRTC、Jitsi Meet SDK等,这些库提供了与WebRTC兼容的API。 -

获取媒体流(MediaStream)

Android端:使用MediaRecorder或直接通过WebRTC的PeerConnection获取音频和视频流。具体来说,你可以使用getUserMedia API(在JavaScript中,但可以通过WebView桥接调用)或者在原生层通过相应API获取摄像头和麦克风的媒体流。

Web端:同样使用navigator.mediaDevices.getUserMedia来请求访问用户的摄像头和麦克风。 -

建立信令通道

为了协调两端的连接,你需要一个信令通道来交换必要的会话信息,如offer、answer和ICE候选信息。这可以通过WebSocket、XHR轮询或其他任何你能想到的方式来实现。 -

创建RTCPeerConnection

在Android和Web两端都需要创建RTCPeerConnection实例。这是WebRTC的关键组件,负责建立和维护两端的连接。 -

交换SDP信息和建立连接

通过信令通道,Android端将offer SDP发送给Web端,Web端收到后创建answer SDP并回传。同时,双方还需交换ICE候选信息以穿透网络。 -

添加媒体流到RTCPeerConnection

在两端,将获取到的MediaStream添加到各自的RTCPeerConnection实例中。这样就可以开始传输音视频数据了。 -

处理媒体流

在Web端,当媒体流通过RTCPeerConnection到达时,你可以将其附加到DOM元素上显示或处理。 -

注意事项

跨平台兼容性:确保两端的WebRTC实现兼容,尤其是当你使用特定的库或API时。

权限:在Android端,别忘了处理摄像头和麦克风的权限请求。

网络环境:考虑到不同的网络状况,可能需要实施STUN/TURN服务器来协助打洞和穿越NAT。

以上步骤概述了基本流程,实际操作中每个环节都可能涉及到详细的代码实现和调试。如果使用的是特定的WebRTC库,建议查阅其官方文档和示例代码。

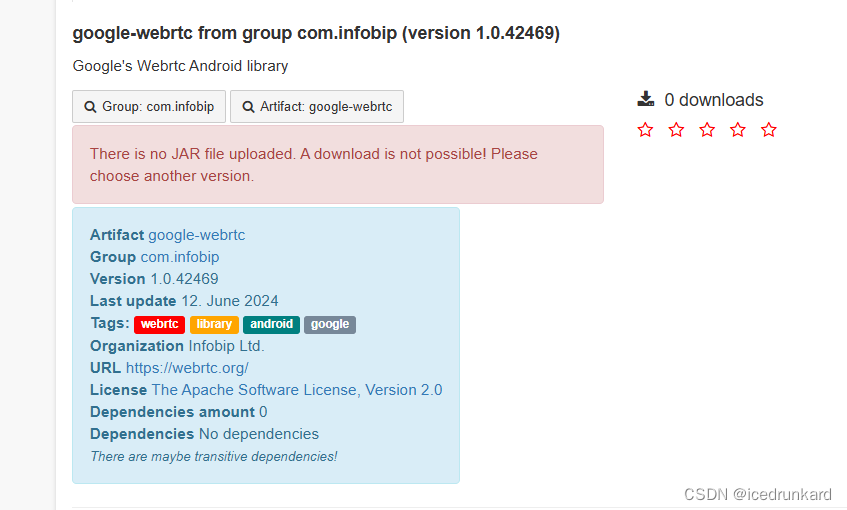

现有的可以使用的安卓端的google-webrtc库下载地址:

https://jar-download.com/artifacts/com.infobip/google-webrtc

这是第三方公司用开源代码自己编译出来的。我们也可以自己编译。

1053

1053

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?