数据科学 8 逻辑回归

主要内容:

- 分类变量之间的相关性检验

- 一元连续变量逻辑回归

- 模型表现优劣的评估

- 包含分类预测变量的逻辑回归

- 因果关系建模与取数逻辑

- 逻辑回归系数求解

8.1 逻辑回归基础

8.1.1 分类变量之间的相关性检验

1、分类变量间的相关性

- 存在相关性:一个分类变量的分布会随着另一个分类变量水平(值)的改变而改变

- 不存在相关性:无论另一个分类变量的水平(值)是多少,这一个变量的分布都相同

2、相关性检验

- 原假设

- 不存在相关性 (则 P ( A B ) = P ( A ) P ( B ) P(AB)=P(A)P(B) P(AB)=P(A)P(B))

- 备择假设

- 存在相关性

3、卡方检验

- 不相关

- 观察频数= 期望频数

- 相关

- 观察频数 ≠ \not= = 期望频数

- 卡方检验和对应的P值

- 确定相关性是否存在

- 不能测量相关性的强弱

- 取决于样本量,并反映样本量。

χ 2 = ∑ i = 1 R ∑ j = 1 C ( O b s i j − E x p i j ) 2 E x p i j \chi^2 = \sum\limits_{i=1}^R\sum\limits_{j=1}^C\dfrac{(Obs_{ij}-Exp_{ij})^2}{Exp_{ij}} χ2=i=1∑Rj=1∑CExpij(Obsij−Expij)2

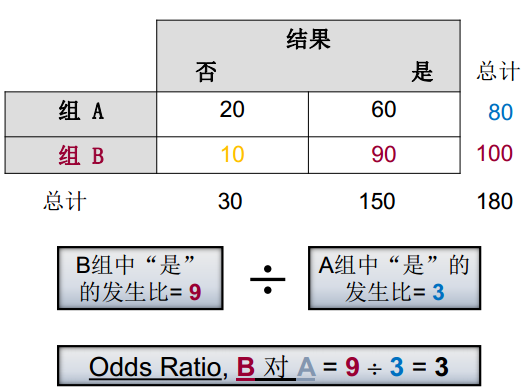

4、优势比(Odds Ratios)

优势比反映了从发生比来看,一个特定事件在一个组发生的可能性相对于在另一个组发生的可能性的大小

O

d

d

s

=

P

e

v

e

n

t

1

−

P

e

v

e

n

t

Odds = \dfrac{P_{event}}{1-P_{event}}

Odds=1−PeventPevent

8.1.2 一元连续变量逻辑回归

内容

- 定义逻辑回归的概念。

- 使用逻辑回归任务拟合一个二元逻辑回归模型。

- 描述一个含有连续预测变量的逻辑回归任务的标准输出。

- 阅读和解释odds ratio 表和图

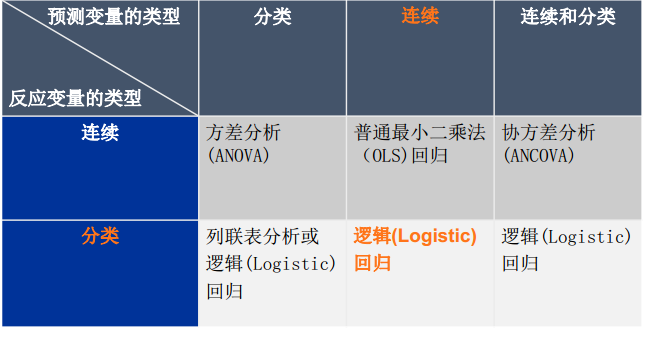

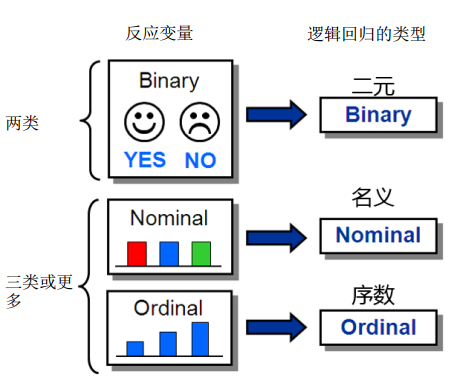

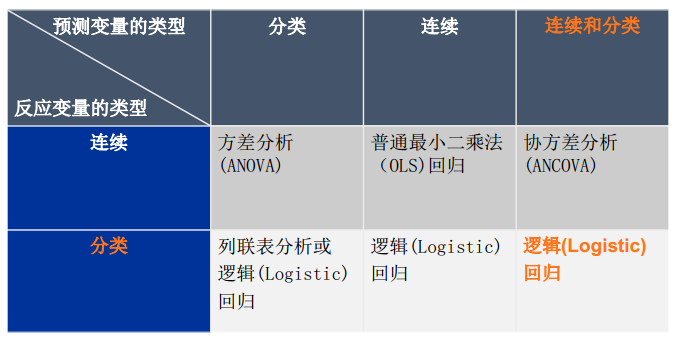

1、逻辑回归的类型

为什么不用最小二乘法回归?

- 反应变量为分类变量,将其编码为1=是、0=否,对于预测结果(0.5、1.1、-0.3)的实际意义无法解释。

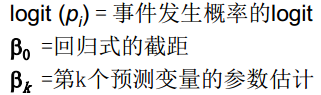

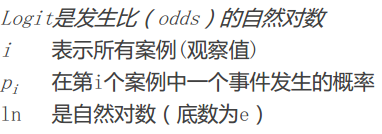

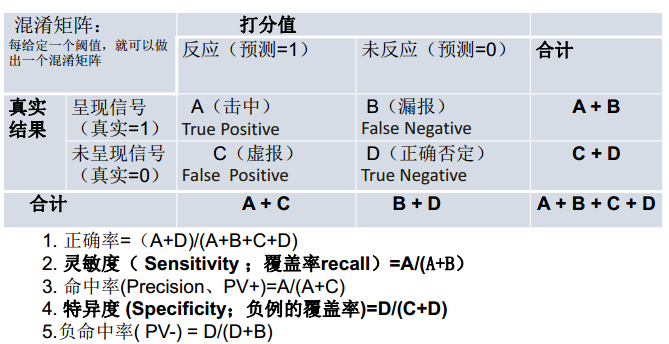

2、逻辑回归模型与Logit 转换

l

o

g

i

t

(

p

i

)

=

β

0

+

β

1

X

1

i

+

⋯

+

β

k

X

k

i

logit(p_i)=\beta_0+\beta_1X_{1i}+ \cdots+\beta_kX_{ki}

logit(pi)=β0+β1X1i+⋯+βkXki

l

o

g

i

t

(

p

i

)

=

l

n

(

p

i

1

−

p

i

)

logit(p_i)=ln(\dfrac{p_i}{1-p_i})

logit(pi)=ln(1−pipi)

示意

8.1.3 模型表现优劣的评估

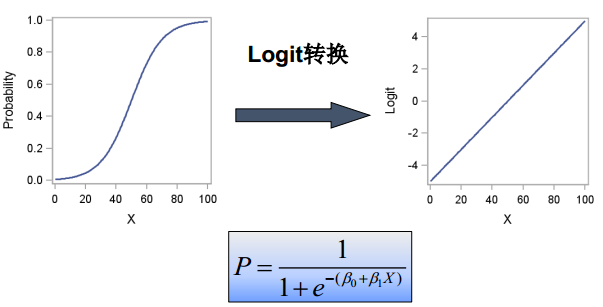

1、模型评估——ROC曲线

ROC(Receiver Operating Characterstic)曲线——接收者操作特征曲线。

最早应用于雷达信号检测领域,用于区分信号与噪声。

信号检测论:在听觉感受性相同的情况下,判断标准不一样。

①冒进:每次出现不会“漏报”,感觉有就报告。

②保守:每次出现不会“虚报”,没有把握不会报告。

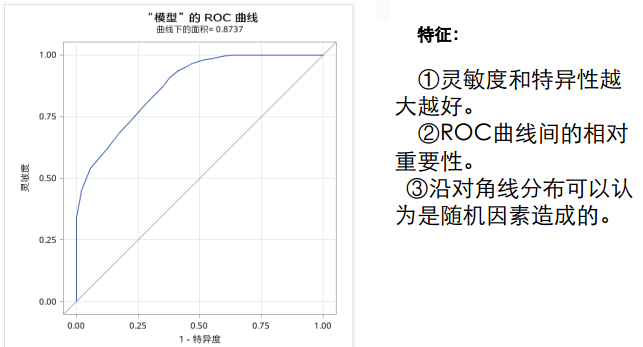

2、混淆矩阵

8.1.4 包含分类预测变量的逻辑回归

1、伯努利分布

P ( Y = y ) = p y ( 1 − p ) 1 − y , y = { 1 , 逾 期 0 , 不 逾 期 P(Y=y)=p^y(1-p)^{1-y} , y=\begin{cases}1,&逾期\\0, & 不逾期 \end{cases} P(Y=y)=py(1−p)1−y,y={1,0,逾期不逾期

2、正则化的逻辑回归

岭回归(L2正则):

min

w

,

c

1

2

ω

T

ω

+

C

∑

i

=

1

n

log

(

e

x

p

(

−

y

i

(

X

i

T

ω

+

c

)

)

+

1

)

\min\limits_{w,c}\dfrac{1}{2}\omega^T\omega+C\sum\limits_{i=1}^n\log(exp(-y_i(X_i^T\omega+c))+1)

w,cmin21ωTω+Ci=1∑nlog(exp(−yi(XiTω+c))+1)

Lasso(L1正则):

min

w

,

c

∣

∣

ω

∣

∣

1

+

C

∑

i

=

1

n

log

(

e

x

p

(

−

y

i

(

X

i

T

ω

+

c

)

)

+

1

)

\min\limits_{w,c}||\omega||_1+C\sum\limits_{i=1}^n\log(exp(-y_i(X_i^T\omega+c))+1)

w,cmin∣∣ω∣∣1+Ci=1∑nlog(exp(−yi(XiTω+c))+1)

2215

2215

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?