这个错误通常与 SSH 配置有关,因为 Hadoop 依赖于 SSH 来管理分布式节点之间的通信。以下是解决这个问题的详细步骤:

解决步骤

1. 安装并启动 SSH 服务

首先,确保在所有节点(包括伪分布式模式下的本地节点)安装并启动 SSH 服务。

安装 OpenSSH 服务:

sudo apt-get update

sudo apt-get install openssh-server启动 SSH 服务:

sudo service ssh start确认 SSH 服务正在运行:

sudo service ssh status![]()

2. 配置 SSH 无密码登录

为了让 Hadoop 能够无密码地使用 SSH 进行节点间通信,需要配置无密码登录。

生成 SSH 密钥对(如果还没有生成的话):

ssh-keygen -t rsa -P ""将公钥添加到 authorized_keys 文件中:

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys修改权限以确保安全性:

chmod 600 ~/.ssh/authorized_keys测试无密码登录:

ssh localhost如果能够成功登录而不需要密码,说明无密码登录配置成功。

3. 配置 Hadoop 的 SSH

确保 Hadoop 可以使用 SSH 来启动和停止 HDFS。

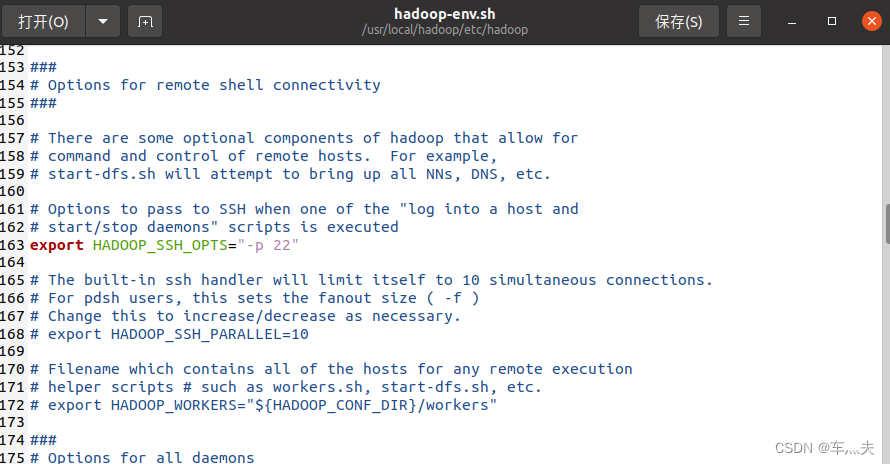

编辑 Hadoop 的 hadoop-env.sh 文件:

sudo nano $HADOOP_HOME/etc/hadoop/hadoop-env.sh在文件中找到 HADOOP_SSH_OPTS,添加以下内容:

保存并关闭文件。

4. 再次尝试启动 HDFS

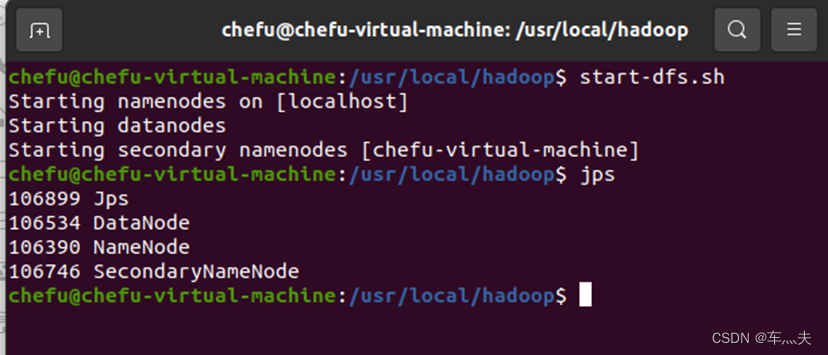

在配置好 SSH 服务并确保无密码登录后,再次尝试启动 HDFS。

启动 HDFS:

start-dfs.sh

检查启动的 Hadoop 进程:

jps

确认进程列表中有 NameNode、DataNode、SecondaryNameNode 等进程。

6045

6045

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?