第三期,做特征工程。

这里给了一个用箱线图去除3倍阶段差之外的异常值的程序,我先放在这里。

def outliers_proc(data, col_name, scale=3):

"""

用于清洗异常值,默认用 box_plot(scale=3)进行清洗

:param data: 接收 pandas 数据格式

:param col_name: pandas 列名

:param scale: 尺度

:return:

"""

def box_plot_outliers(data_ser, box_scale):

"""

利用箱线图去除异常值

:param data_ser: 接收 pandas.Series 数据格式

:param box_scale: 箱线图尺度,

:return:

"""

iqr = box_scale * (data_ser.quantile(0.75) - data_ser.quantile(0.25))

val_low = data_ser.quantile(0.25) - iqr

val_up = data_ser.quantile(0.75) + iqr

rule_low = (data_ser < val_low)

rule_up = (data_ser > val_up)

return (rule_low, rule_up), (val_low, val_up)

data_n = data.copy()

data_series = data_n[col_name]

rule, value = box_plot_outliers(data_series, box_scale=scale)

index = np.arange(data_series.shape[0])[rule[0] | rule[1]]

print("Delete number is: {}".format(len(index)))

data_n = data_n.drop(index)

data_n.reset_index(drop=True, inplace=True)

print("Now column number is: {}".format(data_n.shape[0]))

index_low = np.arange(data_series.shape[0])[rule[0]]

outliers = data_series.iloc[index_low]

print("Description of data less than the lower bound is:")

print(pd.Series(outliers).describe())

index_up = np.arange(data_series.shape[0])[rule[1]]

outliers = data_series.iloc[index_up]

print("Description of data larger than the upper bound is:")

print(pd.Series(outliers).describe())

fig, ax = plt.subplots(1, 2, figsize=(10, 7))

sns.boxplot(y=data[col_name], data=data, palette="Set1", ax=ax[0])

sns.boxplot(y=data_n[col_name], data=data_n, palette="Set1", ax=ax[1])

return data_n

这个程序的话,应该还是有用的,但我之后需要实际试一下,到底去掉异常值能不能提高最终的效果。

现在先不对特征进行异常值去除操作。

现在要处理之前的日期数据,这里用creatDate减去regDate得到一个新的连续特征,命名为used_time

data['used_time'] = (pd.to_datetime(data['creatDate'], format = '%Y%m%d', errors = 'coerce') - \

pd.to_datetime(data['regDate'], format = '%Y%m%d', errors = 'coerce')).dt.days

注意这里的dt是表示时间差,dt.days表示用天做单位表示时间差。

然后看一下新特性与price的相关关系。-0.61,还不错。

还有正态分布的样子。挺好的。

这里教程的作者说脱敏之前他就知道地区码后两位之前的代表城市,所以加入了先验知识。我感觉主要是了解操作某一列数据的办法,这个很有用。

![]()

这样直接用lambda表达式计算并创建新行的方法真的感觉很好。爱了爱了

这里多写一句,如果操作某一列,还可以这样

![]()

真的巨简洁了好吧

接下来提到一个数据分桶的概念,

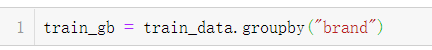

对于这个对象,是一个可迭代的二元组tuple对象,组内第一个元素是种类名,第二个元素是该类下的数据

比如说下图,brand一共0到39种,第一桶就是频数最大的0类,后面就是所有的数据行

然后就是分桶

这样就用一个字典,按照price特征把所有数据分成了0到39一共40桶。

然后把桶的数据加入到了原数据里面,我其实不是很理解这一步。桶的数据真的会有助于我们预测桶内个体的price吗

merge那一步类似于数据库里表的连接,on就是连接的两张表中用于连接的共同的分量

上面是相当于全分桶,分完的所有桶覆盖之前所有的数据

下面做的感觉是部分分桶,可以去除掉分布很少的数据

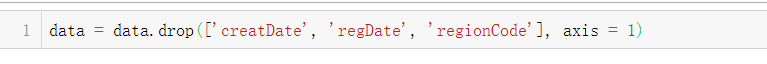

然后就是把没用的特征删掉,比如之前的日期什么的

看其中的power特征分布

没有截断长尾前长这样:

长尾截断后长这样

取log再归一化之后长这样

这种就比较规整,直接归一化就可以

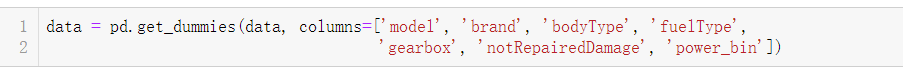

这个函数给某些属性化成one-hot编码

其实我真的怀疑这些分桶加出来的新特征有用吗,,,,

就像我们试图预测学生的体育成绩,然后我们把身高接近的人分了几堆,每堆里都加上该堆人群身高的各种属性,,,这样会有用吗,,,比如brand_amount这个变量,,,跟price有啥关系呢,,

3.4 经验总结

特征工程是比赛中最至关重要的的一块,特别的传统的比赛,大家的模型可能都差不多,调参带来的效果增幅是非常有限的,但特征工程的好坏往往会决定了最终的排名和成绩。

特征工程的主要目的还是在于将数据转换为能更好地表示潜在问题的特征,从而提高机器学习的性能。比如,异常值处理是为了去除噪声,填补缺失值可以加入先验知识等。

特征构造也属于特征工程的一部分,其目的是为了增强数据的表达。

有些比赛的特征是匿名特征,这导致我们并不清楚特征相互直接的关联性,这时我们就只有单纯基于特征进行处理,比如装箱,groupby,agg 等这样一些操作进行一些特征统计,此外还可以对特征进行进一步的 log,exp 等变换,或者对多个特征进行四则运算(如上面我们算出的使用时长),多项式组合等然后进行筛选。由于特性的匿名性其实限制了很多对于特征的处理,当然有些时候用 NN 去提取一些特征也会达到意想不到的良好效果。

对于知道特征含义(非匿名)的特征工程,特别是在工业类型比赛中,会基于信号处理,频域提取,丰度,偏度等构建更为有实际意义的特征,这就是结合背景的特征构建,在推荐系统中也是这样的,各种类型点击率统计,各时段统计,加用户属性的统计等等,这样一种特征构建往往要深入分析背后的业务逻辑或者说物理原理,从而才能更好的找到 magic。

当然特征工程其实是和模型结合在一起的,这就是为什么要为 LR NN 做分桶和特征归一化的原因,而对于特征的处理效果和特征重要性等往往要通过模型来验证。

总的来说,特征工程是一个入门简单,但想精通非常难的一件事。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?