本文没有任何新的想法,体现的是个人的学习笔记,以及目前理解或者关注到的有意思的点。作为产品经理,我的代码实践和理论知识都很匮乏,免不了存在纰漏之处。如果有什么不同意见或者想法的,或是有更好的学习资料和技巧,欢迎交流;如果对文中引用资料有很强烈的异见,请直接写邮件给原作者,谢谢。

00 / 背景

大模型毫无疑问是 2023 年最热门的领域。面对一个如此巨大的风口,自己不由得产生了巨大的困惑:大语言模型真的是无所不能的吗?真的会是下一个风口吗?自己该如何参与?

由此诞生了三个前提条件,促成了本文:

1. 我很想知道在大模型的发展大潮下,产品经理是否还会被未来所需要,这是中年焦虑。

2. 大家言必谈大模型,它究竟真的能带来什么用户价值和商业价值。这是职业敏感。

3. 我发现每过两个月,就会有新的学习资料和发展趋势出现。而我有拖稿的习惯,写得越晚要看要写的东西越多。这是创作者烦躁。

01 / 资料

偶尔看到了一个文章《如何成为初代 AGI 产品经理》,里面有一段关于投身 AI 领域产品经理的困境让我瞬间对文章充满了认同感:他是真的干产品的!

📕 其次,产品经理这个工种本身,就是「胶水」。因为现在模型层没有真正ready,导致产品经理在实际产品研发过程中,还需要做大量连接和胶水作用,技术科普、技术理解与讨论、产品补位、PMO……这些都需要你深入了解技术原理。

文章最吸引我的是其中的学习资料,系统汇总了很多文字、视频的资料,而且来源翔实。来都来了,那就着按照文章的介绍好好学习。

02 / 策略

大语言模型对个人而言,除去大小公司的融资和产品八卦新闻,几乎是一个空白。不想从乱七八糟的资讯开始形成不够客观的认知立场,就要选择值得信赖的最好能有大局观的信息来源。

刚好,前 Tesla AI 高级总监 Andrej Karpathy 回归 OpenAI 并在微软 BUILD 2023 发表了演讲。AK 之前在 Tesla 的 AI DAY 进行过自动驾驶介绍,从演讲语言风格和 Keynote 内容都通俗易懂、趣味性强。从他的演讲开始,于我是最好的选择。

AK 的视频能够对技术实现、关键环节有大致的理解,但对了解技术的边界是不够的。第一性原理出发,了解技术的实现细节,才能知道技术的边界,所以开始看 GPT 的论文。从读书时代,就深知不是读 Paper 的料,找个大神来解读就是最好的。 B 站有亚马逊资深首席科学家李沐的讲解视频,懒人最爱。

题外话说一句,真正任职大企业、作为负责人主导过关键业务的人手把手讲解是一个很粗暴的过滤方式,暂时也没有比他们更权威的技术解读。那些挂着虚头巴脑 Title 、没有任何实操项目的“专家”,奉劝大家少看。

纸上得来终觉浅,绝知此事要躬行。现成的 AIGC 工具就摆在眼前,实践是最好的验证手段。同时由于能体验的很多,反而花多眼乱无从下手。我选取的是与自己工作关联性相对强、通用性比较好的 Midjourney 和 ChatGPT,在工作和生活中强迫自己更多使用。ChatGPT 升级之后直接融合 DALL-E,就取消了 Midjourney 的会员。瞎用也是可以的,实际使用中会发现大语言模型输出的稳定性、准确性和连贯性都堪忧,所以需要去研究各种技巧来提升生产效率。吴恩达的课程有 Python 实操,DAIR.AI 对技巧进行了高度浓缩,都是不错的课程。

从看到《如何成为初代 AGI 产品经理?》这篇文章萌生学习的想法,到本文的撰写,也仅仅过去了2个多月,大语言模型又又又有了更大的发展,OpenAI 也上演完年度宫斗神剧。我终于开始顺着去了解大语言模型未来究竟可能往哪些方向发展,因此回头再去看陆奇 4 月份在奇绩论坛的演讲。恰好,AK 也有了新的演讲分享新的系统化的观点。

03 / 过程

在学习的过程中,我有意识保留了自认为有价值的资料,并进行了粗浅的排序与分类。由于信息量不小,在重新整理文章的时候,又重新学习一遍,力求把资料中最有价值的信息总结出来,这个过程让我对一些知识点又增强了认知和关联。ChatGPT 也能做,但是出来的效果还没有抓住我认为关键的信息。

整体理解

State of GPT

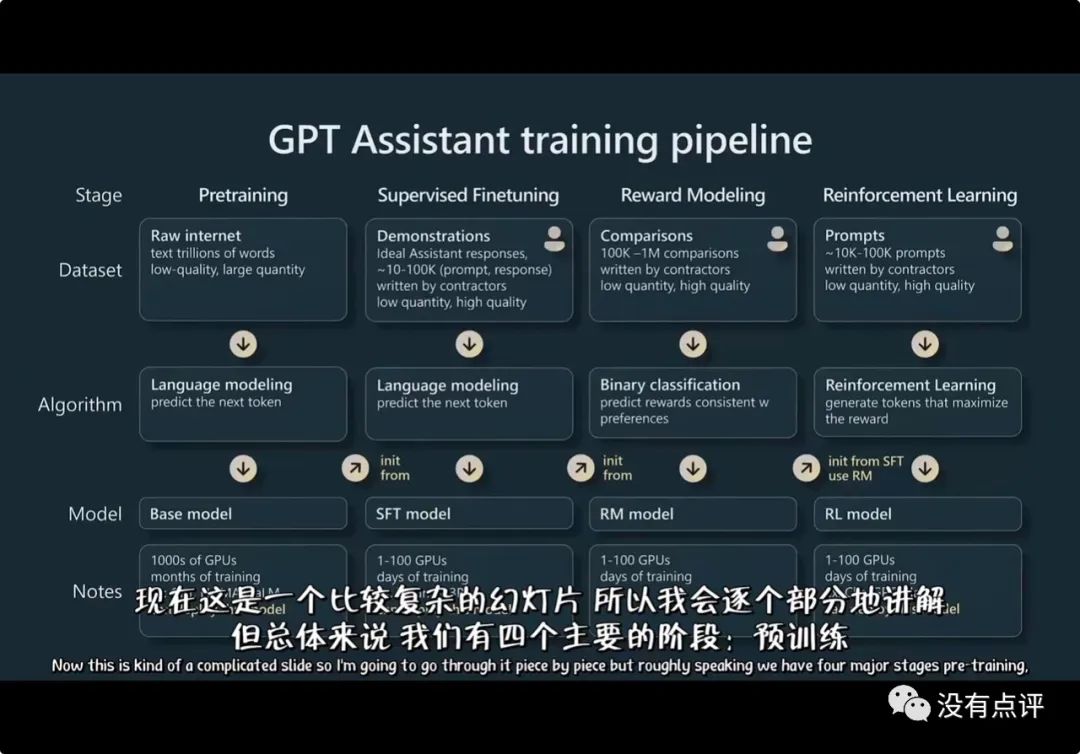

AK 在微软 BUILD 2023 大会的演讲总长 43 分钟,分为两部分:

第一部分是如何练习 GPT 模型助手。看完基本可以对 GPT 如何“制造”有完整的认识,对预训练、微调、RLHF 等名词有概念,对不同的模型分类知道英语缩写的全称,对“力大砖飞”的投入成本有量化感知;

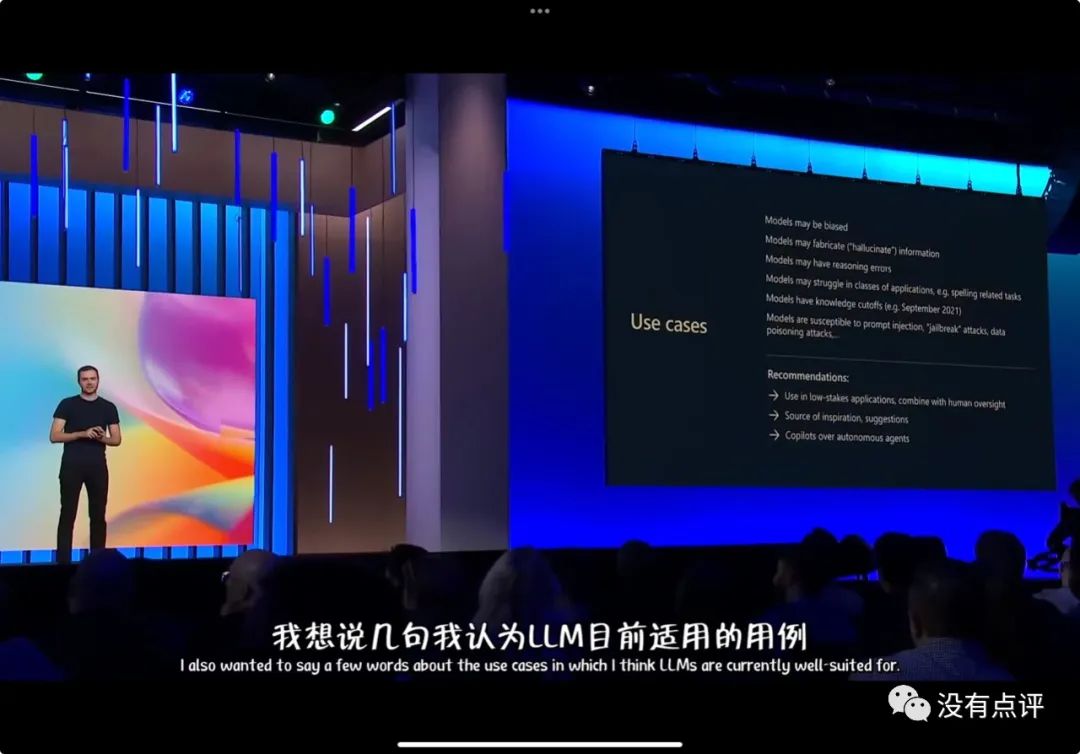

第二部分则是关于如何使用 GPT 模型助手。重点介绍了 GPT 的限制或者说边界(后面他11月的视频对介绍了发展对边界的突破),以及 Prompt 、Plugin 和其他工程的价值就在于引导 GPT 去完成更具有逻辑性的行为,并提供对应的案例和使用技巧。

视频源:https://www.bilibili.com/video/BV1X24y1A7Rz/

What is ChatGPT Doing … and Why Does It Work?

Wolfram 3 万字长文介绍,生动形象地介绍了 ChatGPT 的底层机制,不涉及复杂的公式,绝大部分软件从业者可以轻松食用。ChatGPT 的本质就是基于提供的文本根据内部机制去推测下一个单词(更准确说法应该是 token)。第一次接触到这个概念的时候,对于 GPT 数学不好、证据链不足的认知就豁然开朗了。第二个比较有趣的观点在于在处理人类样式任务的时候,解决更复杂的问题比简单问题要容易(仅技术方案和效果而言,更大的模型工程复杂度和费用投入更大),端到端解决效果更好(不由得想到特斯拉最新的端到端 FSD)。

最后部分关于计算语言的探讨涉及到 Wolfram 自己长期研究的方向,可以作为延伸阅读,看不懂也不影响 ,在我肤浅的理解看来已经有点儿接近数字领域的巴别塔工程。

建议通读一遍这篇文章,对 GPT 的机制有一个大致的了解,细节看不懂也没有关系。然后在了解 GPT 1-3、Transformer 和 GPT-4 的论文后,再回头强化学习,会有不少新感悟。 Wolfram 也做了一款很好用的 ChatGPT 插件,大家有时间可以去玩玩。

-

原文地址:https://writings.stephenwolfram.com/2023/02/what-is-chatgpt-doing-and-why-does-it-work/

-

Web3 天空之城 中文版:《从零解构神经网络和ChatGPT,为什么它有效? : 大神Wolfram 3万字科技雄文》

理论基础 / 技术论文

暴力出奇迹:GPT 1-2-3

当时 GPT-4 已经诞生,为了从根源开始学习,我决定从 GPT-3 开始学习。李沐老师的视频直接从 GPT-1 开始干到 GPT-3,从当时最前沿的 GPT 应用,到和 BERT 的恩怨纠葛发史。最有意思的是,李沐老师是从“如何写好一篇论文/如何阅读一篇论文”的角度切入,把文章中最具有创新性的地方剖析得清清楚楚。

GPT 选择了解决更大的问题,所以导致别人想重复他们的实验很难,导致论文的引用远不如解决更具体问题的 Transformer 和 BERT。

GPT-1:使用 CV 领域很成熟的预训练模型方式通过没有标号的文本数据进行训练,然后在子任务上进行微调,在后续执行任务时不对模型进行调整。GPT-1 还是围绕着分类、蕴含、相似、多选等 NLP 基础问题进行,而且在输入时需要很明确的开始、分隔、抽取符号来区分。

GPT-2:因为 BERT 的存在,方法不能变,简单粗暴堆数据新意度不够。那就只能在泛化性上做尝试,也就是 Zero-Shot ,全方位开火轰炸总能覆盖目标。多少有点儿赌气硬肝肝出意外惊喜狗屎运的感觉。GPT-1 格式化的开始、分隔、抽取符号不再需要,开始向自然语言靠近,Prompt 出现。还有一个好玩的地方是研究员是用 Reddit 的 Karma 来过滤网页的数据集,提取出高质量的网页文本数据集(✅学)。

GPT-3:这篇文章从作者数量和文章长度开始体现真正的力大砖飞。都到1750亿个参数,模型更新成本已经高得离谱,不做微调好像也是自然而然的结果。Prompt 的一些技巧开始在论文中若隐若现,CloseAI 的影子也开始若隐若现,文章大量都是实验的数据结果。数据集的清洗也在继续,继续用 Reddit 的高质量内容对 CommonCrawl 进行筛选;去重相似度高的网页;复用历史的高质量数据;并且数据集来源的权重不一样(✅学 x 2)。

视频源:https://www.bilibili.com/video/BV1AF411b7xQ/

Attention is All You Need : Transformer

GPT-1 提到了使用到了 Transformer 的架构,在 Tesla 的 AI DAY 也听到过该模型,马上触发了寻亲任务,继续往上去寻找 Transformer 的论文解读。没有接着去看 GPT-4,后面发现 GPT-4 已经没有论文(✅CloseAI)。

李沐老师以一种很严谨的方式来一部分一部分解读了整篇论文,甚至包括了作者名单和技术方案取名。

Transformer 是基于机器翻译提出来,但是意想不到具有很不错的泛化性。核心解决的是 RNN 模型无法大规模并行的效率问题。论文有清晰的流程图,加上李沐老师的逐步解释,很好理解。部分技术细节,像 batch_norm 和 layer_norm 的区别,他甚至会展开绘图讲解。

视频源:https://www.bilibili.com/video/BV1pu411o7BE/

是产品介绍页不是论文:GPT-4

没有技术细节,只有案例和功能验证 showcase 秀肌肉,在各种人类社会的考证任务中遥遥领先,加入了视觉输入。GPT-4 在稳定性和可预测性上都有了出乎意料的提升,但是 CloseAI 没解释为什么。微调貌似不能优化大语言模型的结果正确率,但是 RLHF 可以让回答更符合公序良俗,更有“人味儿”。为了更有人味儿,GPT-4 引入了 System Message。顺着前面的论文导读看到这儿的感觉就是:激动地站起来鼓掌,脑子空空荡荡啥都没学到。

视频源:https://www.bilibili.com/video/BV1vM4y1U7b5/

Cookbook

理论学习的同时,实践也要跟上。Prompt 工程领域在 GPT 兴起之后很快就变成热门,专业岗位薪酬水涨船高,垂直教程层出不同。鱼龙混杂之下,打着“速成”“必看”关键词标题的大多是骗子(下意识看一眼文章标题)。关于使用技巧的学习还在持续进行中,后面列的是已经完成的和计划继续进行的资料。

建议课程资料学习和上手实操同时进行,不管是直接用 ChatGPT 还是撸代码。实践是验证自己到底搞懂没的唯一标准。目前我处在有一定的技巧学习,在工作中尝试应用学到的以达到熟练阶段,边学边练,理论学习内容还不够多。

Prompt Engineering:A lecture by DAIR.AI

DAIR.AI 视频质量堪忧,而且演讲者带有一定的口音,字幕也校对得不是很好。不过我强烈推荐,视频较短,浓缩了 Prompt 基础概念介绍、当下热门的技巧及案例讲解(Few-Shot、CoT、Self-Consistency、Knowledge Generation、PAL、ReAct )、常用工具、机会和发展(安全、越狱、RLHF,其他)。具有一定的知识基础之后很容易理解和接受。

视频源:https://www.bilibili.com/video/BV18h411G7eq/

ChatGPT Prompt Engineering for Developers by 吴恩达

吴恩达教学视频拆分为9个章节,层层递进拓展关于 ChatGPT 的核心概念理解,最后以完成一个聊天机器人作为收官,完整性较好。官方的课程网页可以同步进行 Python 代码实操,能够强化对具体实现的理解。官方视频的缺点是没有中文字幕,英文字幕在双屏下可读性不是很好。B站有熟肉可直接食用,缺点是没有了代码实操。

-

官方网站:https://www.deeplearning.ai/short-courses/chatgpt-prompt-engineering-for-developers/

-

B站:https://www.bilibili.com/video/BV1Z14y1Z7LJ/

Learning Prompt 课程 by Jimmy Wong

Learning Prompt 有系统介绍和案例实操,中文友好。如果对之前的理念不太理解,可以通过更多的实践来强化理解。网站会有一些 Prompt 的实例可以进行操作,同时提供一些外部的学习材料可以参考。可以视作一个阶段内的各类相关同行的智慧结晶。

地址:https://learningprompt.wiki/zh-Hans/

后续可能(视我的懒惰程度)进行的

继续围绕官方和官方推荐的资料进行学习,希望他们更新的速度赶得上 OpenAI 的丧心病狂。

-

OpenAI 官方说明:https://platform.openai.com/overview

-

OpenAI 官方推荐(中文友好):https://www.promptingguide.ai/zh

-

OpenAI 官方推荐:https://learnprompting.org/

05 / 前瞻

大模型的发展太过迅速,如果只关注眼前的实现,很可能过段时间就发现努力的内容已是昨日黄花,抬头看天的任务显得尤为重要。我也在寻找以一种相对宏观的视角来不断刷新认知,目前能做的就是紧跟最前沿领军人物的认知分享。

The busy person’s intro to LLMs

AK 在11月又在 Scale AI 进行了一次内部分享,然后个人重新录制了一版上传到网上。演讲的主题还是面向普通人介绍 LLM,过去半年,AK 在 LLM 的描述(也可以视作他的理解)又有了更宏观更前沿的认知。后续 ChatGPT 的一系列新能力也反向印证他们正在朝着该方向前进。其中最震撼我的是 AK 把 LLM 类比或者是定义为新的操作系统,既因为和自己的工作领域相关,也因为该想法把 LLM 的未来真正具像化用我可以想象的方式表现出来。

视频源:https://www.bilibili.com/video/BV1Hj41177fb/

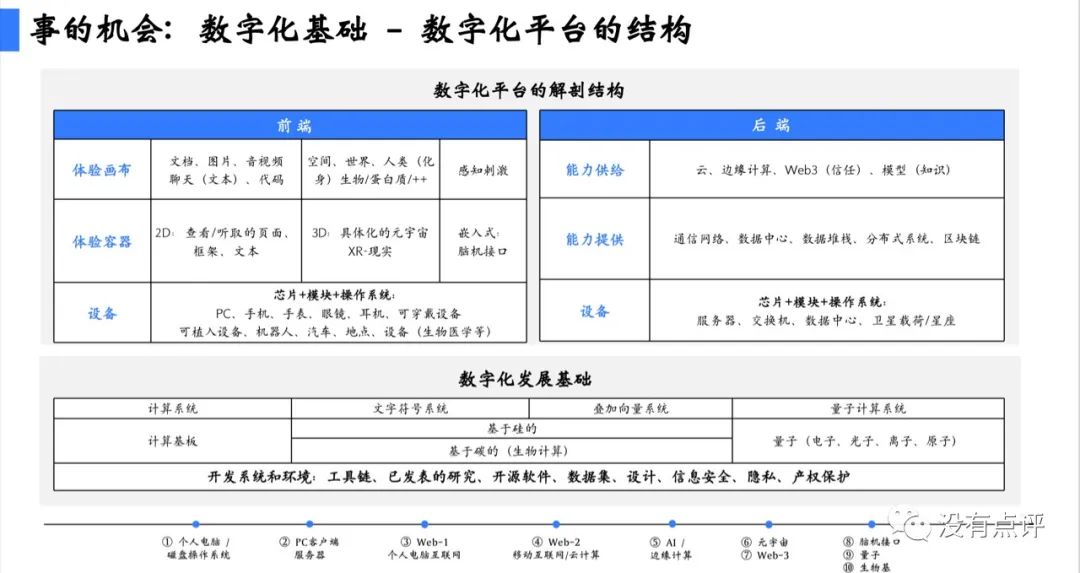

我的大模型观:陆奇

在看完 AK 的演讲之后,反问了我自己一个问题:我对大模型的理解是否太肤浅?陆奇 4 月份在奇绩论坛发表了一份极具影响力,同时立场相当极端的演讲。当时我还觉得是深耕多年守得云开见月明的范进式论调。

现在对大模型有一定的了解,开始对 Qi 的认知有表面的理解,他对世界的抽象化认知在一个更高的维度。由于领先企业成功地将边际成本变成了固定成本,OpenAI 完成了过去 Google、微软、微信、支付宝在信息时代完成的基础建设,可能世界真的拐点已经开始了。(PS. 如果是真的,中国应该会有自己的大模型基础企业)

更重要的是根据 Qi 的分析,行业或者个人的发展机会是在哪里?可能每个人都有不同的见解,Qi 给出了一个可能的结构化方法论供参考。Holy shit! Just too much.

(Qi 的 PPT 比文章报道好看)

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

-END-

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?