写在前面

随着多模态大型语言模型(MLLM)的兴起,AI 理解世界的能力从静态的文本和图像,进一步拓展到了动态的、包含丰富时空信息的视频。视频作为一种承载了动作、交互、场景变化和声音(虽然本文主要聚焦视觉部分)的复杂数据形式,为 MLLM 提供了理解真实世界动态和因果关系的关键线索。

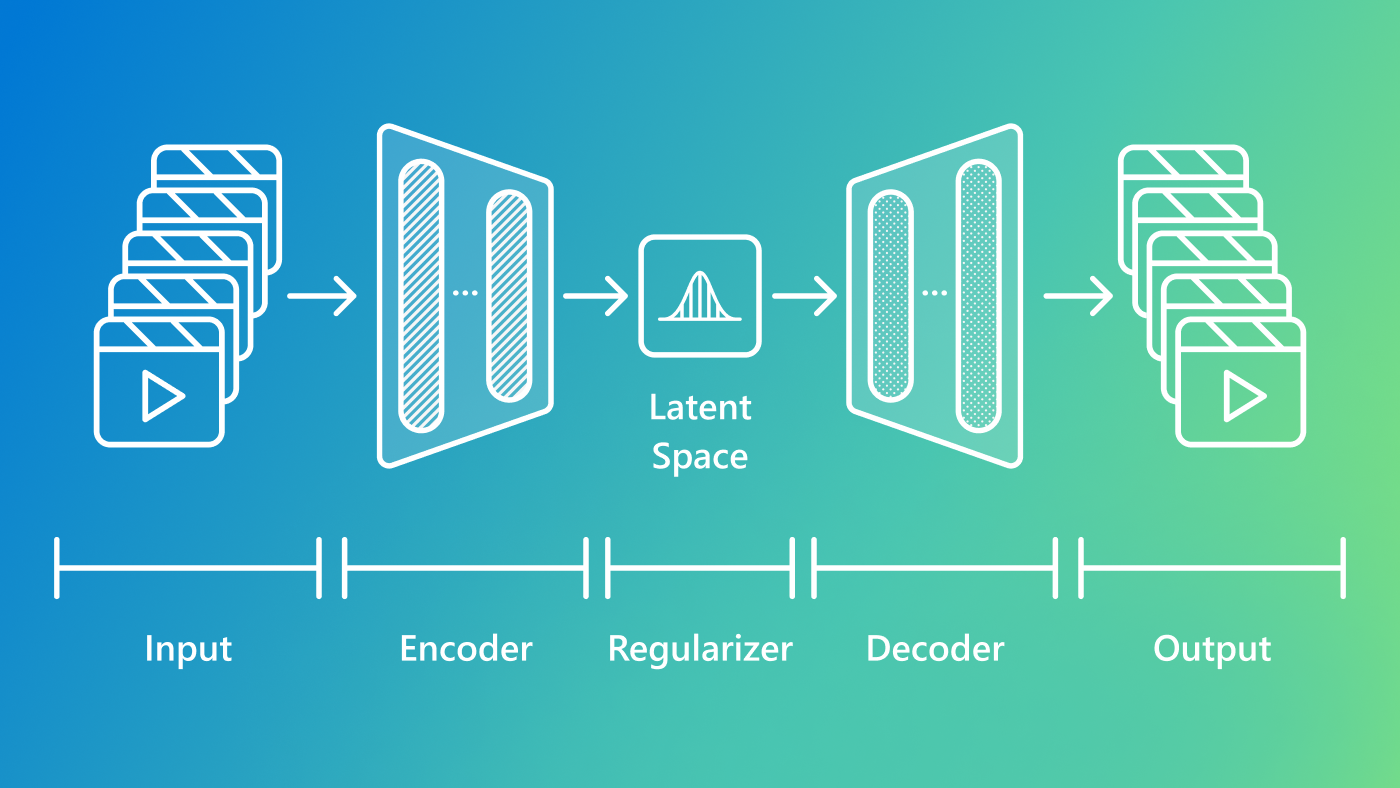

然而,要让 LLM 有效地“消化”和理解视频内容,一个强大的视频编码器(Video Encoder) 是不可或缺的“前端”。视频编码器的核心任务是将原始的视频像素流(一系列图像帧)转换成紧凑、信息丰富、且能被后续 LLM 或多模态融合模块有效利用的特征表示(Feature Representation)。

与图像编码器(如 ViT, ResNet)相比,视频编码器需要额外处理时间维度上的信息,捕捉运动、变化和时序依赖。这带来了独特的设计挑战和多样的技术路径。

本文将深入探讨当前用于 MLLM(或更广义的视频理解任务)的视频编码器主流算法,涵盖其

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?