训练的loss出现nan,第一个epoch是正常的,后面的就开始nan了

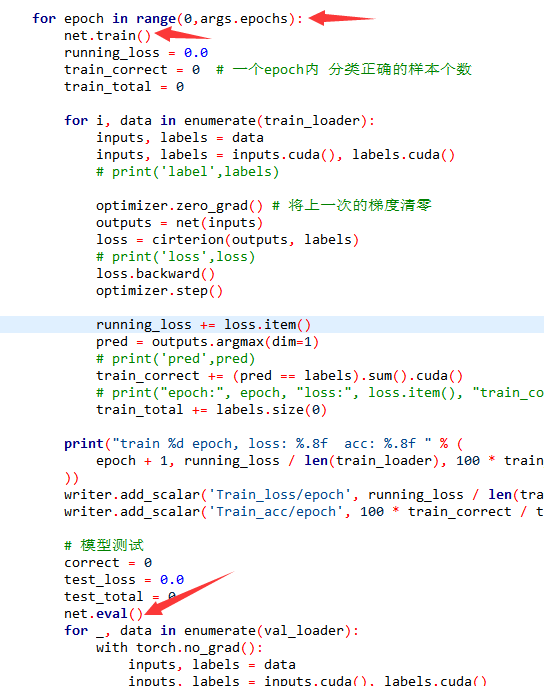

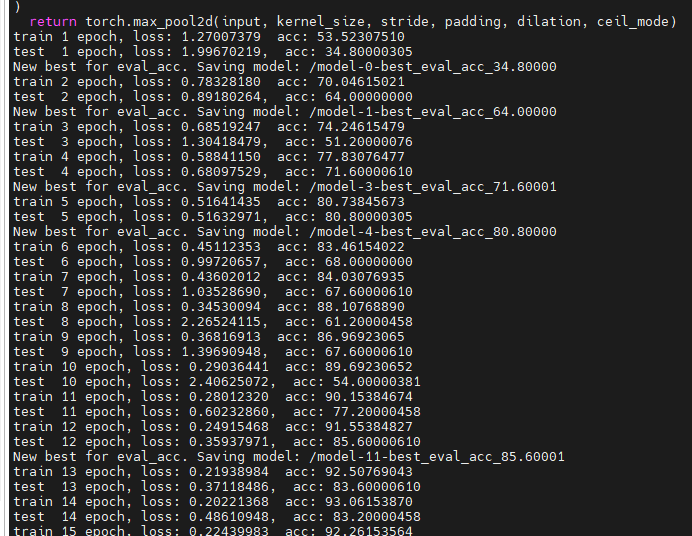

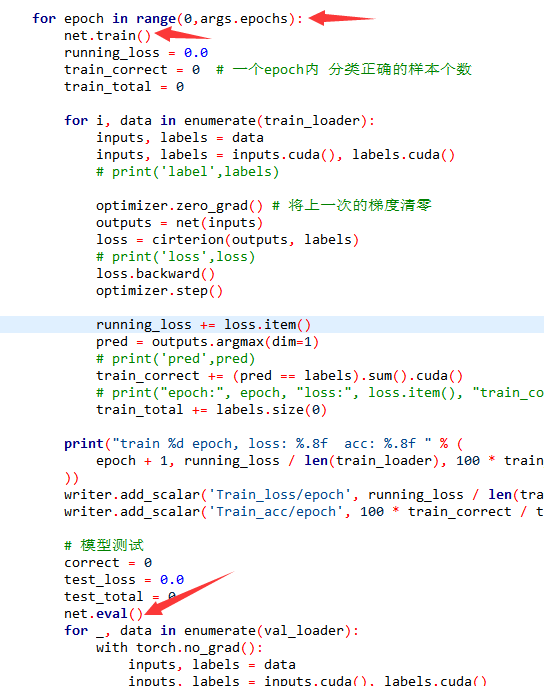

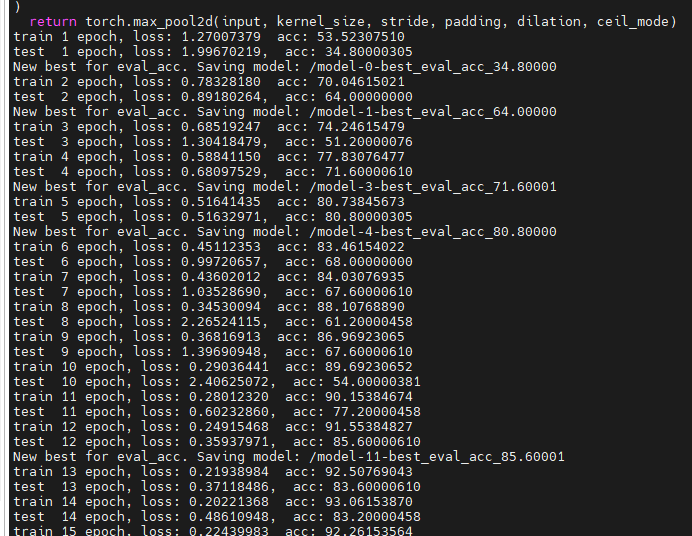

解决方式,调了lr也不是。最后发现是因为测试是每一个epoch的训练后,所以下一次训练之前要重新train(),也就是要把net.train()写在epoch里面,而不是外面。如果是train完了再test那就无所谓

训练的loss出现nan,第一个epoch是正常的,后面的就开始nan了

解决方式,调了lr也不是。最后发现是因为测试是每一个epoch的训练后,所以下一次训练之前要重新train(),也就是要把net.train()写在epoch里面,而不是外面。如果是train完了再test那就无所谓

2486

2486

1228

1228

481

481

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?