第一阶段技法:

large margin (the relationship between large marin and regularization), hard-SVM,soft-SVM,dual problem(解对偶问题),kernel trick,kernel logistic regression,

主要思路是:(这里不区分线性与非线性,差别只是特征空间转换,X空间与Z空间的关系)

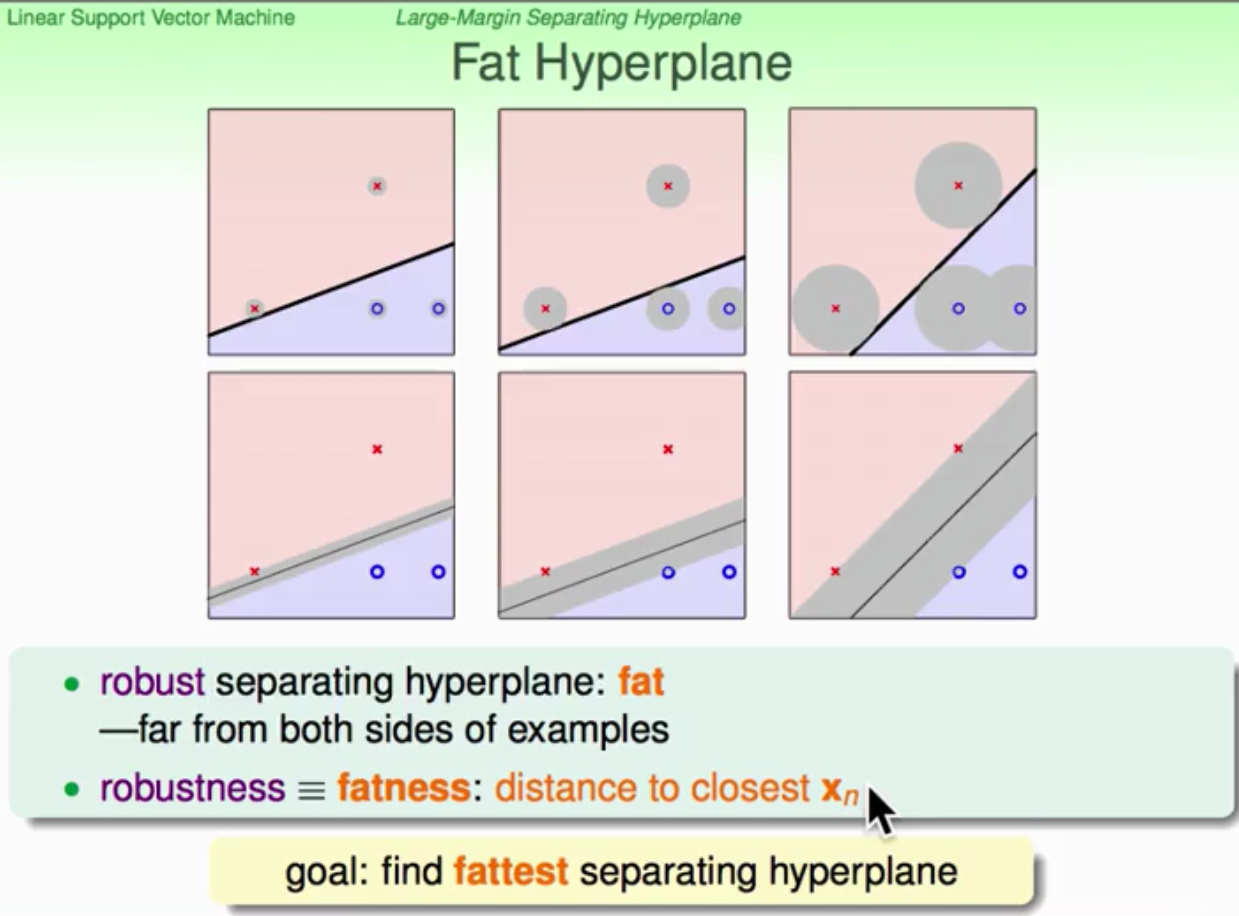

1. 从PLA出发,对于二维平面的二分类问题,PLA可能得出一堆能够正确分类的直线,但是哪一条直线会是最好的呢?我们应当如何评价分类的好坏呢?从而导出了large margin 和 support vector的概念。

具有large margin的那条直线具有更好的抗干扰能力,鲁棒性好。而影响margin大小的其实就是在fat边界上的那些数据,这些数据叫做support vector(candidate)。所以,就有了这样的一个优化目标,如何通过调节w使得margin最大。后面就是一系列的数学优化推导,最后转化为二次规划问题得到解决。

下面说明large margin背后所隐藏的一些可以解释为何large margin会“好”的原因&#x

本文介绍了机器学习中的支持向量机(SVM),重点讲解了大型边界(large margin)的概念及其与正则化的联系。SVM通过寻找具有最大边界的分类器,增强了模型的鲁棒性。文章还探讨了从硬间隔SVM到软间隔SVM的转变,以及对偶问题的解决,强调了支持向量在优化过程中的关键作用。此外,作者引入了核技巧,允许在高维空间中进行有效的特征转换,解决了计算复杂度的问题。

本文介绍了机器学习中的支持向量机(SVM),重点讲解了大型边界(large margin)的概念及其与正则化的联系。SVM通过寻找具有最大边界的分类器,增强了模型的鲁棒性。文章还探讨了从硬间隔SVM到软间隔SVM的转变,以及对偶问题的解决,强调了支持向量在优化过程中的关键作用。此外,作者引入了核技巧,允许在高维空间中进行有效的特征转换,解决了计算复杂度的问题。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?