python

爬虫

本篇博文是观看了慕课网的python爬虫课程—–爬取百度百科python词条以及相关词条的1000个页面。自己的笔记以及代码的实现。

- 什么是爬虫?

一段自动抓取互联网信息的程序。互联网是有一个个的网页组成,而每一个网页又有着对应的 URL 。每一个 URL 页面上又有指向其它页面的 url,这中 URL 的相互指向关系构成了一个网状结构。传统的方法是用人工的方法去获取互联网的信息,这种方式十分低效。而怎样可以高效地爬取这些信息了?爬虫是一种很好的解决方案。 - 简单爬虫架构

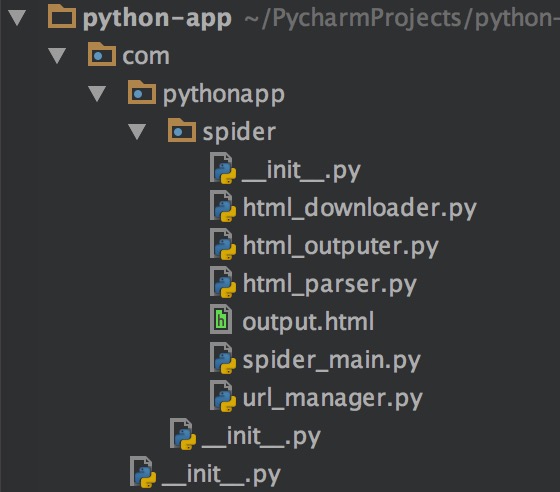

上图中展示的就是一个简单的爬虫架构。

- URL 管理器:用来管理已抓取得 URL 和未抓取的 URL。

- 网页下载器:对于 URL 管理器传入的 URL,下载该网页的信息。

- 网页解析器:分析下载后的网页信息,一方面是获取有价值的数据信息,另一方面是获取更多的 URL,加入到 URL 管理器中。

URL管理器

URL管理器用来管理已抓取得 URL 和未抓取的 URL。主要功能:

- 添加新的 URL 到URL管理器;

- 判断新的 URL 是否已经在URL管理器中了,防止重复抓取和循环抓取;

- 获取URL管理器待爬取的 URL;

- 判断URL管理器中是否有待爬取的 URL;

- URL 爬取后需要将待爬取的 URL 加到已爬取的 URL 集合中。

URL管理器实现方式:

- 内存(set 集合中)

- 数据库

- 缓存数据库(大型互联网公司)

本编博文运用 set 集合实现 URL 管理器,代码如下:

class UrlManager(object):

def __init__(self):

self.new_urls = set()

self.old_urls = set()

def add_new_url(self, url):

if url is None:

return

if url not in self.new_urls and url not in self.old_urls:

self.new_urls.add(url)

def add_new_urls(self, urls):

if urls is None or len(urls) == 0:

return

for url in urls:

self.add_new_url(url)

def has_new_url(self):

return len(self.new_urls) != 0

def get_new_url(self):

new_url = self.new_urls.pop()

self.old_urls.add(new_url)

return new_url网页下载器

网页下载器用来下载 URL 页面到本地。

python 网页下载器:

- urllib2(python 官方模块)

- request(第三方类库)

本篇博文采用 urllib2实现,代码如下:

#coding=utf-8

import urllib2

class HtmlDownloader(object):

def download(slef, url):

if url is None:

return None

#urllib2.urlopen(url) 打开文件并返回一个文件对象

response = urllib2.urlopen(url)

#response.getcode()返回请求状态码:200代表请求成功

if response.getcode() != 200:

return None

#response.read() 返回网页内容

return response.read()网页解析器

解析下载到本地的网页内容。

python 网页解析器

- 正则表达式

- html.parser

- BeautifulSoup

lxml

由于BeautifulSoup(BeautifulSoup的官方文档)既可以采用 html.parser作为它的解析器,又可以使用 lxml 作为它的解析器,功能十分强大,本篇博文采用BeautifulSoup作为网页解析器。

网页解析器要实现获取价值数据和获取新的 URL 的功能。代码如下:

#coding=utf-8

from bs4 import BeautifulSoup

import re

import urlparse

class HtmlParser(object):

def parse(self, page_url, html_content):

if page_url is None or html_content is None:

return

#解析URL网页的内容

soup = BeautifulSoup(html_content, 'html.parser', from_encoding='utf-8')

new_urls = self._get_new_urls(page_url, soup)

new_data = self._get_new_data(page_url, soup)

return new_urls, new_data

#获取新的 url

def _get_new_urls(self, page_url, soup):

new_urls = set()

links = soup.find_all('a', href=re.compile(r"/view/\d+\.htm"))

for link in links:

new_url = link['href']

new_full_url = urlparse.urljoin(page_url, new_url)

new_urls.add(new_full_url)

return new_urls

#获取价值数据

def _get_new_data(self, page_url, soup):

res_data = {}

res_data['url'] = page_url

#

title_node = soup.find('dd', class_="lemmaWgt-lemmaTitle-title").find('h1')

res_data['title'] = title_node.get_text()

summary_node = soup.find('div', class_="lemma-summary")

res_data['summary'] = summary_node.get_text()

return res_data以上三个模块实现了python爬虫程序三个最核心的功能。

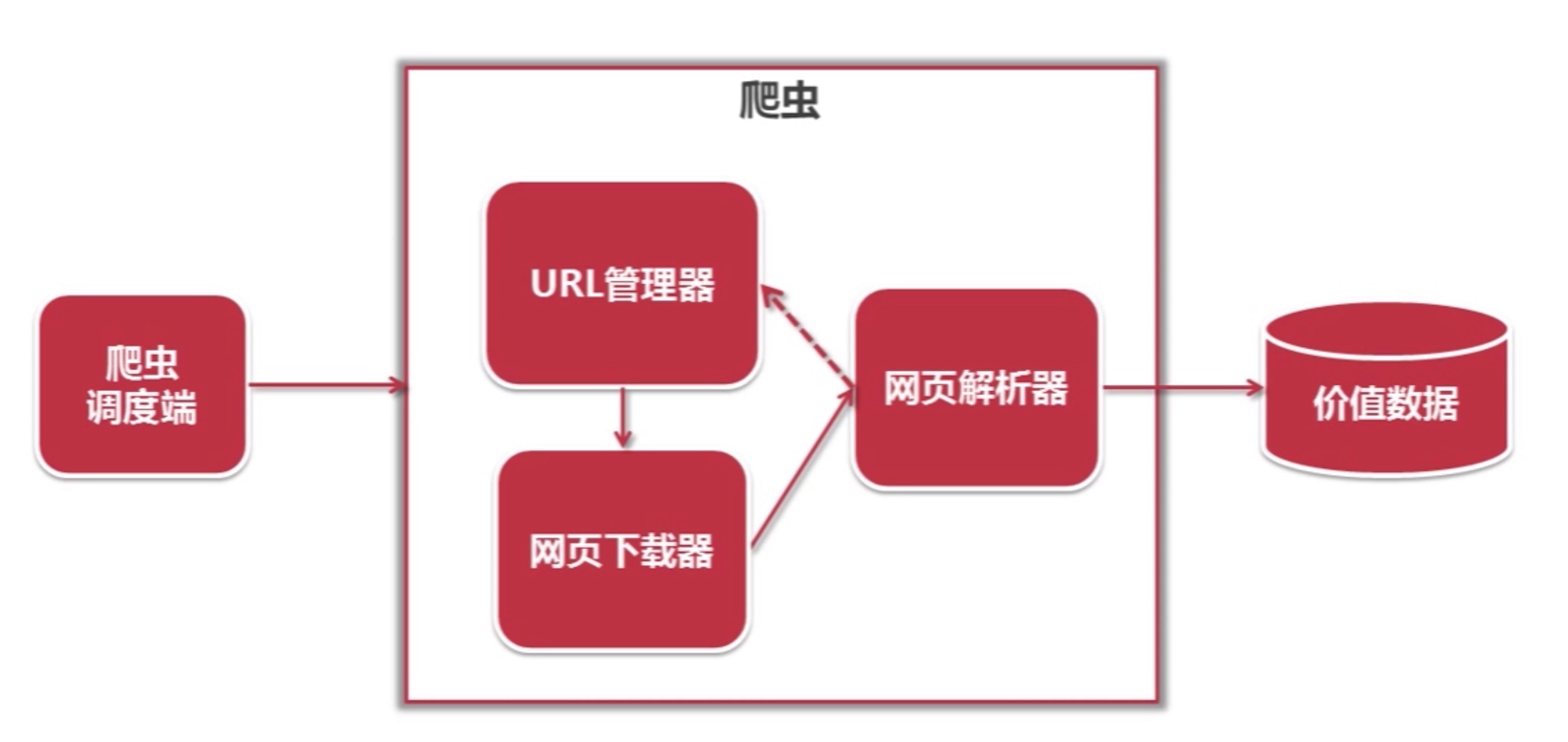

代码示例结构图

其中 url_manager.py实现的是 URL管理器的功能;html_downloader.py实现的是网页下载器的功能;html_parser.py实现的是网页解析器的功能,这三个代码已经在上面给出。另外还有 html_outputer.py,其作用是输出爬取的内容;spider_main.py,爬虫程序的调度程序。

- html_outputer.py

#coding=utf-8

#抓取的内容以表格的形式展现

class HtmlOutputer(object):

def __init__(self):

self.datas = []

def collect_data(self, data):

if data is None:

return

self.datas.append(data)

def output_html(self):

fout = open('data/output1.html', 'w')

fout.write("<html>")

fout.write("<body>")

fout.write("<table>")

for data in self.datas:

fout.write("<tr>")

fout.write("<td>%s</td>" % data['url'])

fout.write("<td>%s</td>" % data['title'].encode('utf-8'))

fout.write("<td>%s</td>" % data['summary'].encode('utf-8'))

fout.write("</tr>")

fout.write("</table>")

fout.write("</body>")

fout.write("</html>")- spider_main.py

from com.pythonapp.spider import html_downloader

from com.pythonapp.spider import html_outputer

from com.pythonapp.spider import html_parser

from com.pythonapp.spider import url_manager

class SpiderMain(object):

def __init__(self):

self.urls = url_manager.UrlManager()

self.downloader = html_downloader.HtmlDownloader()

self.parser = html_parser.HtmlParser()

self.outputer = html_outputer.HtmlOutputer()

def craw(self, root_url):

count = 1

self.urls.add_new_url(root_url)

while self.urls.has_new_url():

try:

new_url = self.urls.get_new_url()

print 'craw %d : %s' % (count, new_url)

html_content = self.downloader.download(new_url)

new_urls, new_data = self.parser.parse(new_url, html_content)

self.urls.add_new_urls(new_urls)

self.outputer.collect_data(new_data)

if count == 1000:

break

count = count + 1

except:

print 'craw failed...'

self.outputer.output_html()

if __name__ == '__main__':

root_url = 'http://baike.baidu.com/item/Python'

spider = SpiderMain()

spider.craw(root_url)

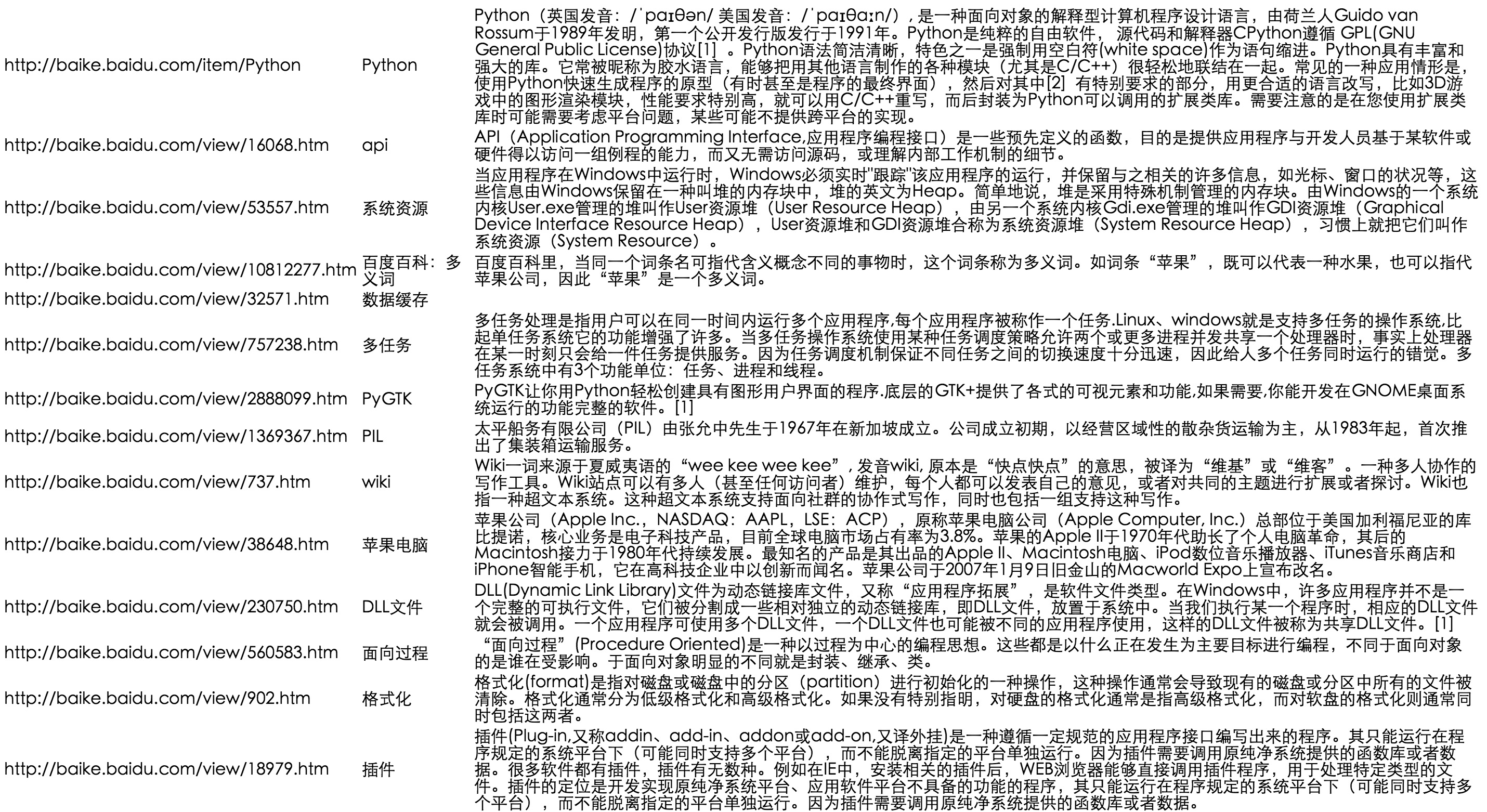

- output.hml

记录爬取结果。在浏览器中打开文件,结果如下图:

至此,简单的 python 爬虫就 ok 了,如有写的有不好以至于不好理解的地方,可以观看慕课网的完整教程。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?