Linux基本命令实践与LLM部署

1.基于VMWare的Linux命令实践

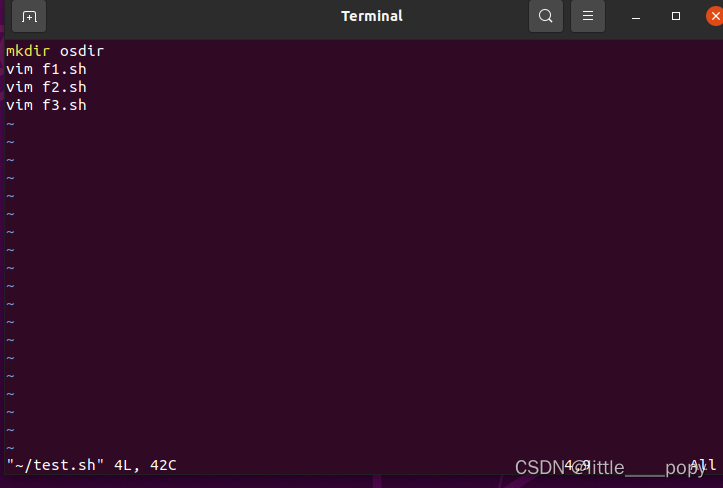

首先创建一个shell文件,运用vim命令(vim的安装用sudo apt install vim)

vim test.sh

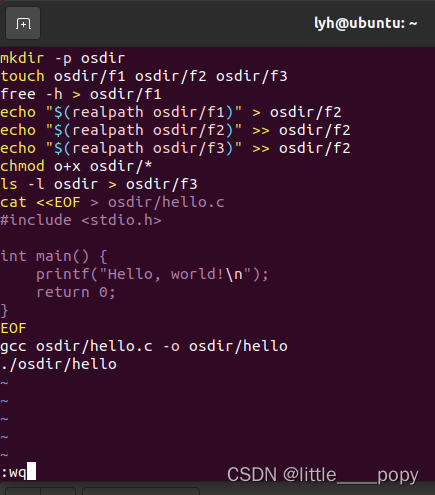

编写文件

//需要先输入i–insert,即插入命令

//touch为创建新文件

//free -h显示内存情况

//echo标准化打印内容,realpath返回路径

//chmod o+x osdir/*设置其他组用户可执行权限

//cat<<EOF,以EOF输入字符为标准输入结束

//cat>filename,创建文件,并把标准输入输出到filename文件中,以ctrl+d作为输入结束

//cat>filename<<EOF,以EOF作为输入结束,和ctrl+d的作用一样

//gcc为linux自带的编译器

// ./运行脚本文件

//:wq为保存文件

#!/bin/bash

mkdir -p osdir

touch osdir/f1 osdir/f2 osdir/f3

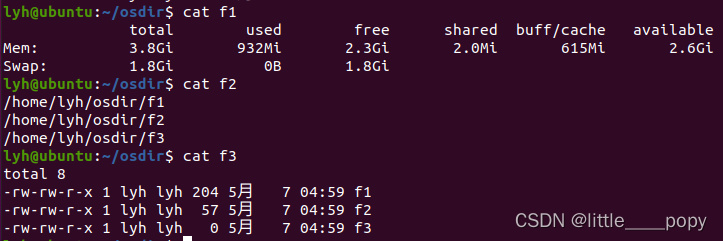

free -h > osdir/f1

echo "$(realpath osdir/f1)" >> osdir/f2

echo "$(realpath osdir/f2)" >> osdir/f2

echo "$(realpath osdir/f3)" >> osdir/f2

chmod o+x osdir/*

ls -l osdir > osdir/f3

cat <<EOF > osdir/hello.c

#include <stdio.h>

int main() {

printf("Hello, world!\n");

return 0;

}

EOF

gcc osdir/hello.c -o osdir/hello

./osdir/hello

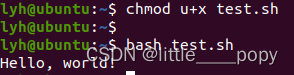

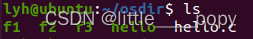

结果展示

//ls为展示当前目录下所有文件

//bash运行脚本文件

2.基于ModelScope平台的LLM部署

a.基于ModelScope平台的通义千问部署

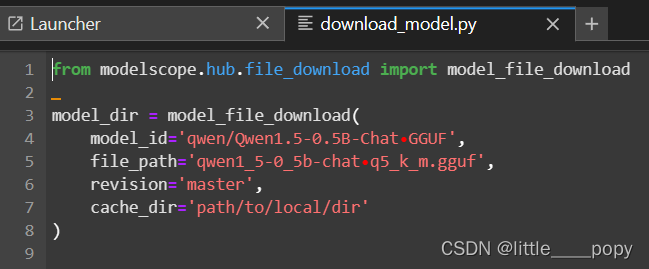

新建一个download_model.py文件,并复制入import代码,运行

vim download_model.py

from modelscope.hub.file_download import model_file_download`

model_dir = model_file_download(`

model_id='qwen/Qwen1.5-0.5B-Chat-GGUF',`

file_path='qwen1_5-0_5b-chat-q5_k_m.gguf',revision='master',`

cache_dir='/mnt/workspace/LLM/dir')

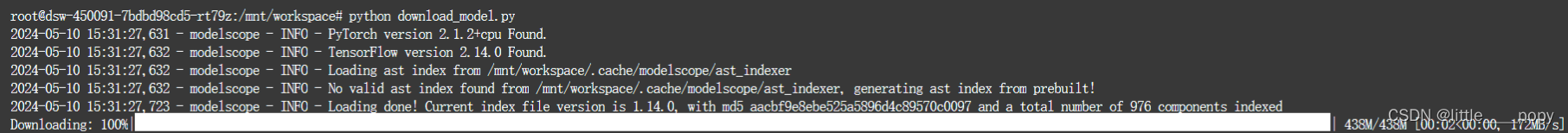

python download_model.py

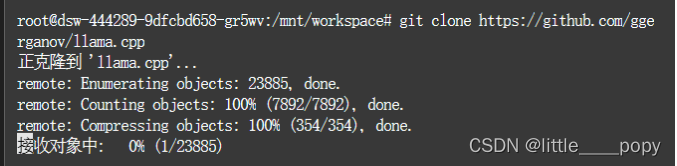

使用git获取文件

git clone https://github.com/ggerganov/llama.cpp

编译

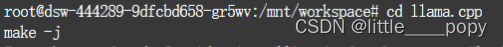

cd llama.cpp

make -j

运行

./main -m /mnt/workspace/LLM/dir/qwen/Qwen1.5-0.5B-Chat-GGUF/qwen1_5-0_5b-chat-q5_k_m.gguf -n 512 --color -i -cml

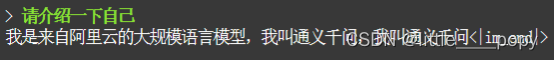

效果展示

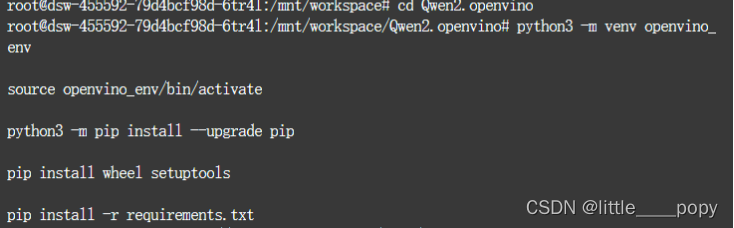

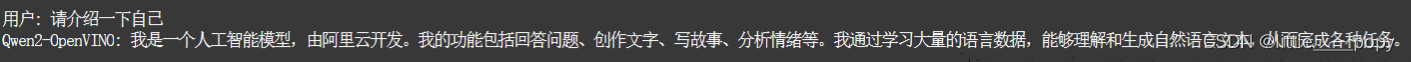

b.基于OpenVINO的模型量化实践

首先把git仓库克隆下来

git clone https://github.com/OpenVINO-dev-contest/Qwen2.openvino.git

进入克隆文件夹,进行环境配置及依赖安装

python3 -m venv openvino_env

source openvino_env/bin/activate

python3 -m pip install --upgrade pip

pip install wheel setuptools

pip install -r requirements.txt

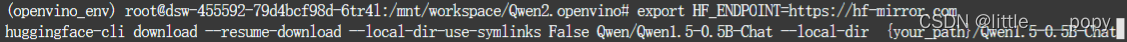

下载模型

export HF_ENDPOINT=https://hf-mirror.com

huggingface-cli download --resume-download --local-dir-use-symlinks False Qwen/Qwen1.5-0.5B-Chat --local-dir {your_path}/Qwen1.5-0.5B-Chat

转换模型

python3 convert.py --model_id Qwen/Qwen1.5-0.5B-Chat --precision int4 --output {your_path}/Qwen1.5-0.5B-Chat-ov

结果展示

237

237

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?