1.参见网址:

http://spark.apache.org/docs/latest/spark-standalone.html

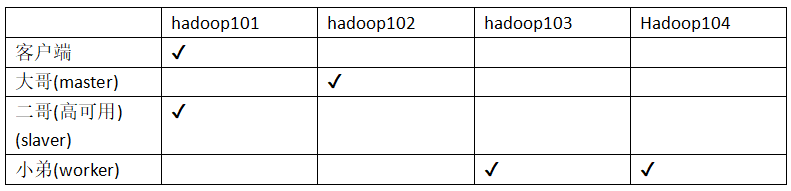

2.对自己的服务器做一个规划

3.准备工作

网络

免密钥

把spark的包四台电脑都复制一份

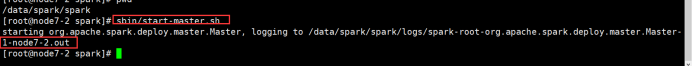

4.启动主服务器(haodoop102)

sbin/start-master.sh

会产生log日志 – 要看日志

5.查看网页

6.启动小弟(在想当小弟的服务器上执行)

# 参数是大哥的Url

sbin/start-slave.sh spark://node7-2:7077

7.推荐的配置方法

要准备一个conf/slaves;写的全部是小弟(复制conf/slaves.template为conf/slaves)

hadoop103

hadoop104

配置文件:(复制conf/spark-env.sh.template为spark-env.sh)

先停止服务器

sbin/stop-all.sh

再开启服务即可

sbin/start-all.sh

7216

7216

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?