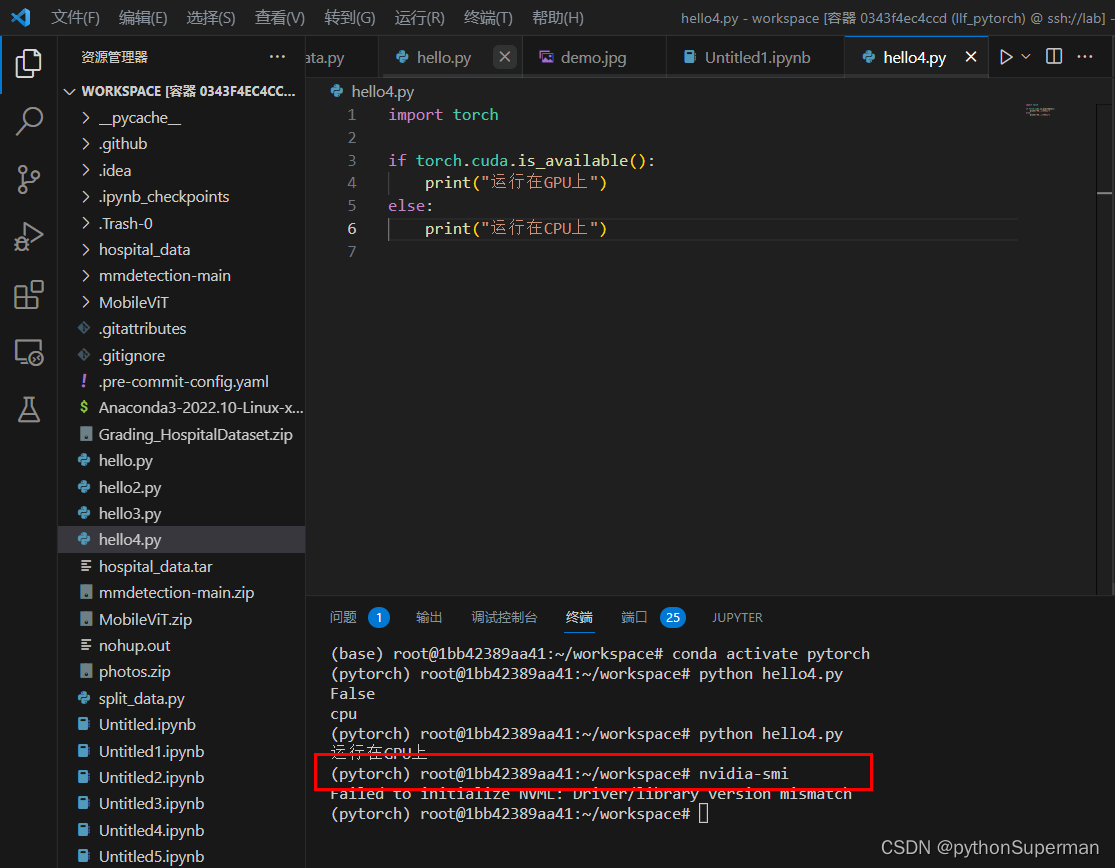

import torch

if torch.cuda.is_available():

print("运行在GPU上")

else:

print("运行在CPU上")

进入容器后

如果进入容器后,是没法通过nvidia-smi命令查看显卡型号的,但是环境仍然是GPU在运行。

nvidia-smi

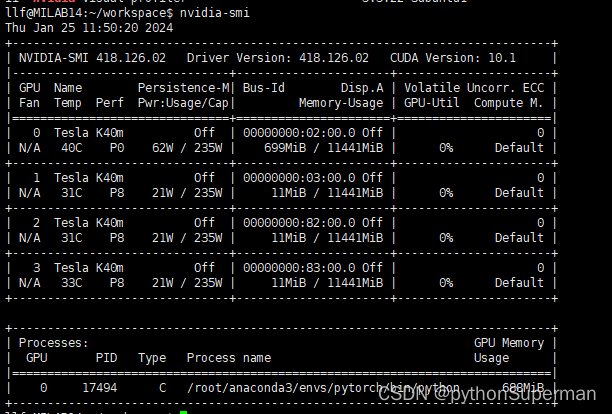

没进入的时候

import torch

if torch.cuda.is_available():

print("运行在GPU上")

else:

print("运行在CPU上")

如果进入容器后,是没法通过nvidia-smi命令查看显卡型号的,但是环境仍然是GPU在运行。

nvidia-smi

2万+

2万+

242

242

6951

6951

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?