如果是一个简单的应用,没用多余的依赖,则可以直接提交就行了:

spark-submit

--master yarn

--deploy-mode cluster

--conf spark.yarn.executor.memoryOverhead=4096

--executor-memory 2G

--num-executors 4

--executor-cores 2

--driver-memory 2G

test.py

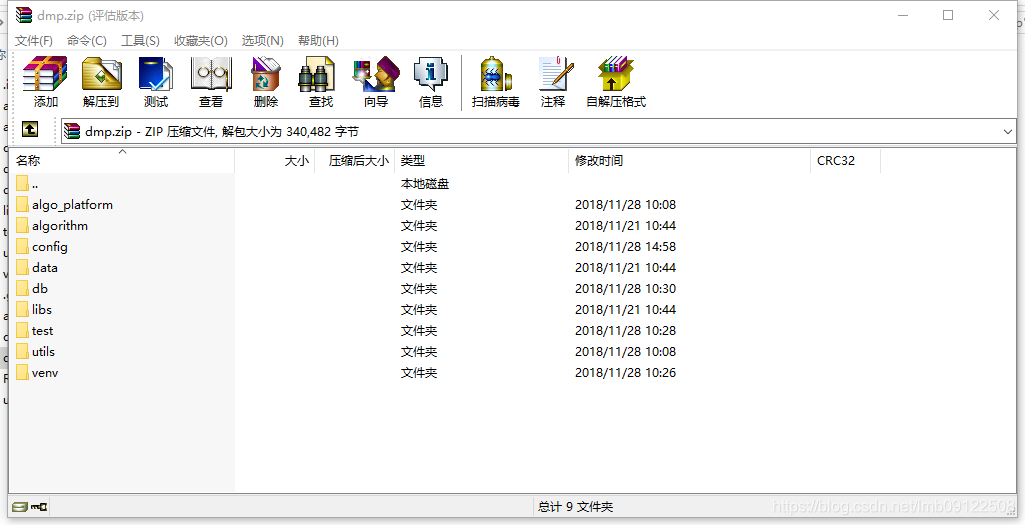

如果是一个比较大的工程,里面有很多相互依赖,则需要把依赖也传上去。python不像Java项目一样,用maven打个包就可以提交了。python需要你手动把工程打成zip包。

注意,打包的时候一定要进入根目录打包,打完包点进去直接到模块的目录,不能再有一层目录;

提交的时候,直接用--py-files xxx.zip即可。

另外, 自己写的项目无论是包名还是py文件名,还是类或者方法名,千万别跟Python自带的重名!

附录:spark-submit的一些配置参数

| ————master MASTER_URL spark://host:port, mesos://host:port, yarn,k8s://https://host:port, or local (Default: local[*]). |

| ————deploy-mode DEPLOY_MODE Whether to launch the driver program locally ("client") oron one of the worker machines inside the cluster ("cluster")(Default: client). |

| ————class CLASS_NAME Your application's main class (for Java / Scala apps). |

| ————name NAME A name of your application. |

| ————jars JARS Comma-separated list of jars to include on the driverand executor classpaths. |

| ————packages Comma-separated list of maven coordinates of jars to includeon the driver and executor classpaths. Will search the localmaven repo, then maven central and any additional remoterepositories given by |

| ————repositories. The format for thecoordinates should be groupId:artifactId:version. |

| ————exclude-packages Comma-separated list of groupId:artifactId, to exclude whileresolving the dependencies provided in |

| ————packages to avoiddependency conflicts. |

| ————repositories Comma-separated list of additional remote repositories tosearch for the maven coordinates given with |

| ————packages. |

| ————py-files PY_FILES Comma-separated list of .zip, .egg, or .py files to placeon the PYTHONPATH for Python apps. |

| ————files FILES Comma-separated list of files to be placed in the workingdirectory of each executor. File paths of these filesin executors can be accessed via SparkFiles.get(fileName). |

| ————conf PROP=VALUE Arbitrary Spark configuration property. |

| ————properties-file FILE Path to a file from which to load extra properties. If notspecified, this will look for conf/spark-defaults.conf. |

| ————driver-memory MEM Memory for driver (e.g. 1000M, 2G) (Default: 1024M). |

| ————driver-java-options Extra Java options to pass to the driver. |

| ————driver-library-path Extra library path entries to pass to the driver. |

| ————driver-class-path Extra class path entries to pass to the driver. Note thatjars added with |

| ————jars are automatically included in theclasspath. |

| ————executor-memory MEM Memory per executor (e.g. 1000M, 2G) (Default: 1G). |

| ————proxy-user NAME User to impersonate when submitting the application.This argument does not work with |

| ————principal / |

| ————keytab. |

| ————help, -h Show this help message and exit. |

| ————verbose, -v Print additional debug output. |

| ————version, Print the version of current Spark.Cluster deploy mode only: |

| ————driver-cores NUM Number of cores used by the driver, only in cluster mode(Default: 1).Spark standalone or Mesos with cluster deploy mode only: |

| ————supervise If given, restarts the driver on failure. |

| ————kill SUBMISSION_ID If given, kills the driver specified. |

| ————status SUBMISSION_ID If given, requests the status of the driver specified.Spark standalone and Mesos only: |

| ————total-executor-cores NUM Total cores for all executors.Spark standalone and YARN only: |

| ————executor-cores NUM Number of cores per executor. (Default: 1 in YARN mode,or all available cores on the worker in standalone mode)YARN-only: |

| ————queue QUEUE_NAME The YARN queue to submit to (Default: "default"). |

| ————num-executors NUM Number of executors to launch (Default: 2).If dynamic allocation is enabled, the initial number ofexecutors will be at least NUM. |

| ————archives ARCHIVES Comma separated list of archives to be extracted into theworking directory of each executor. |

| ————principal PRINCIPAL Principal to be used to login to KDC, while running onsecure HDFS. |

| ————keytab KEYTAB The full path to the file that contains the keytab for theprincipal specified above. This keytab will be copied tothe node running the Application Master via the SecureDistributed Cache, for renewing the login tickets and thedelegation tokens periodically. |

981

981

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?