目录

动态扩容:

随着公司业务的增长,数据量越来越大,原有的datanode节点的容量已经不能满足存储数据的需求,需要在原有集群基础上动态添加新的数据节点。也就是俗称的动态扩容。

有时候旧的服务器需要进行退役更换,暂停服务,可能就需要在当下的集群中停止某些机器上hadoop的服务,俗称动态缩容。

1.基础准备

1.1基本步骤:

在基础准备部分,主要是设置hadoop运行的系统环境

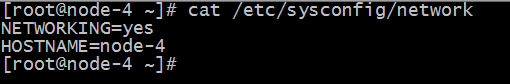

修改新机器系统hostname(通过/etc/sysconfig/network进行修改)

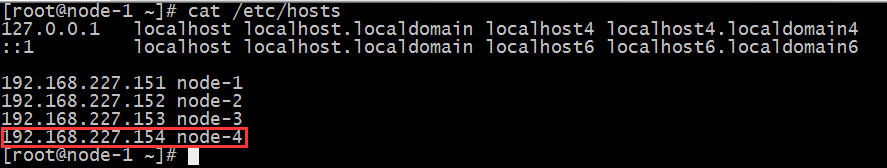

修改hosts文件,将集群所有节点hosts配置进去(集群所有节点保持hosts文件统一)

设置NameNode到DataNode的免密码登录(ssh-copy-id命令实现)

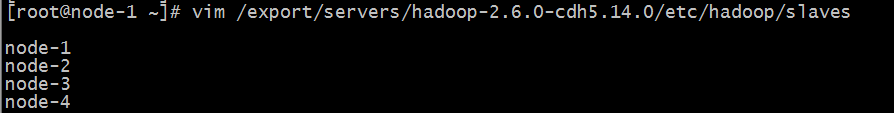

修改主节点slaves文件,添加新增节点的ip信息(集群重启时配合一键启动脚本使用)

在新的机器上上传解压一个新的hadoop安装包,从主节点机器上将hadoop的所有配置文件,scp到新的节点上。

1.2添加datanode

在namenode所在的机器的

/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop目录下创建dfs.hosts文件

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim dfs.hosts

添加如下主机名称(包含新服役的节点)

node-1

node-2

node-3

node-4

本文详细介绍了如何在Hadoop集群中进行动态扩容和缩容,包括添加新节点、退役旧节点、负载均衡等关键步骤,确保数据存储和处理能力的灵活调整。

本文详细介绍了如何在Hadoop集群中进行动态扩容和缩容,包括添加新节点、退役旧节点、负载均衡等关键步骤,确保数据存储和处理能力的灵活调整。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1377

1377

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?