Canal 介绍

canal是阿里巴巴旗下的一款开源项目,纯Java开发。基于数据库增量日志解析,提供增量数据订阅&消费,目前主要支持了MySQL(也支持mariaDB)

阿里巴巴的 canal https://github.com/alibaba/canal

基于日志增量订阅和消费的业务包括

数据库镜像

数据库实时备份

索引构建和实时维护(拆分异构索引、倒排索引等)

业务 cache 刷新

带业务逻辑的增量数据处理

当前的 canal 支持源端 MySQL 版本包括 5.1.x , 5.5.x , 5.6.x , 5.7.x , 8.0.x

MySQL主从复制设计原理

作用:

- 对我们的数据实现备份

- 读写分离

- 故障转移

- 简单集群

主:读和写

从:只能读不能写

主从复制的原理:

从节点订阅主的mysql服务器,主节点binlog文件发生变化的情况下,将该binlog文件增量的形式同步给从节点服务器,这样的话主和从能够最终保持数据的一致性。

MySQL与Redis数据的一致性方案

流程图

kafka和zookeeper和canal安装包下载地址

链接:https://pan.baidu.com/s/1rrxg0L4urLIWVARuS1ZlIQ

提取码:s93i

CanalServer(Mysql从)怎么订阅Mysql主?

配置Mysql服务器

- 开启允许基于binlog文件主从同步 配置MySQL的 my.ini/my.cnf

log-bin=mysql-bin #添加这一行就ok

binlog-format=ROW # 选择row模式

server_id=1 #配置mysql replaction需要定义,不能和canal的slaveId重复

配置该文件后,重启mysql服务器即可。

- 添加cannl的账号 或者直接使用自己的root账号

手动创建cannl账号或者直接使用root账号

drop user 'canal'@'%';

CREATE USER 'canal'@'%' IDENTIFIED BY 'canal';

grant all privileges on *.* to 'canal'@'%' identified by 'canal';

flush privileges;

一定要检查mysql user 权限为 Y

Mysql8以上版

创建用户方法如下:

sql CREATE USER 'canal'@'%' IDENTIFIED BY 'canal';

授予账户权限的方法如下:

GRANT SELECT,INSERT,UPDATE,DELETE,CREATE,DROP,ALTER ON *.* TO 'canal'@'%';

授予所有权限:

GRANT ALL PRIVILEGES ON *.* TO 'canal'@'%';

查看用户权限:

SHOW GRANTS FOR 'canal'@'%';

如何构建CanalService?

修改 \conf\example下的instance.properties 配置文件内容

canal.instance.master.address=127.0.0.1:3306

canal.instance.dbUsername=canal

canal.instance.dbPassword=canal

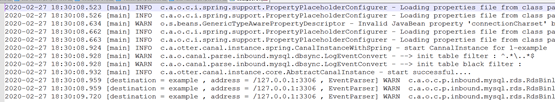

启动startup.bat 查看 \logs\example example.log日志文件

创建CanalClient

Maven依赖

<dependencies>

<dependency>

<groupId>com.alibaba.otter</groupId>

<artifactId>canal.client</artifactId>

<version>1.1.0</version>

</dependency>

<dependency>

<groupId>redis.clients</groupId>

<artifactId>jedis</artifactId>

<version>2.9.0</version>

</dependency>

</dependencies>

同步代码

import com.alibaba.fastjson.JSONObject;

import com.alibaba.otter.canal.client.CanalConnector;

import com.alibaba.otter.canal.client.CanalConnectors;

import com.alibaba.otter.canal.protocol.CanalEntry.*;

import com.alibaba.otter.canal.protocol.Message;

import java.net.InetSocketAddress;

import java.util.List;

public class CanalClient {

public static void main(String args[]) {

CanalConnector connector = CanalConnectors.newSingleConnector(new InetSocketAddress("127.0.0.1",

11111), "example", "", "");

int batchSize = 100;

try {

connector.connect();

connector.subscribe("user.users");

connector.rollback();

while (true) {

// 获取指定数量的数据

Message message = connector.getWithoutAck(batchSize);

long batchId = message.getId();

int size = message.getEntries().size();

System.out.println("batchId = " + batchId);

System.out.println("size = " + size);

if (batchId == -1 || size == 0) {

try {

Thread.sleep(1000);

} catch (InterruptedException e) {

e.printStackTrace();

}

} else {

printEntry(message.getEntries());

}

// 提交确认

connector.ack(batchId);

// connector.rollback(batchId); // 处理失败, 回滚数据

}

} finally {

connector.disconnect();

}

}

private static void printEntry(List<Entry> entrys) {

for (Entry entry : entrys) {

if (entry.getEntryType() == EntryType.TRANSACTIONBEGIN || entry.getEntryType() == EntryType.TRANSACTIONEND) {

continue;

}

RowChange rowChage = null;

try {

rowChage = RowChange.parseFrom(entry.getStoreValue());

} catch (Exception e) {

throw new RuntimeException("ERROR ## parser of eromanga-event has an error , data:" + entry.toString(),

e);

}

EventType eventType = rowChage.getEventType();

System.out.println(String.format("================> binlog[%s:%s] , name[%s,%s] , eventType : %s",

entry.getHeader().getLogfileName(), entry.getHeader().getLogfileOffset(),

entry.getHeader().getSchemaName(), entry.getHeader().getTableName(),

eventType));

for (RowData rowData : rowChage.getRowDatasList()) {

if (eventType == EventType.DELETE) {

redisDelete(rowData.getBeforeColumnsList());

} else if (eventType == EventType.INSERT) {

redisInsert(rowData.getAfterColumnsList());

} else {

System.out.println("-------> before");

printColumn(rowData.getBeforeColumnsList());

System.out.println("-------> after");

redisUpdate(rowData.getAfterColumnsList());

}

}

}

}

private static void printColumn(List<Column> columns) {

for (Column column : columns) {

System.out.println(column.getName() + " : " + column.getValue() + " update=" + column.getUpdated());

}

}

private static void redisInsert(List<Column> columns) {

JSONObject json = new JSONObject();

for (Column column : columns) {

json.put(column.getName(), column.getValue());

}

if (columns.size() > 0) {

RedisUtil.stringSet(columns.get(0).getValue(), json.toJSONString());

}

}

private static void redisUpdate(List<Column> columns) {

JSONObject json = new JSONObject();

for (Column column : columns) {

json.put(column.getName(), column.getValue());

}

if (columns.size() > 0) {

RedisUtil.stringSet(columns.get(0).getValue(), json.toJSONString());

}

}

private static void redisDelete(List<Column> columns) {

JSONObject json = new JSONObject();

for (Column column : columns) {

json.put(column.getName(), column.getValue());

}

if (columns.size() > 0) {

RedisUtil.delKey(columns.get(0).getValue());

}

}

}

import redis.clients.jedis.Jedis;

public class RedisUtil {

private static Jedis jedis = null;

public static synchronized Jedis getJedis() {

if (jedis == null) {

jedis = new Jedis("127.0.0.1", 6379);

}

return jedis;

}

public static boolean existKey(String key) {

return getJedis().exists(key);

}

public static void delKey(String key) {

getJedis().del(key);

}

public static String stringGet(String key) {

return getJedis().get(key);

}

public static String stringSet(String key, String value) {

return getJedis().set(key, value);

}

public static void hashSet(String key, String field, String value) {

getJedis().hset(key, field, value);

}

}

1806

1806

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?