目录

4.Crossmodal Reverse Distillation

笔记作者:

乔幸荣,女,西安工程大学电子信息学院,2024级研究生,张宏伟人工智能课题组

研究方向:模式识别与智能系统

电子邮件:2029518801@qq.com

这篇文章针对现有的基于知识蒸馏的多模态异常检测方法可能无法有效捕获某一模态中的异常,从而导致检测失败以及不能充分利用丰富的内部和跨模式信息,提出了基于多分支蒸馏的跨模态反蒸馏方法。

原文链接:https://arxiv.org/pdf/2412.08949v1

代码链接:https://github.com/hito2448/CRD

1.Introduction

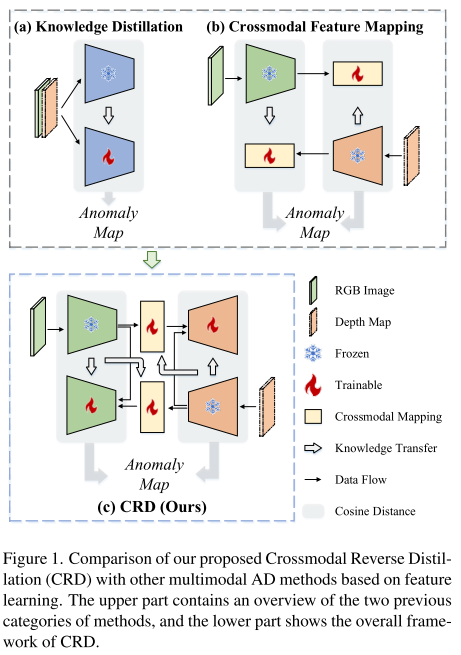

目前,基于特征学习的方法分为两类,如图1所示:(1)AST和MMRD(图1 (a))等方法遵循知识蒸馏,学生网络在正常样本上从教师网络学习多模态特征表示能力。然而,这些方法可能会在融合过程中平滑异常特征,降低教师对异常的敏感性,导致假阴性,特别是当一个模态是正常的,而另一个模态是异常的。(2)跨模态特征映射(图1 (b))引入了一种新的范式,通过跨模态映射特征来捕捉跨模态关系,实现了多模态AD。但不可避免的是,多模态特征之间的不对齐会导致拟合不足,并导致输出异常图中的误报。

为了解决以前基于kd的方法中的异常平滑问题,我们的直觉是将单分支蒸馏扩展为多分支蒸馏。每个模态都有自己的蒸馏目标,确保对每个模态内异常的敏感性。此外,为了解决跨模态特征映射的欠拟合问题,我们建议不直接使用跨模态映射的特征相似度来生成异常图。相反,我们将跨模态映射的思想集成到多分支蒸馏中,其中来自另一模态的教师网络的特征,以及多模态关系,有助于为给定模态的学生网络生成特征。

我们的贡献如下:

•我们提出了基于多分支蒸馏的跨模态反蒸馏,用于多模态工业异常检测,可以有效地检测所有模态的异常。

•引入了两个跨模态助手,包括帮助学生解码器生成正常特征的跨模态滤波器和放大来自其他模态的异常感知的跨模态放大器。

•实验结果表明,我们提出的CRD在多模态工业AD数据集上实现了最先进的性能。

2.Related Work

无监督异常检测 近年来,无监督广告越来越受到人们的关注。最初,许多无监督AD方法依赖于生成模型。这些模型在正常样本上进行训练,以学习重建正常数据的能力。在推理过程中,利用重构误差对输入图像进行正常或异常分类。其他方法引入记忆库,将测试样本与存储的正常特征进行比较,以检测异常。最近,合成异常图像的研究取得了重大进展,该图像模拟真实场景以辅助无监督AD任务。此外,基于师生框架的知识蒸馏方法也被应用于无监督AD。这些方法训练学生网络学习教师网络在正常样本上的特征表示,然后利用教师网络和学生网络在异常像素上的特征表示的差异来定位异常。由于KD方法直观、简单的特点,基于KD的AD方法已成为无监督异常检测领域的一个重要研究热点。

多模态异常检测 随着多个三维工业异常检测数据集的发布,无监督多模态AD逐渐成为一个研究课题。一些方法,如BTF和M3DM,通过利用3D AD的内存库来遵循PatchCore,将3D功能的存储添加到原始的PatchCore方法中。其他方法依靠重建网络来检测基于多模态数据重建结果的异常。在3D-ST、AST和MMRD等方法中也探索了知识蒸馏范式,目的是让学生网络模拟教师网络输出的多模态特征。跨模态特征映射提出了一种新的多模态解决方案,使用两个轻量级神经网络进行跨模态特征映射,并根据映射结果定位异常。

3.Preliminaries

知识蒸馏(Knowledge distillation, KD)是一种被广泛认可和研究的无监督工业图像数据分析范式,通常基于师生网络框架。教师网络通常是一个预训练模型,而学生网络是一个与教师网络相同或相似的可训练网络。在训练过程中,只使用正态样本,将教师网络表征正态特征的能力转移到学生网络中。这个过程通常使用余弦相似度来实现。设FT表示教师网络的特征输出,FS表示学生网络的特征输出。优化损失一般表示为

(1)

(2)

其中表示选择的特征层数,一般设为3。在推理过程中,使用师生特征之间的多层余弦距离,

作为异常图,S = max(M)作为样本的异常分数。当输入为正态样本时,学生的特征与教师相似,因此M和S的值都很低。当输入为异常样本时,由于学生没有学习到教师的异常特征表示能力,因此异常区域的特征距离M较大,可以同时检测到异常的存在和位置。

逆蒸馏(RD)是一种先进的基于kd的AD方法。与传统的前向蒸馏不同,RD使用编码器-解码器架构。教师网络是一个预训练的编码器,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1550

1550

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?