MapReduce定义

MapReduce是一个分布式运算程序的编程框架,是用户开发“基于Hadoop的数据分析应用”的核心框架。 MapReduce核心功能是将用户编写的业务逻辑代码和自带默认组件整合成一个完整的分布式运算程序,并发运行在一个Hadoop集群上。

MapReduce的核心思想

- 首先MapReduce分成两个阶段:Map阶段和Reduce阶段。

- 在Map阶段,会并发的执行MapTask。

- 在Reduce阶段,会有并发的ReduceTask。ReduceTask依赖于MapTask并发输出的结果。

举个例子:手写wordCount例子

- 首先inputFormat会对数据块进行切片,如果是TextInputFormat,每个切片默认就是每个block的大小(本地是33554432字节/32M,集群上默认是128M),然后每个切片会对应一个MapTask,MapTask会按行读取数据,然后用空格进行分割行内的单词,再用每个单词对应整数1组成K/V键值对,最后按照 单词首字母进行分区,分成两个区,再写入磁盘。当数据到Reduce阶段时,会产生两个 ReduceTask并行地统计这两个分区中的数据。

Job提交流程源码和切片源码

数据切片是MapReduce程序计算输入数据的单位,一个切片会对应启动一个MapTask。

Job提交流程源码

waitForCompletion():

-->

submit();

-->

// 1建立连接

connect();

// 1)创建提交Job的代理

new Cluster(getConfiguration());

// (1)判断是本地运行环境还是yarn集群运行环境

initialize(jobTrackAddr, conf);

// 2 提交job

submitter.submitJobInternal(Job.this, cluster)

// 1)创建给集群提交数据的Stag路径

Path jobStagingArea = JobSubmissionFiles.getStagingDir(cluster, conf);

// 2)获取jobid ,并创建Job路径

JobID jobId = submitClient.getNewJobID();

// 3)拷贝jar包到集群

copyAndConfigureFiles(job, submitJobDir);

rUploader.uploadFiles(job, jobSubmitDir);

// 4)计算切片,生成切片规划文件

writeSplits(job, submitJobDir);

maps = writeNewSplits(job, jobSubmitDir);

input.getSplits(job);

// 5)向Stag路径写XML配置文件

writeConf(conf, submitJobFile);

conf.writeXml(out);

// 6)提交Job,返回提交状态

status = submitClient.submitJob(jobId, submitJobDir.toString(), job.getCredentials());

上面的步骤3,步骤4,步骤5分别会在I:\tmp\hadoop\mapred\staging\atguigu78585000.staging\job_local78585000_0001生成三种文件:

- 切片文件

- 配置文件

- Jar包(如果是集群下才会有jar包,本地运行环境下没有)

FileInputFormat切片原理

- 切片大小默认是Block大小。(本地环境是33554432字节/32M,集群环境下是128M)

- 切片的大小可以设置,公式为:Math.max(minSize, Math.min(maxSize, blockSize))

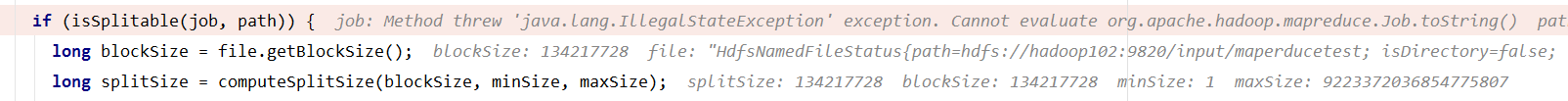

从上面的debug可看出minSize =1 ,maxSize等于long型的最大值,所以此时切片大小默认就是block的大小。

如果要调整切片的大小,就只要调整minSize和MaxSize就可以了。调小,可以让MaxSize变小(小于Block)。调大,可以让MinSize变大(大于Block).

ze和MaxSize就可以了。调小,可以让MaxSize变小(小于Block)。调大,可以让MinSize变大(大于Block).

574

574

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?