这篇论文是来自武汉理工大学、阿里巴巴达摩院等机构的研究者撰写的《SHMT: Self-supervised Hierarchical Makeup Transfer via Latent Diffusion Models》,提出了一种基于潜在扩散模型的自监督分层妆容转移(SHMT)方法,有效解决现有妆容转移方法存在的问题,在多种评估指标下表现优异。

-

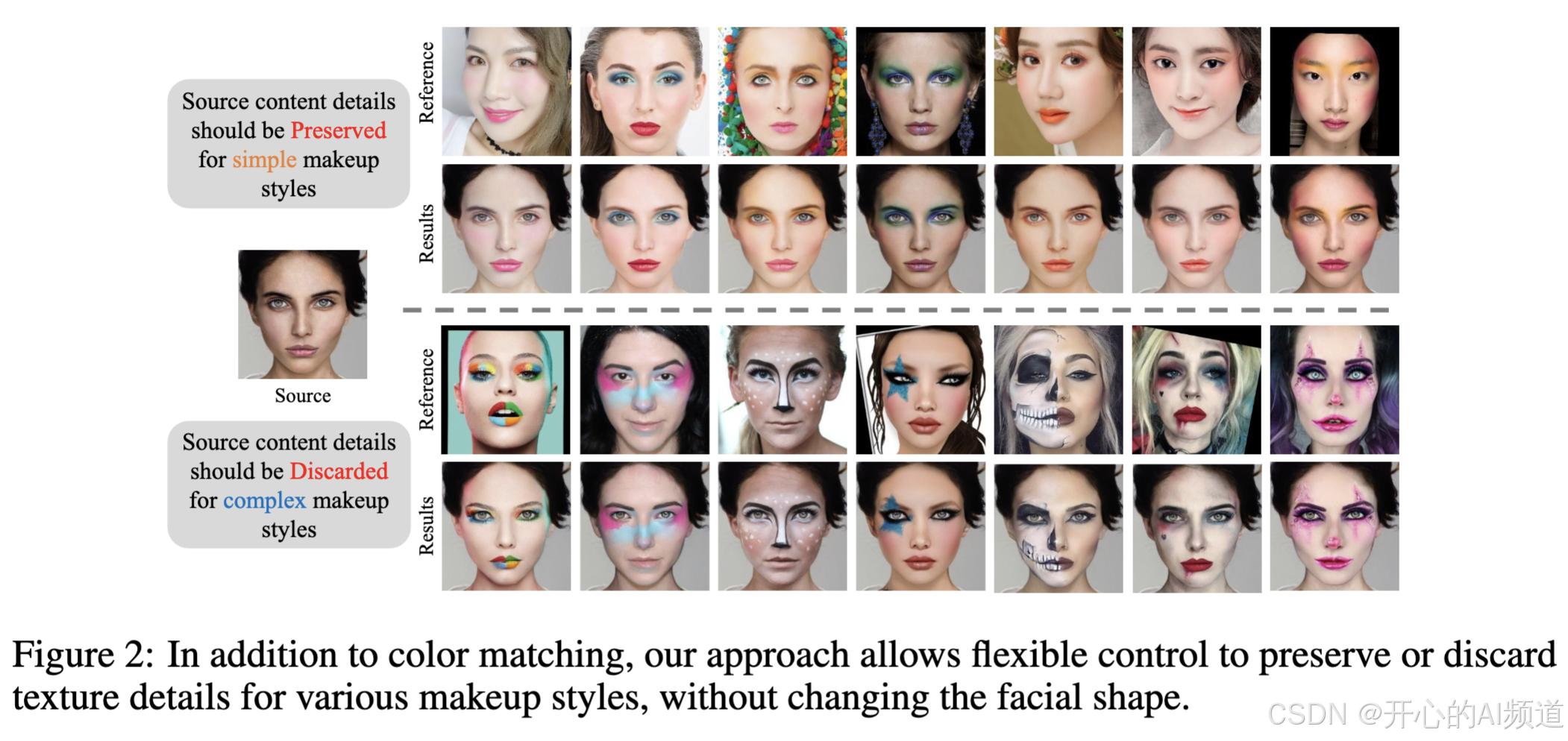

研究背景:妆容转移在社交媒体和虚拟世界应用广泛,但面临两大难题:缺乏配对数据导致现有方法合成的伪配对数据质量不佳,误导模型训练,影响妆容保真度;不同妆容风格对人脸影响不同,现有方法难以灵活处理源内容细节的保留或舍弃。

-

相关工作:回顾妆容转移领域方法,多数利用伪配对数据训练,而 SHMT 采用自监督学习,无需合成伪配对数据;介绍扩散模型在图像生成等任务的进展,SHMT 基于此展开研究。

-

方法:基于潜在扩散模型(LDM)开发,包含图像编码器、解码器和 UNet 去噪器。通过 “解耦 - 重建” 范式,利用预训练模型分割前景背景,对前景图像变换得到妆容表示,用 3D 模型和拉普拉斯金字塔获取内容表示;提出 IDA 模块,利用空间注意力和中间结果动态调整注入条件,校正对齐误差;训练时固定预训练自动编码器参数,联合优化 UNet 去噪器和 IDA 模块,推理时输入源图像背景、内容表示和参考图像妆容表示生成结果。

-

实验:使用 MT、Wild - MT 和 LADN 数据集,以 FID、CLS 和 Key - sim 为评估指标,对比七种先进方法。定性结果显示 SHMT 能自然准确再现妆容,定量结果表明其在图像真实感、妆容保真度和内容保留方面表现出色,用户研究也证实了 SHMT 的优势;消融实验验证了分层纹理细节和 IDA 模块的有效性,还展示了模型的鲁棒性和泛化能力;指出模型依赖预训练模型,参数较多、推理耗时。

-

结论:提出的 SHMT 方法采用自监督策略,能灵活处理纹理细节,有效校正对齐误差,定量和定性分析证明其有效性,但存在依赖预训练模型和计算资源需求大的局限性

Github:https://github.com/Snowfallingplum/SHMT

论文:https://arxiv.org/abs/2412.11058

Data_Flop网址:https://www.data-flop.com/shareLogin?5142

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?