Apache Hadoop简介:

Apache Hadoop软件库是一个框架,该框架允许使用简单的编程模型跨计算机集群对大型数据集进行分布式处理。它旨在从单个服务器扩展到数千台机器,每台机器都提供本地计算和存储。Hadoop软件库并不是依靠硬件来提供高可用性,而是通过检测和处理应用程序层的故障,从而在容易出现故障的计算机集群的顶部提供高可用性的服务。

项目地址:http://hadoop.apache.org

腾讯云轻量应用服务器:

轻量应用服务器(Lighthouse)是新一代面向中小企业和开发者的云服务器产品,具备轻运维、开箱即用的特点,适用于小型网站、博客、论坛、电商以及云端开发测试和学习环境等轻量级业务场景,相比传统云服务器更加简单易用。通过一站式融合常用基础云服务,帮助用户便捷高效的构建应用,是您使用腾讯云的最佳入门途径。

1. 连接轻量服务器

2. 安装JDK

安装JDK

1. 执行以下命令,下载JDK1.8安装包。

wget https://download.java.net/openjdk/jdk8u41/ri/openjdk-8u41-b04-linux-x64-14_jan_2020.tar.gz

2. 执行以下命令,解压下载的JDK1.8安装包。

tar -zxvf openjdk-8u41-b04-linux-x64-14_jan_2020.tar.gz

3. 执行以下命令,移动并重命名JDK包。

mv java-se-8u41-ri/ /usr/java8

4. 执行以下命令,配置Java环境变量。

echo 'export JAVA_HOME=/usr/java8' >> /etc/profile

echo 'export PATH=$PATH:$JAVA_HOME/bin' >> /etc/profile

source /etc/profile

5. 执行以下命令,查看Java是否成功安装。

java -version

如果返回以下信息,则表示安装成功。

3. 安装Hadoop

1. 执行以下命令,下载Hadoop安装包。

wget https://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-2.10.1/hadoop-2.10.1.tar.gz复制

2. 执行以下命令,解压Hadoop安装包至/opt/hadoop。

tar -zxvf hadoop-2.10.1.tar.gz -C /opt/

mv /opt/hadoop-2.10.1 /opt/hadoop复制

3. 执行以下命令,配置Hadoop环境变量。

echo 'export HADOOP_HOME=/opt/hadoop/' >> /etc/profile

echo 'export PATH=$PATH:$HADOOP_HOME/bin' >> /etc/profile

echo 'export PATH=$PATH:$HADOOP_HOME/sbin' >> /etc/profile

source /etc/profile 复制

4. 执行以下命令,修改配置文件yarn-env.sh和hadoop-env.sh。

echo "export JAVA_HOME=/usr/java8" >> /opt/hadoop/etc/hadoop/yarn-env.sh

echo "export JAVA_HOME=/usr/java8" >> /opt/hadoop/etc/hadoop/hadoop-env.sh复制

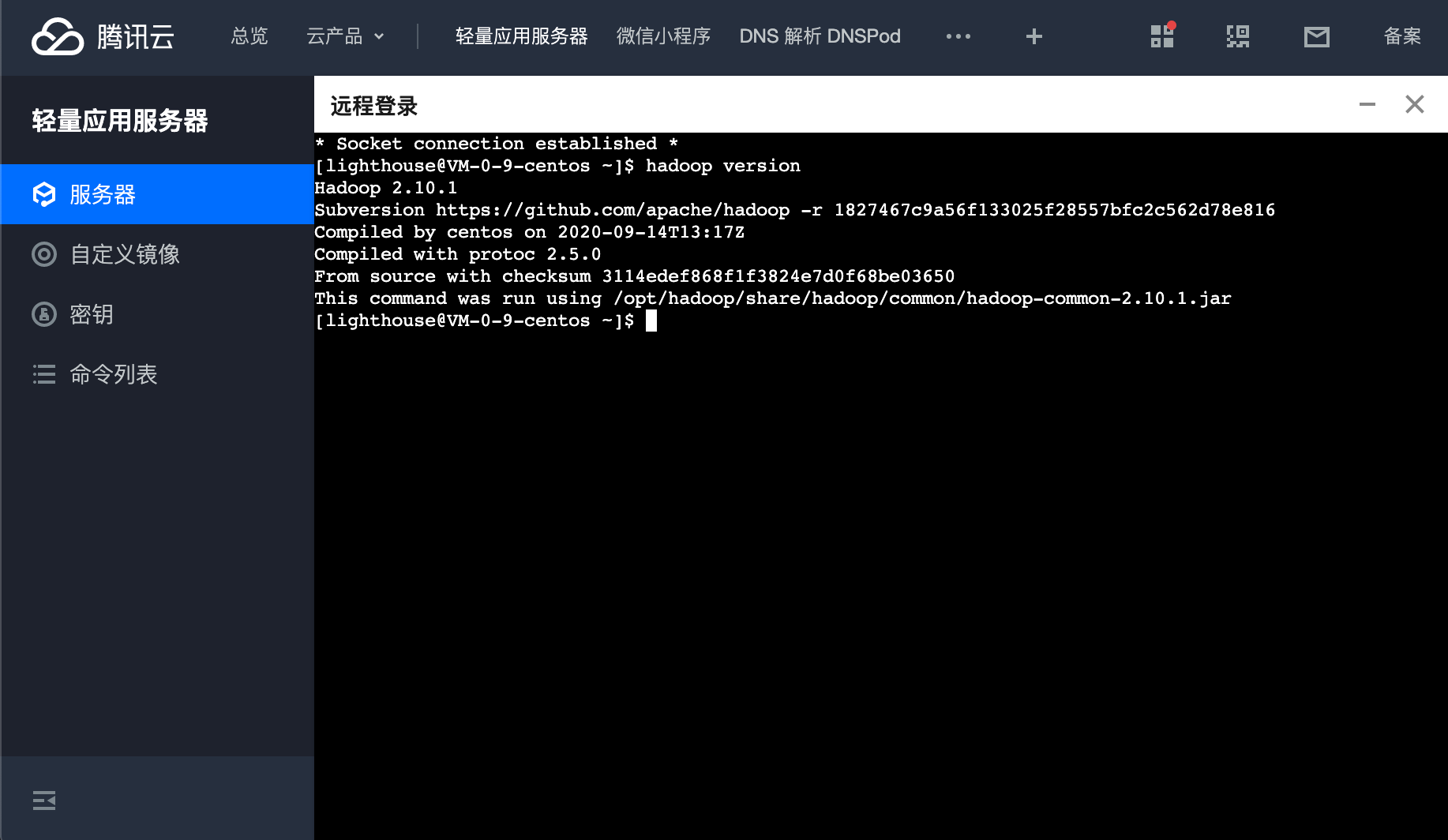

5. 执行以下命令,测试Hadoop是否安装成功。

hadoop version复制

如果返回以下信息,则表示安装成功。

4. 配置Hadoop

1.修改Hadoop配置文件 core-site.xml。

执行以下命令开始进入编辑页面。

vim /opt/hadoop/etc/hadoop/core-site.xml复制

输入i进入编辑模式。在

<configuration></configuration>复制

节点内插入如下内容。

<property>

<name>hadoop.tmp.dir</name>

<value>file:/opt/hadoop/tmp</value>

<description>location to store temporary files</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>复制

按esc键退出编辑模式,输入:wq保存退出。

2. 修改Hadoop配置文件 hdfs-site.xml。

执行以下命令开始进入编辑页面。

vim /opt/hadoop/etc/hadoop/hdfs-site.xml复制

输入i进入编辑模式。在

<configuration></configuration>复制

节点内插入如下内容。

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/opt/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/opt/hadoop/tmp/dfs/data</value>

</property>复制

按esc键退出编辑模式,输入:wq!保存退出。

5. 配置SSH免密登录

1. 执行以下命令,创建公钥和私钥。

ssh-keygen -t rsa复制

2. 执行以下命令,将公钥添加到authorized_keys文件中。

cd .ssh

cat id_rsa.pub >> authorized_keys复制

6. 启动Hadoop

1. 执行以下命令,初始化namenode

hadoop namenode -format复制

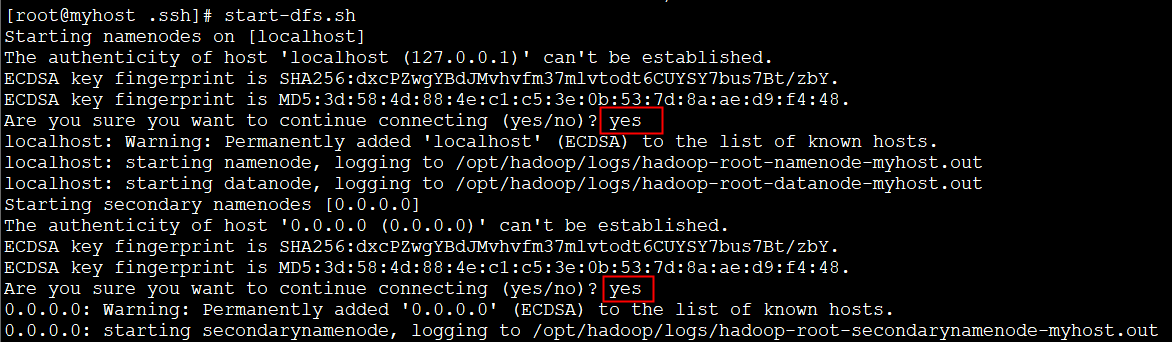

2. 依次执行以下命令,启动Hadoop。

start-dfs.sh复制

start-yarn.sh复制

3. 启动成功后,执行jps命令,查看已成功启动的进程。

4. 打开浏览器访问

http://<轻量应用服务器公网地址>:8088复制

显示如下界面则表示Hadoop伪分布式环境搭建完成。

3912

3912

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?