文章目录

1、回归与分类

回归与分类:回归是一种应用广泛的预测建模技术,这种技术的核心在于预测的结果是连续型变量。决策树,随机森林,支持向量 机的分类器等分类算法的预测标签是分类变量,多以{0,1}来表示,而无监督学习算法比如PCA,KMeans并不求解 标签,注意加以区别。

统计方法:先验

机器学习:后验

2多元线性回归

2.1 多元线性回归的基本原理

这个预测函数的本质就是我们需要构建的模型,而构造预测函数的核心就是找出模型的参数向量 。

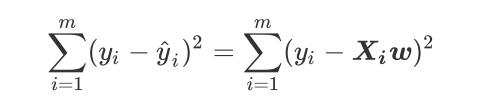

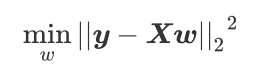

在多元线性回归中,我们的损失函数如下定义:

首先,这个损失函数代表了向量 y-y^的L2范式的平方结果,L2范式的本质是就是欧式距离,即是两个向量上的每个

点对应相减后的平方和再开平方,我们现在只实现了向量上每个点对应相减后的平方和,并没有开方,所以我们的损

失函数是L2范式,即欧式距离的平方结果。

在L2范式上开平方,就是我们的损失函数。这个式子,也正是sklearn当中,用在类Linear_model.LinerRegression背后使用的损失函数。我们往往称呼这个式子为SSE(Sum of Sqaured Error,误差平方和)或者RSS(Residual Sum of Squares 残差平方和)。在sklearn所有官方文档和网页上,我们都称之为RSS残差平方和。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?