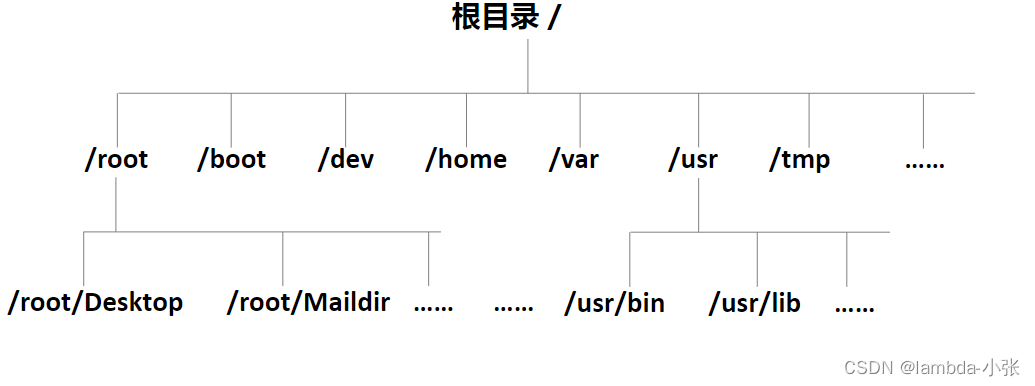

一、Linux树型目录结构

1.Linux文档存放

最顶层为根目录(/)−“计算机”--> “文件系统”

2.树型目录结构

就像一颗倒挂的树

−路径之间分隔符:/

−分层次深入

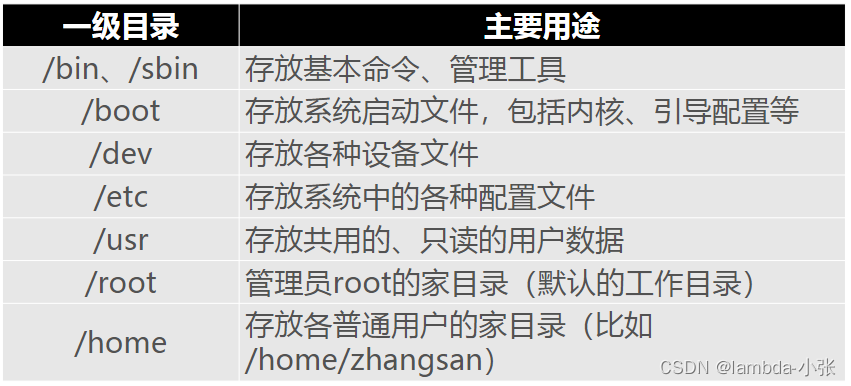

3.认识目录用途

执行man hier命令

−查看关于目录结构的手册页

常见的一级目录

/bin: 存放二进制可执行文件(ls,cat,mkdir等),常用命令一般都在这里;

/etc: 存放系统管理和配置文件;

/home: 存放所有用户文件的根目录,是用户主目录的基点,比如用户user的主目录就 是/home/user,可以用~user表示;

/usr : 用于存放系统应用程序;

/opt: 额外安装的可选应用程序包所放置的位置。一般情况下,我们可以把tomcat等都安装

到这里;

/proc: 虚拟文件系统目录,是系统内存的映射。可直接访问这个目录来获取系统信息; /root: 超级用户(系统管理员)的主目录(特权阶级o);

/sbin: 存放二进制可执行文件,只有root才能访问。这里存放的是系统管理员使用的系统级别

的管理命 令和程序。如ifconfig等;

/dev: 用于存放设备文件;

/mnt: 系统管理员安装临时文件系统的安装点,系统提供这个目录是让用户临时挂载其他的

文件系统;

/boot: 存放用于系统引导时使用的各种文件;

/lib : 存放着和系统运行相关的库文件 ;

/tmp: 用于存放各种临时文件,是公用的临时文件存储点;

/var: 用于存放运行时需要改变数据的文件,也是某些大文件的溢出区,比方说各种服务的

日志文件 (系统启动日志等。)等;

/lost+found: 这个目录平时是空的,系统非正常关机而留下“无家可归”的文件(windows下叫什 么.chk)就在这里。

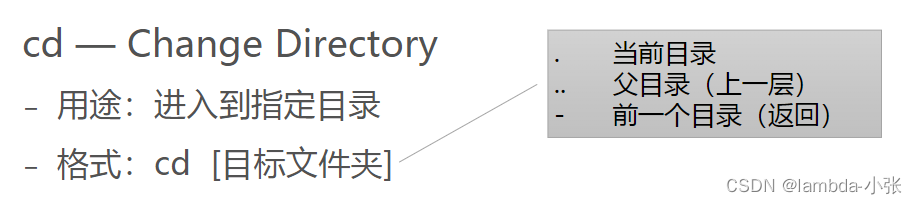

二、查看及切换目录

1.查看工作目录pwd

[root@hadoop ~]# pwd 查看当前路径

/root

查看软链接的实际路径

[root@hadoop ~]# pwd -P

/root2.切换工作目录

[root@hadoop ~]# cd /etc

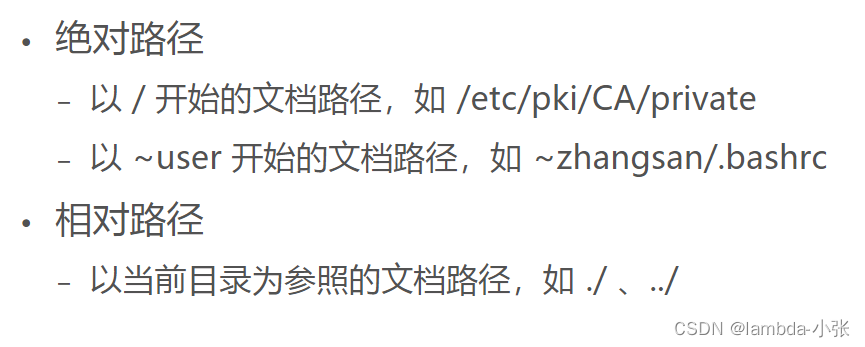

[root@hadoop etc]# 3.绝对&相对路径

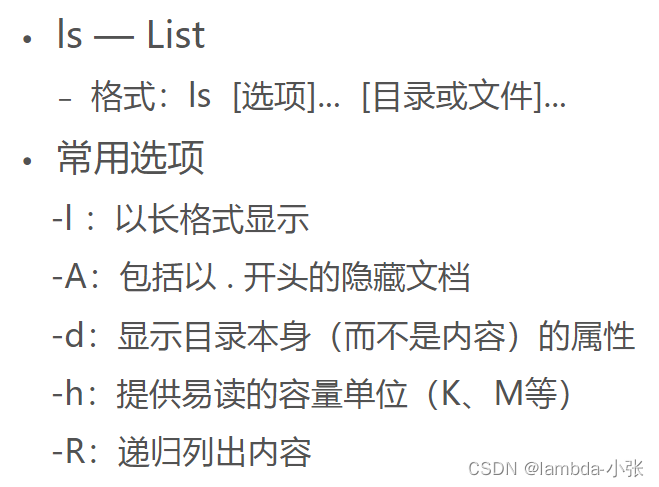

4.列出目录内容

[root@hadoop ~]# ls -a#显示所有文件,包括隐藏文件

. .bashrc .pki

.. class_four2 sanguo

abc.log .cshrc .ssh

anaconda-ks.cfg hadoop4.txt .tcshrc

.bash_history install.log Test1

.bash_logout install.log.syslog Test2

.bash_profile .oracle_jre_usage .viminfo

[root@hadoop ~]# ls -l#详细信息显示

total 36

-rw-r--r--. 1 root root 0 Nov 17 02:56 abc.log

-rw-------. 1 root root 1124 Nov 16 19:35 anaconda-ks.cfg

drwxr-xr-x. 2 root root 4096 Nov 17 01:33 class_four2

-rw-r--r--. 1 root root 0 Nov 17 20:52 hadoop4.txt

-rw-r--r--. 1 root root 9458 Nov 16 19:35 install.log

-rw-r--r--. 1 root root 3161 Nov 16 19:34 install.log.syslog

drwxrwxrwx. 2 root root 4096 Nov 21 05:03 sanguo

-rw-r--r--. 1 root root 591 Nov 18 07:51 Test1

-rw-r--r--. 1 root root 767 Nov 18 08:02 Test2

[root@hadoop ~]# ls -d#查看目录属性

.

[root@hadoop ~]# ls#文件目录

abc.log hadoop4.txt sanguo

anaconda-ks.cfg install.log Test1

class_four2 install.log.syslog Test2

[root@hadoop ~]# ll #列出当前文件或者目录的详细信息,是ls -l的缩写

total 40

-rw-r--r--. 1 root root 0 Nov 21 06:06 0316.txt

-rw-r--r--. 1 root root 0 Nov 21 06:06 {1..20.txt}

-rw-r--r--. 1 root root 0 Nov 17 02:56 abc.log

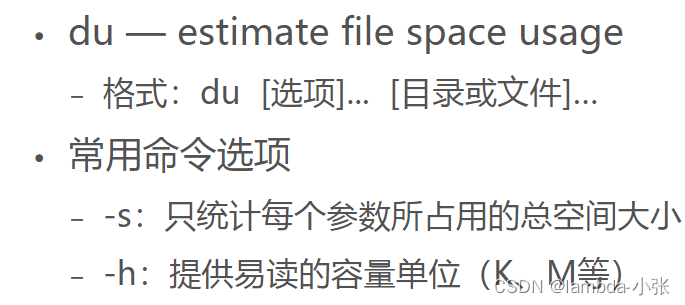

-rw-------. 1 root root 1124 Nov 16 19:35 anaconda-ks.cfg5.评估文档占用空间

[root@hadoop etc]# du -s init

60 init

[root@hadoop etc]# du -h init

60K init

459

459

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?