第6章 支持向量机

6.1

间隔与支持向量

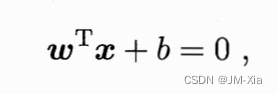

在样本空间中,划分超平面可通过如下线性方程来描述:

= (

1,

2 ,...,

d) 为法向量,决定了超平面的方向;

b :位移项,决定了超平面与原点之间的距离。(,b)确定了超平面得划分,样本空间中任意点 x 到超平面(

,b)的距离可写为

支持向量support vector: 使成立

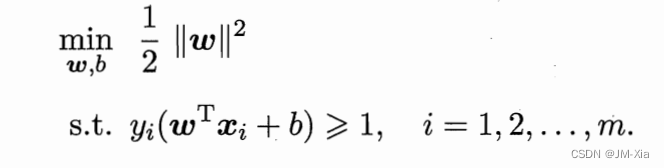

间隔margin: 两个异类支持向量到超平面的距离之和 最大间隔maximum margin: 满足上式 中约束的参数 w 和 b, 使得

最大间隔maximum margin: 满足上式 中约束的参数 w 和 b, 使得最大,可得下式

SVM的基本型:

6.1.1

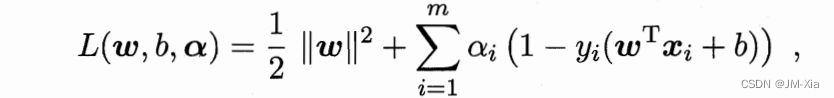

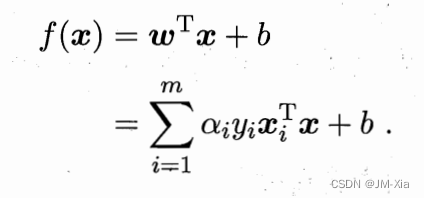

6.2 对偶问题

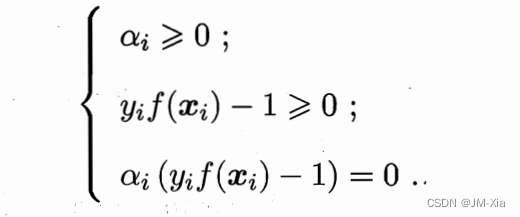

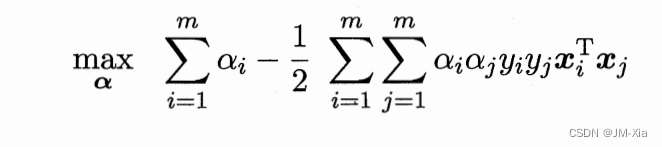

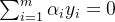

SVM基本式是一个凸二次规划 convex quadratic programming问题,也可对其使用拉格朗日乘子法可得到其“对偶问题”dual problem

得到模型,带入参数:

且满足

:

SMO的基本思路:先固定 之外的所有参数,然后求

之外的所有参数,然后求 上的极值。由于存在约束

上的极值。由于存在约束 ,若固定

,若固定 之外的其他变量,则

之外的其他变量,则 可由其他变量导出。 每次选择两个变量仪

可由其他变量导出。 每次选择两个变量仪 和

和 , 并固定其他参数.这样,在参数初始化后,SMO 不断执行如下两个步骤直至收敛:

, 并固定其他参数.这样,在参数初始化后,SMO 不断执行如下两个步骤直至收敛:

•选取一对需更新的变量  和

和 ;

;

•固定 和

和 以外的参数,求解式(6.2.4)获得更新后的

以外的参数,求解式(6.2.4)获得更新后的  和

和

![]()

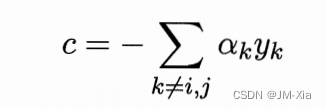

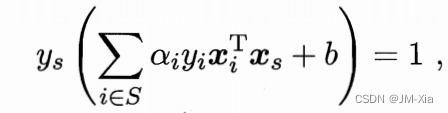

更鲁棒性的做法:使用所有支持向量求解的平均值

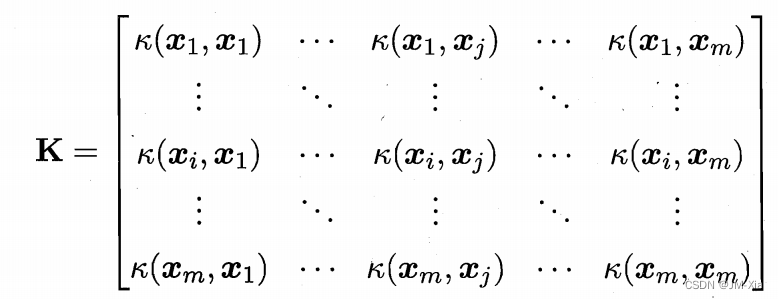

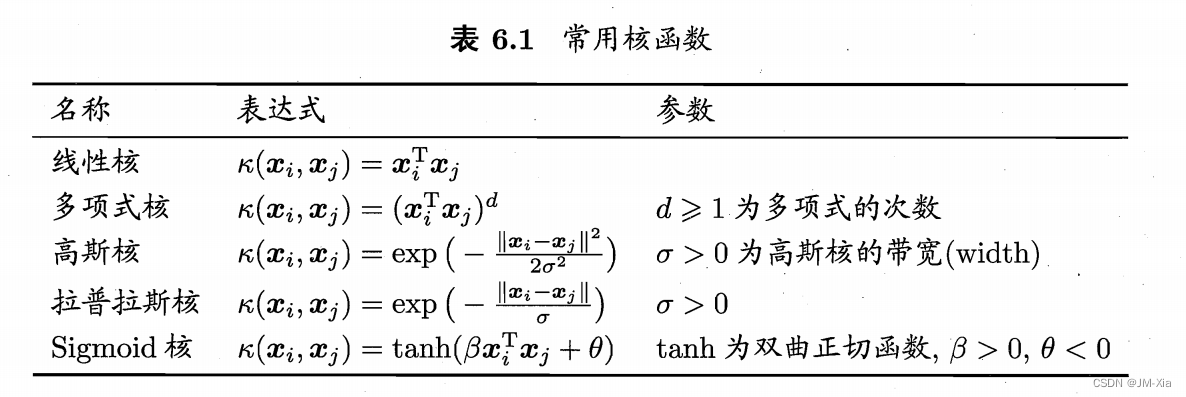

6.3 核函数

Q:在现实任务中,原始样本空间内也许并不存在一个能正确划分两类样本的超平面,如何解决?

可将样本从原始空间映射到一个更高维的特征空间,使得样本在这个特征空间内线性可分

“核函数"

kernel function称“支持向量展式"support

vector expansion

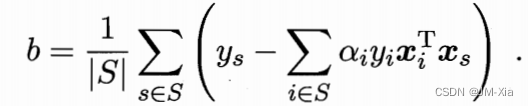

定 理 6.1 核函数: 令X为输入空间,(·,·) 是定义在 XxX上的对称函数,则K是核函数当 且仅当对于任意数据 D = {x1,x2,....,xm }, "核矩阵" ( kernel matrix) K 总是半正定的

只要一个对称函数所对应的核矩阵半正定,.它就能作为核函数使用 。对于一个半正定核矩阵,总能找到一个与之对应的映射 . 即任何一个核函数都隐式地定义了一个称为 “再生核希尔伯特空间”(Reproducing Kernel Hilbert Space,简称 RKHS)的特征空间。

此外,若K1和K2为核函数 ,下式也为核函数

![]()

![]()

![]()

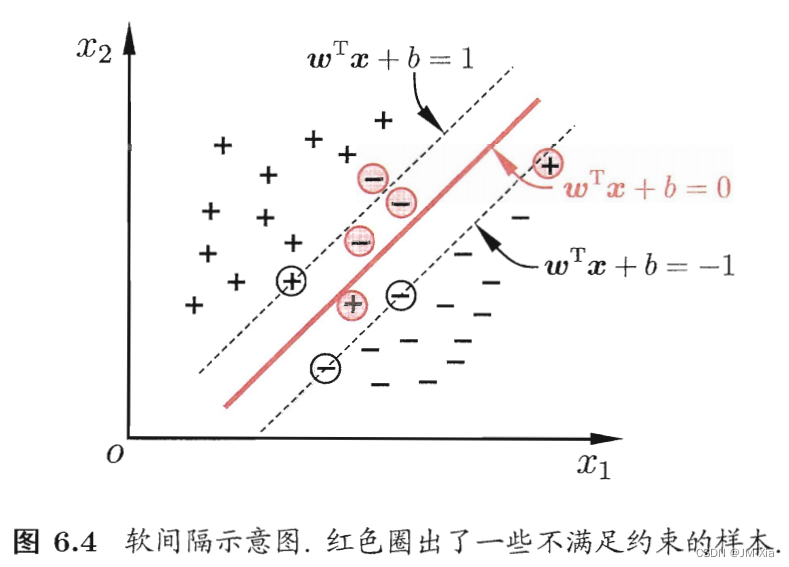

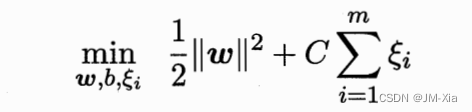

硬间隔 hard margin:前面支持向量机形式要求所有样本均满足约束

软间隔 soft margin:解决过拟合一个办法是允许支持向量机在一些样本上出错

![]()

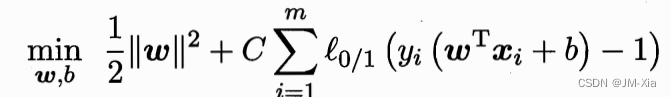

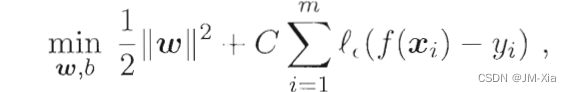

优化目标:

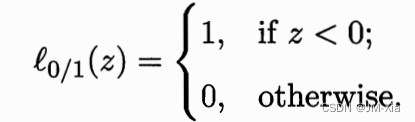

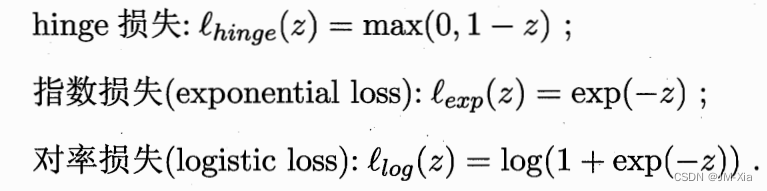

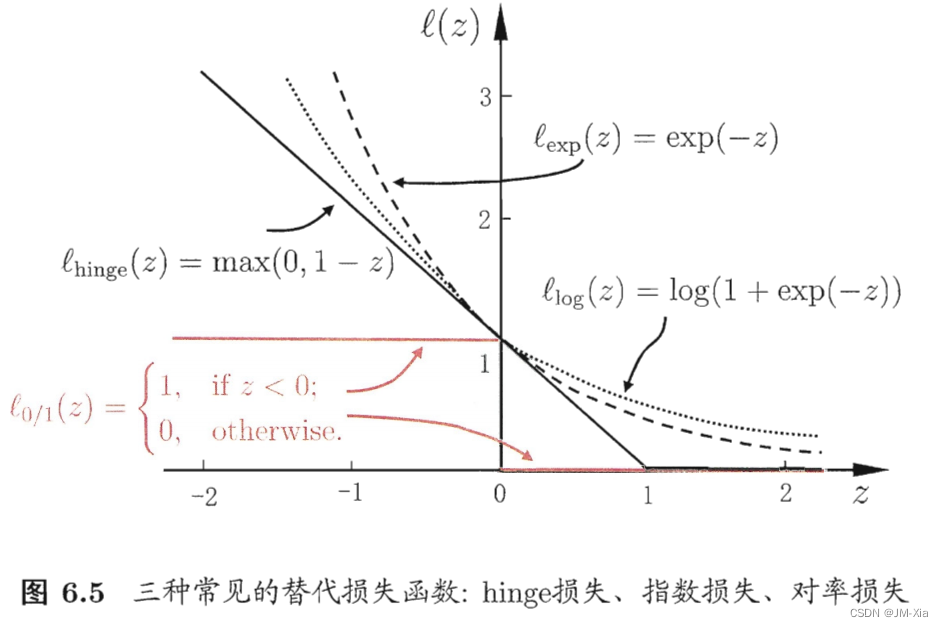

替代损失surrogate loss:因为非凸、非连续,故不易求解,一般用其他一些函数来代替

软间隔支持向量机:

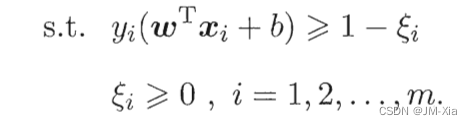

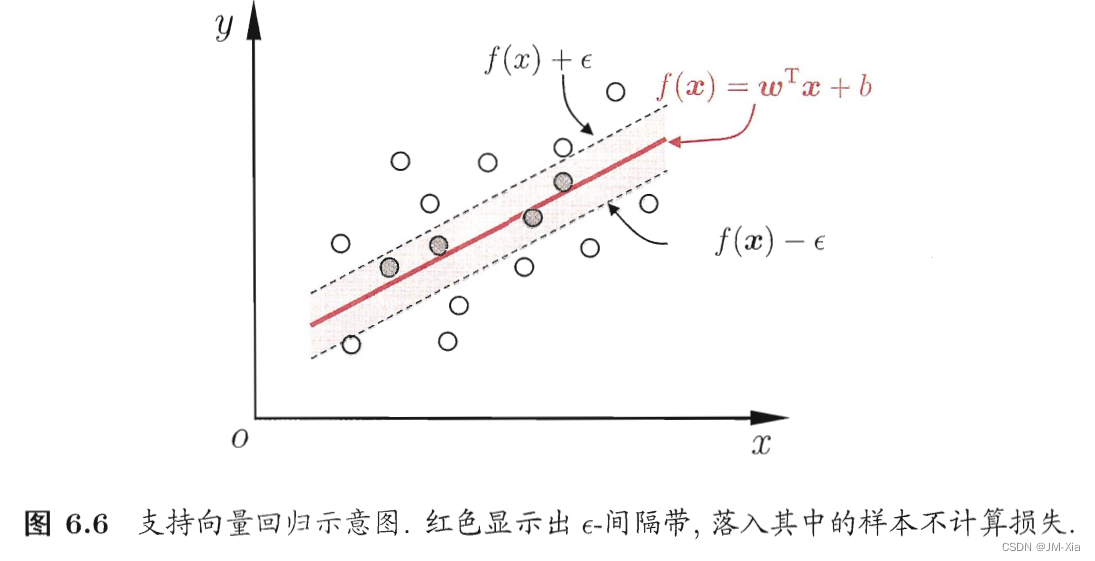

6.5 支持向量回归

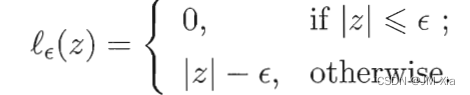

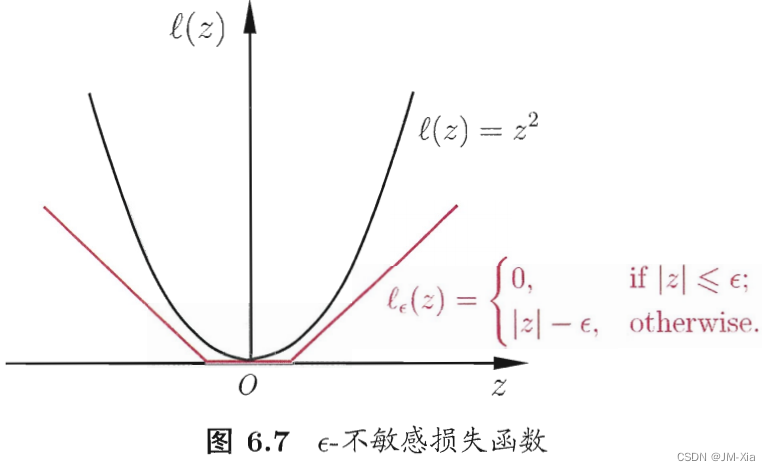

支持向量回归(Support Vector Regression,简称 SVR): 仅当f(x)与 y 之间的差别绝对值大于时才计算损失.如下图 所示,这相当于以 f(x) 为中心,构建了一个宽度为 2

的间隔带,若训练样本落入此间隔带,则认为是被预测正确的。

-不敏感损失

-insensitive loss:

6.6 核方法

定 理 6.2 (表 示 定 理 )令H为核函数对应的再生核希尔伯特空间,

表示H空间中关于h的范数,对于任意单调递增函数

:[0,

]

和任意非负损失函数

:

[0,

],优化问题:

![]()

解:

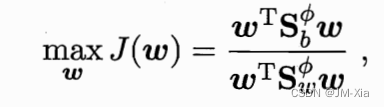

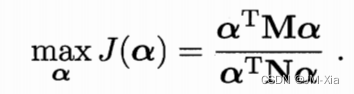

核方法kernel methods: 一系列基于核函数的学习方法的统称。最常见的,是通过 “核化”(即引入核函数)来将线性学习器拓展为非线性学习器.核线性判别分析(Kernelized Linear Discriminant Analysis,简称 KLDA): 线性判别分析通过核化来对其进行非线性拓展。

497

497

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?