本文继续给大家分享ComfyUI的基本使用技巧:抠图,或者说去除背景。抠图是处理图片的一项常见工作,是设计师们的基本能力,现在有了AI,抠图的效率也得到了极大的提升。最近看到有小伙伴通过AI抠图赚了外国人1000美刀,怀着激动的心情,特别把这个技术给大家分享一下。

除了抠图,我还会介绍一下基于抠图的背景替换,不仅会介绍图片背景的替换,也会分享视频背景的替换方法。

大家抓好扶手,我们马上就要开车了。

ComfyUI 是什么?

有的同学可能还不知道 ComfyUI 是什么,我这里做一个简单的介绍。

ComfyUI 是一个基于扩散模型的AI绘画创作工具,扩散模型就是大家常说的 Stable Diffusioin,简称SD。

ComfyUI 使用工作流的方式,可定制性很强,可以让创作者们搞出各种新奇的玩意,也可以实现更高的自动化水平,创作方法更容易传播复现,发展势头特别迅猛。

不过 ComfyUI 的上手门槛有点高,用户需要对 Stable Diffusion 以及各种数字技术的原理有一定的了解才行。这个系列就会介绍 ComfyUI 的一些基础概念和使用方法,让大家更快的掌握 ComfyUI 的使用技巧,创作出自己独特的艺术作品。

到哪里使用 ComfyUI

安装 ComfyUI 的难处

ComfyUI 本身是一个开源软件,大家可以安装到自己的电脑上使用。

但是但是事情往往没有说起来这么简单:

- 首先你要通过Github来下载程序,后续还要下载大量的模型,这需要特殊网络设置;

- 然后你还要懂点电脑技术,需要执行一大堆的命令;

- 最后你还要有一个牛逼的Nvidia显卡,显存8G起步,越大越好。

前两个花点小钱就能解决,最后这个要求可是要花大价钱的,差不多的3090显卡就需要七八千,玩起来没压力的4090更需要1.5个W左右。

AI抠图

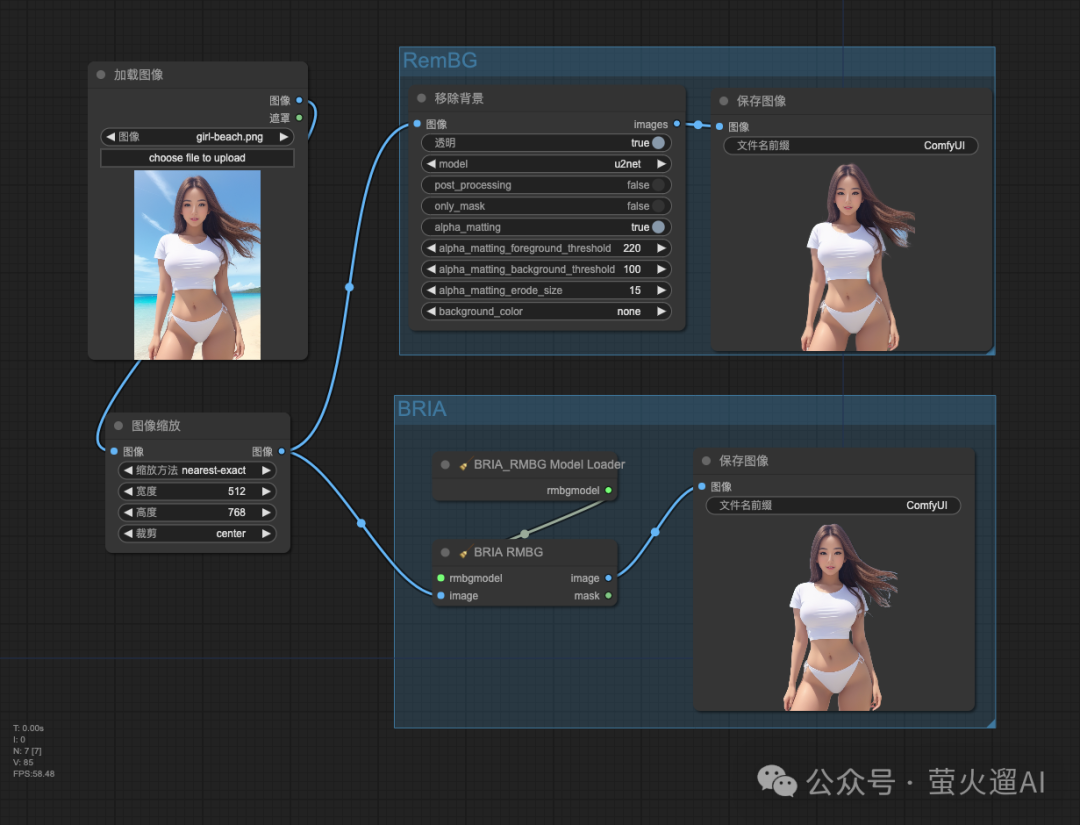

这个工作流很简单,我们直接看下吧。

左边有两个节点:

- 加载图像:就是上传一张待处理的图片。点击“choose file to upload”按钮即可上传。

- 图像缩放:这个不是必需的,只是如果图片太小不容易识别,图片太大则处理的太慢,所以我加了一个缩放,你可以根据自己的需要来,不想要就删掉。

这里分享一个小窍门,如果暂时不想用某个节点,我们可以在这个节点上点击右键,选择“忽略节点”,这个节点就被跳过了。如果想恢复,还是点击这个“忽略节点”。

这个工作流的右边,也有两个节点,其实是两种抠图的方法,很难说哪个更好,大家根据实际效果选择吧。

RemBG:比较老牌的抠图方式,介绍下它的几个参数:

model:有多个抠图模型可供选择:

- u2net:通用的的预训练模型,通常用这个就行。

- u2netp:u2net的轻量级版本。

- u2net_human_seg:专门针对人像分割的预训练模型,只是分割人像时建议使用。

- u2net_cloth_seg:专门从人像上抠衣服的预训练模型,它会把衣服分成三部分:上半身、下半身和全身。

- silueta:和u2net相同,但是大小减少到43Mb,方便在小内存机器上使用。

- isnet-general-use :一个新的通用的预训练模型。

- isnet-anime:专门针对动画人物的高精度分割。

Alpha matting:Alpha遮罩,这是一个比较专业的图像处理术语。在图像处理中,有一个东西用来表示图像中每个像素点的透明度,这个东西称为Alpha通道;Alpha遮罩利用Alpha通道来控制图像的透明度,从而达到隐藏或显示某些部分的目的;在抠图这里就是努力让前景部分都显示出来,让背景部分都变透明。这个选项有三个参数:

-

- Foreground threshold:前景图像的阈值,值过小背景可能被识别为前景,值过大前景可能被识别为背景。

- Background threshold:背景图像的阈值,值小了前景可能被识别为背景,值大了背景可能识别为前景。

- Erode size:Alpha抠图腐蚀尺寸,通过在图像中构建一个长宽为这个值的矩形进行腐蚀。太小了前景和背景分离不彻底,边缘有交叉;太大了前景和背景会腐蚀的太多,边缘缺损明显。

使用Alpha遮罩时可以先用这几个经验值:( 220, 100, 15),具体参数值再根据实际情况进行调整。

BRIA:新进的抠图模型,很多时候效果比RemBG要棒。没啥参数可以设置的,需要两个节点:

- BRIA_RMBG Model Loader:用来加载模型。

- BRIA RMBG:对图片进行抠图。

工作流,以及其中用到的插件、模型,我已经整理好了,需要的同学请到文末获取。

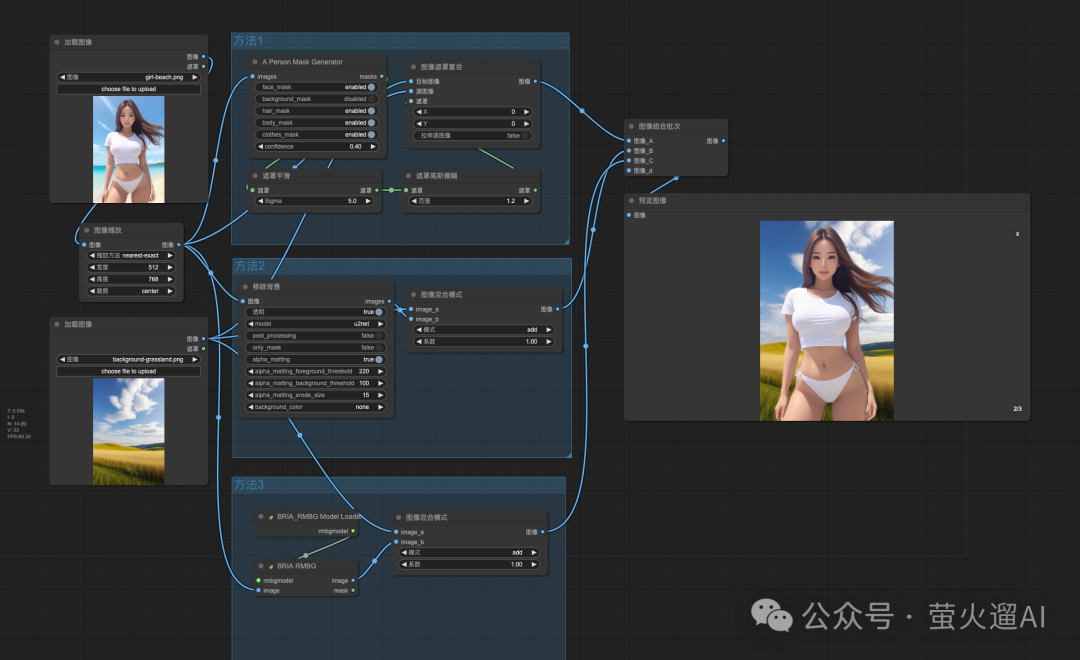

图片背景替换

图片背景替换就是在抠图的基础上再增加图片合成的能力,如下图所示:

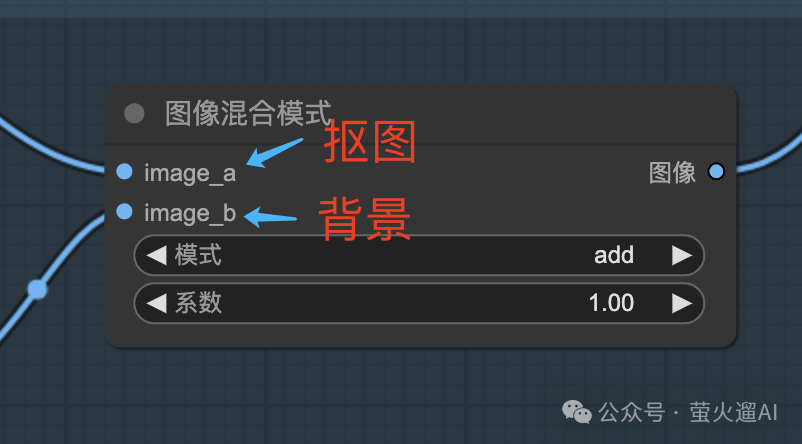

其中增加的就是这个“图像混合模式节点”:

这个节点是 WAS Node Suite 插件提供的,官方访问地址:https://github.com/WASasquatch/was-node-suite-comfyui。

工作流,以及其中用到的插件、模型,我已经整理好了,需要的同学请到文末获取。

视频背景替换

视频背景替换的基本思路是,先把视频帧拆出来,然后一帧帧的替换背景。

我在抖音上找到了一个小姐姐的跳舞视频,准备把视频背景替换成蓝天白云草地。

这个工作流主要由3部分组成,分别介绍下:

加载素材

这里涉及三个节点:

加载视频:选择本地视频上传即可。注意这里的两个参数:

- 强制频率:视频一般都是每秒30帧,但是帧数越多,我们拆出来的图片也越多,所以这里可以适当降低,不影响观看就行了。

- 强制尺寸:太大视频处理起来慢,太小的视频可能效果不好,这里可以调整下。Custom Height 就是固定高度,宽度自适应。

视频信息:提取出视频的宽高、帧数、帧率等,后边合成新视频的时候会用到这个帧率,提取出来就不用手动设置了。

加载图像:这里就是要使用的视频新背景,注意和视频的宽高保持一致。

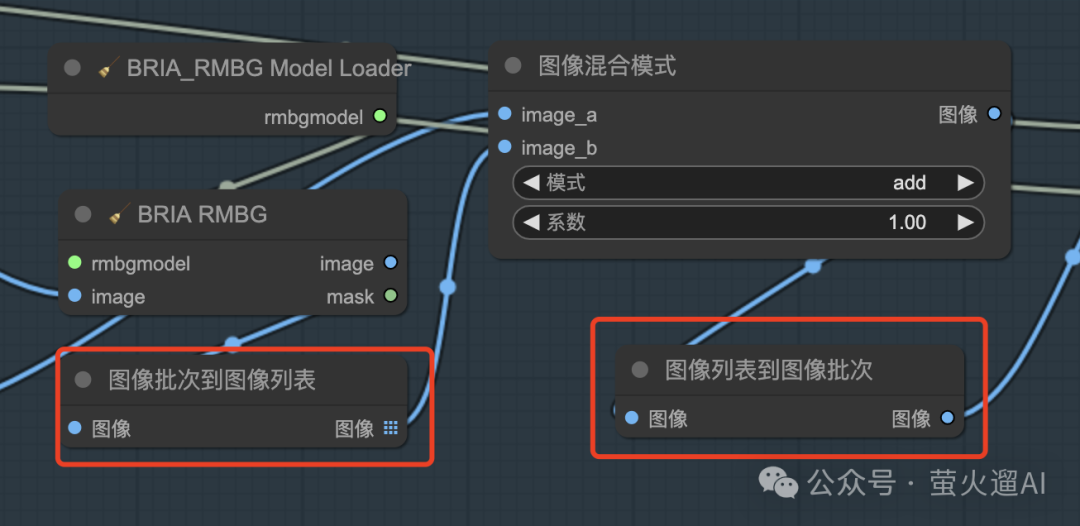

替换背景

主要节点和设置前边替换图片背景已经讲过了,注意这里增加了两个信息的节点:

图像批次到图像列表、图像列表到图像批次

主要是因为视频需要的是图像批次,而图像混合需要的是图像列表,做一个适配而已。

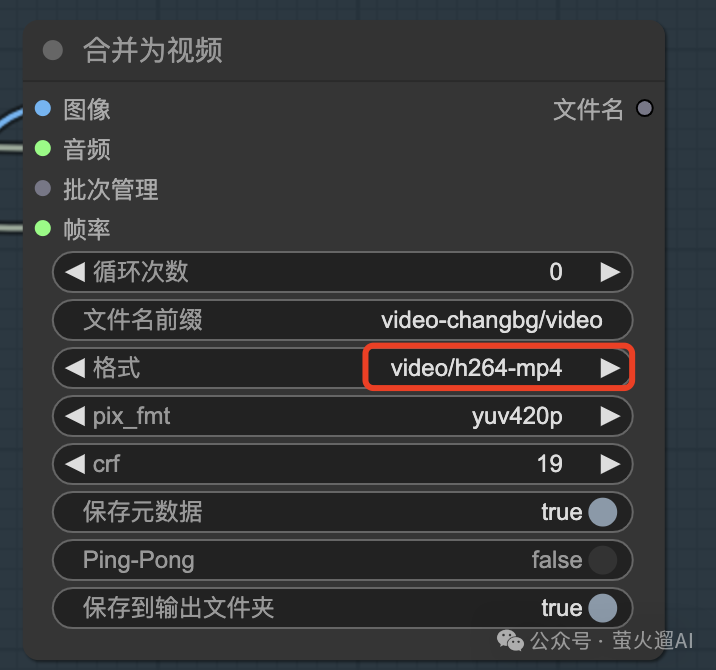

合成视频

最后就是合成视频了,注意选择格式为mp4, 别的没什么好讲的。

合并为视频使用的是插件:ComfyUI-VideoHelperSuite,官方程序地址:https://github.com/Kosinkadink/ComfyUI-VideoHelperSuite

最后小姐姐跳舞的视频可以在这里看:

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

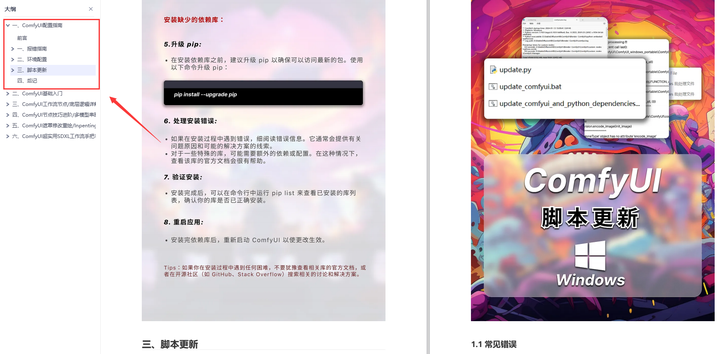

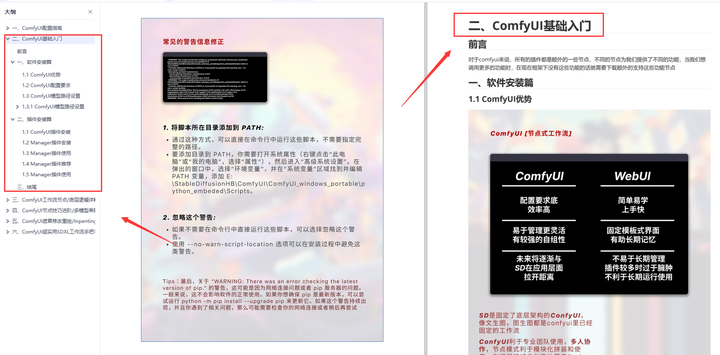

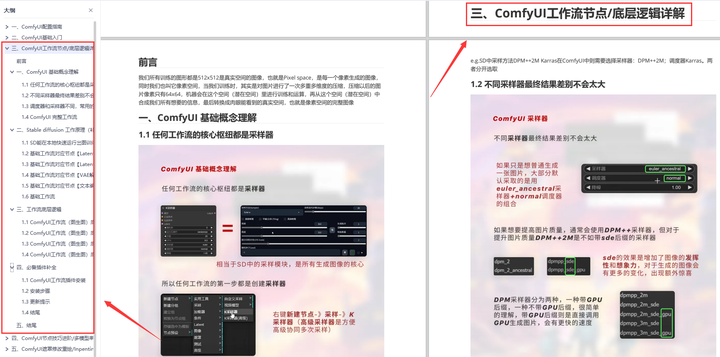

为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

需要的可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

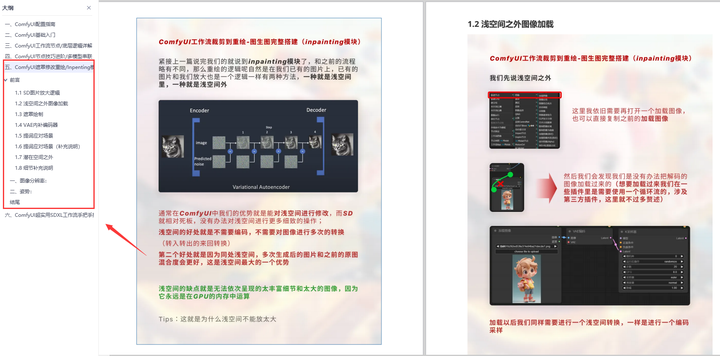

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

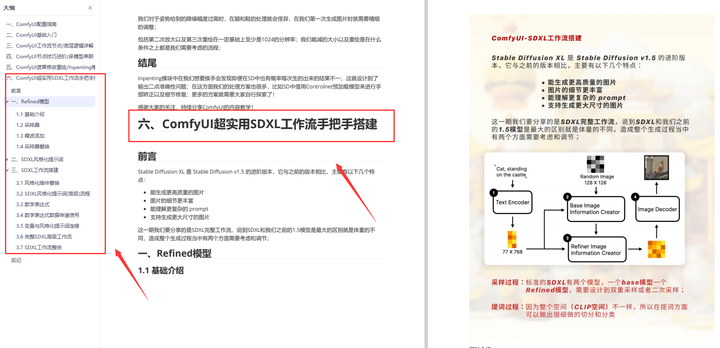

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

320

320

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?