一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、Python必备开发工具

工具都帮大家整理好了,安装就可直接上手!

三、最新Python学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、Python视频合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试宝典

简历模板

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

©mydadadaw

由于是静态网页,我用的是绝对路径 ,我就直接存放在桌面的目录里: C:\Users\伟\Desktop\网页作业\另一个网页作业\11.html

二、解析网页

第一步:使用BeautifulSoup 解析网页(这个库是python自带的)

Soup = BeautigulSoup(html,’lxml’)

(PS:lxml为解析网页所需要的库,在python中这个库是没有的,所以我们需要进入cmd 进行自主安装“pip install lxml”,这里我会在后面在介绍另外四种解析网页库,分别是:”html parser”,”lxml HTML”, ”lxml xml”, ”html 51ib”)

第二步:扫描抓取的东西在哪

资源 = Soup.select(‘???’)

第三步:从标签中获得你要的information(信息)

<p>Something</p> (网页的段落标签)

tittle = Something

rate = 4.0

BeautifulSoup => CSS Select:

一个网页的基本结构

Xpath与CSS解析网页的比较

Xpath:谁,在哪,哪几个 (之后再讲)

CSS Select:谁在哪,第几个,长什么样(我们接下来的爬虫就主要用copy selector找我们需要的内容)

三、写Python代码来爬取我们写的网页

这四行代码就可以实现我们网页的爬取

from bs4 import BeautifulSoup

with open(‘/Users/伟/Desktop/网页作业/另一个网页作业/11.html’,‘r’) as wb_data:

Soup = BeautifulSoup(wb_data,‘lxml’)

print(Soup)

‘’’

这里 第行的语句的意思是打开我们这个目录下的这个网页文件,r代表只读

‘’’

这样就把我们整个网页的数据抓取过来了,但是结果并不是我们想要的

我们要将爬取的网页进行分析

还是点开我们写的网页,抓取我们需要的图片

找到图片img这一行,然后右键,copy,找到,copy selector

body > div.main-content > ul > li:nth-child(1) > img,这就是我们所需要抓取的图片的代码

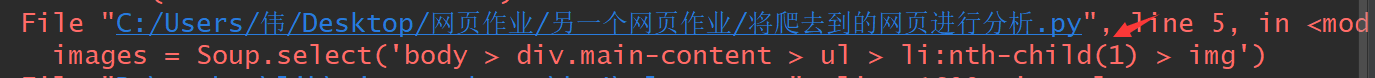

images = Soup.select(‘body > div.main-content > ul > li:nth-child(1) > img’)

放进**pycharm(Python编辑器)**中进行抓取

后面再打印我们所抓取的图片信息

print(images)

但我们放进python中,它会报错,因为我们没有按照他的格式进行

因此,我们要将代码

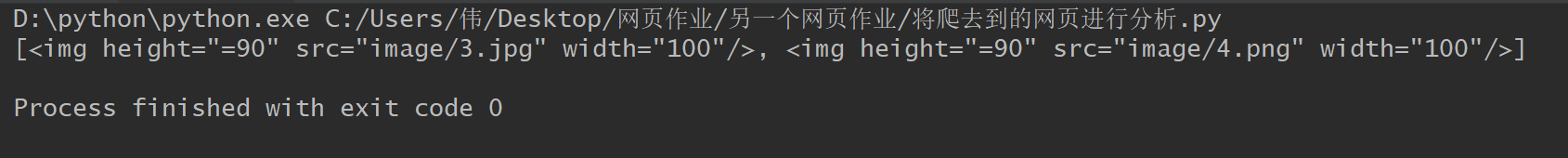

红色的部分删除,就可以得到这一类图片的信息

这里和我们加上的两个图片完全一致

然后我们在抓取我们需要的其他信息,附上全部代码

from bs4 import BeautifulSoup

with open(‘/Users/伟/Desktop/网页作业/另一个网页作业/11.html’,‘r’) as wb_data:

Soup = BeautifulSoup(wb_data,‘lxml’)

images = Soup.select(‘body > div.main-content > ul > li > img’)

p = Soup.select(‘body > div.main-content > ul > li > p’)

tittle = Soup.select(‘body > div.main-content > ul > li > h3’)

print(images,p,tittle,sep=‘\n-----\n’)

这就是我们抓取到的信息

[ ,

,  ]

]

[

Say sonmething

,Say sonmething

][

The bath

,The bath

]虽然,这里抓取到的东西还是会有网页的代码,所以我们要对内容进行筛选

在代码中加上判断结构即可得到我们所需要的内容

最后

不知道你们用的什么环境,我一般都是用的Python3.6环境和pycharm解释器,没有软件,或者没有资料,没人解答问题,都可以免费领取(包括今天的代码),过几天我还会做个视频教程出来,有需要也可以领取~

给大家准备的学习资料包括但不限于:

Python 环境、pycharm编辑器/永久激活/翻译插件

python 零基础视频教程

Python 界面开发实战教程

Python 爬虫实战教程

Python 数据分析实战教程

python 游戏开发实战教程

Python 电子书100本

Python 学习路线规划

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

882

882

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?