print(“=======================================”)

print(df2)

print(“=======================================”)

df_merge = pd.merge(df1, df2, left_index=True, right_index=True)

print(df_merge)

相比方法①,区别在于,如图,方法②合并出的数据中有重复列。

重要参数

pd.merge(right,how=‘inner’, on=“None”, left_on=“None”, right_on=“None”, left_index=False, right_index=False )

| 参数 | 描述 |

| — | — |

| left | 左表,合并对象,DataFrame或Series |

| right | 右表,合并对象,DataFrame或Series |

| how | 合并方式,可以是left(左合并), right(右合并), outer(外合并), inner(内合并) |

| on | 基准列 的列名 |

| left_on | 左表基准列列名 |

| right_on | 右表基准列列名 |

| left_index | 左列是否以index为基准,默认False,否 |

| right_index | 右列是否以index为基准,默认False,否 |

其中,left_index与right_index 不能与 on 同时指定。

合并方式 left right outer inner

准备数据‘

新准备一组数据:

import pandas as pd

df1 = pd.DataFrame({‘id’: [‘001’, ‘002’, ‘003’],

‘num1’: [120, 101, 104],

‘num2’: [110, 102, 121],

‘num3’: [105, 120, 113]})

df2 = pd.DataFrame({‘id’: [‘001’, ‘004’, ‘003’],

‘num4’: [80, 86, 79]})

print(df1)

print(“=======================================”)

print(df2)

print(“=======================================”)

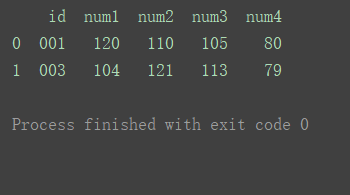

inner(默认)

使用来自两个数据集的键的交集

df_merge = pd.merge(df1, df2, on=‘id’)

print(df_merge)

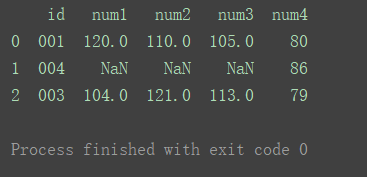

outer

使用来自两个数据集的键的并集

df_merge = pd.merge(df1, df2, on=‘id’, how=“outer”)

print(df_merge)

left

使用来自左数据集的键

df_merge = pd.merge(df1, df2, on=‘id’, how=‘left’)

print(df_merge)

right

使用来自右数据集的键

df_merge = pd.merge(df1, df2, on=‘id’, how=‘right’)

print(df_merge)

import pandas as pd

df1 = pd.DataFrame({‘id’: [‘001’, ‘002’, ‘003’],

‘num1’: [120, 101, 104],

‘num2’: [110, 102, 121],

‘num3’: [105, 120, 113]})

df2 = pd.DataFrame({‘id’: [‘001’, ‘001’, ‘003’],

‘num4’: [80, 86, 79]})

print(df1)

print(“=======================================”)

print(df2)

print(“=======================================”)

如图,df2中有重复id1的数据。

合并

df_merge = pd.merge(df1, df2, on=‘id’)

print(df_merge)

合并结果如图所示:

依然按照默认的Inner方式,使用来自两个数据集的键的交集。且重复的键的行会在合并结果中体现为多行。

如图表1和表2中都存在多行id重复的。

import pandas as pd

df1 = pd.DataFrame({‘id’: [‘001’, ‘002’, ‘002’, ‘002’, ‘003’],

‘num1’: [120, 101, 104, 114, 123],

‘num2’: [110, 102, 121, 113, 126],

‘num3’: [105, 120, 113, 124, 128]})

df2 = pd.DataFrame({‘id’: [‘001’, ‘001’, ‘002’, ‘003’, ‘001’],

‘num4’: [80, 86, 79, 88, 93]})

print(df1)

print(“=======================================”)

print(df2)

print(“=======================================”)

df_merge = pd.merge(df1, df2, on=‘id’)

print(df_merge)

==============================================================================

pd.concat(objs, axis=0, join=‘outer’, ignore_index:bool=False,keys=None,levels=None,names=None, verify_integrity:bool=False,sort:bool=False,copy:bool=True)

| 参数 | 描述 |

| — | — |

| objs | Series,DataFrame或Panel对象的序列或映射 |

| axis | 默认为0,表示列。如果为1则表示行。 |

| join | 默认为"outer",也可以为"inner" |

| ignore_index | 默认为False,表示保留索引(不忽略)。设为True则表示忽略索引。 |

其他重要参数通过实例说明。

首先准备三组DataFrame数据:

import pandas as pd

df1 = pd.DataFrame({‘id’: [‘001’, ‘002’, ‘003’],

‘num1’: [120, 114, 123],

‘num2’: [110, 102, 121],

‘num3’: [113, 124, 128]})

df2 = pd.DataFrame({‘id’: [‘004’, ‘005’],

‘num1’: [120, 101],

‘num2’: [113, 126],

‘num3’: [105, 128]})

df3 = pd.DataFrame({‘id’: [‘007’, ‘008’, ‘009’],

‘num1’: [120, 101, 125],

‘num2’: [113, 126, 163],

‘num3’: [105, 128, 114]})

print(df1)

print(“=======================================”)

print(df2)

print(“=======================================”)

print(df3)

合并

dfs = [df1, df2, df3]

result = pd.concat(dfs)

print(result)

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

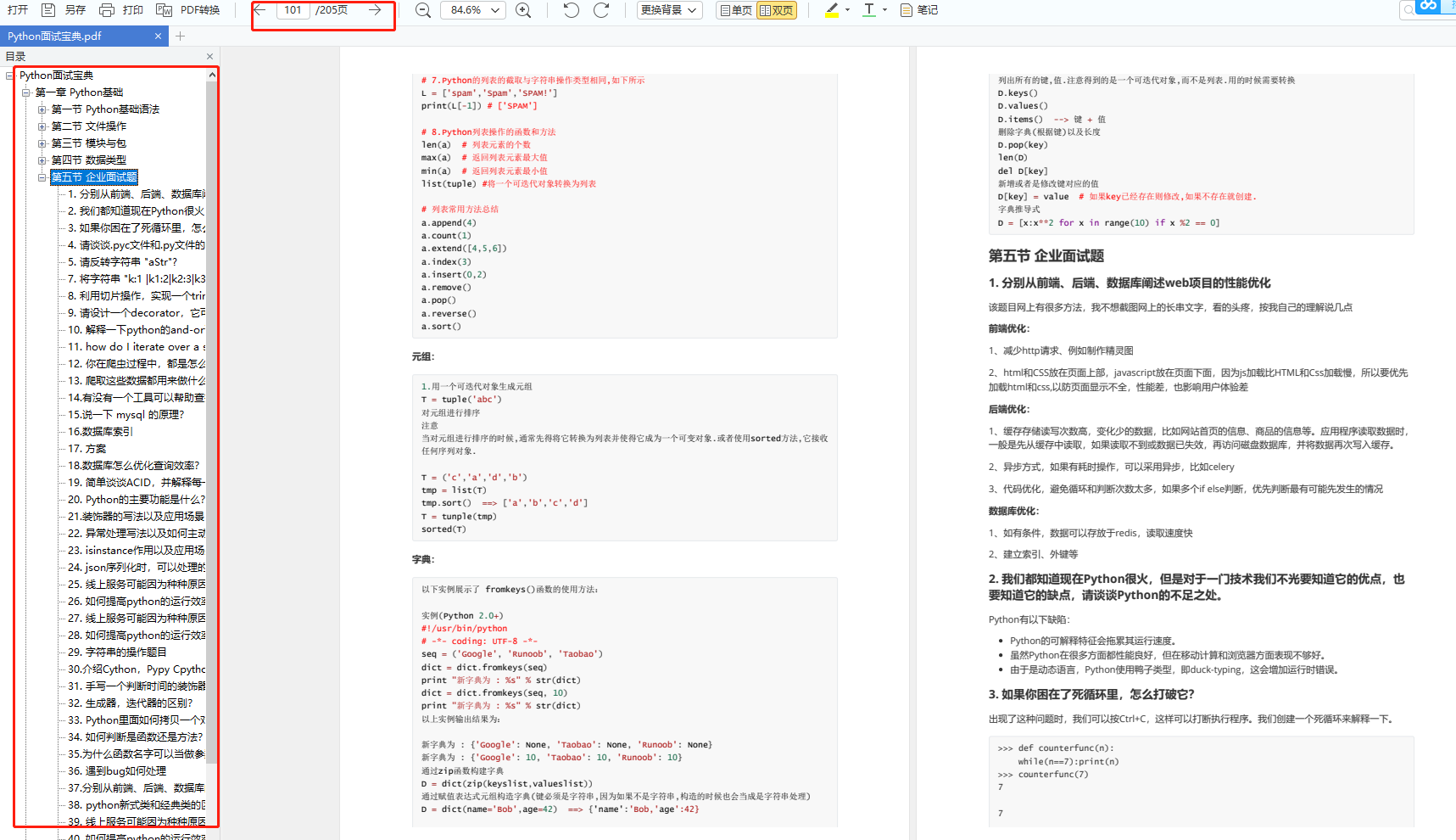

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

五、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

本文详细介绍了Pandas库中DataFrame对象的合并方法,包括内连接(默认)、外连接、左连接和右连接,以及如何处理多对一、多对多情况,以及使用`concat`函数进行表的首尾相连。

本文详细介绍了Pandas库中DataFrame对象的合并方法,包括内连接(默认)、外连接、左连接和右连接,以及如何处理多对一、多对多情况,以及使用`concat`函数进行表的首尾相连。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?