在更改其他节点都不行的情况下,先往下进行,但apt不更新可能会导致有些软件无法下载。

⑥sudo apt-get install vim ,下载vim

⑦sudo apt-get install openssh-server 安装 SSH server

⑧ssh localhost ,登录本机

⑨设置无密码登录

exit # 退出刚才的 ssh localhost

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车就可以

cat ./id_rsa.pub >> ./authorized_keys # 加入授权

⑩ssh localhost

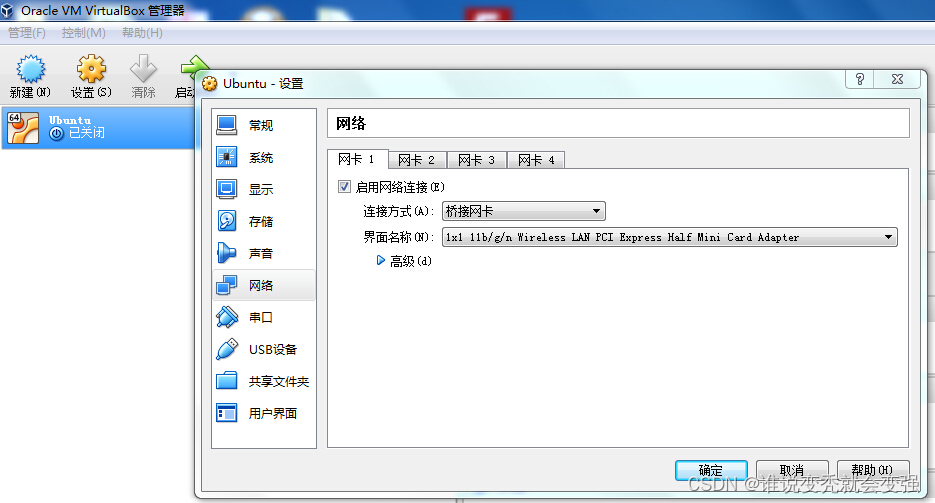

关机,在VirtualBox更改网络连接方式为桥接网卡。

通过FTP软件把三个文件上传到一个你能在虚拟机找到的地方,比方说Downloads/下载,然后在虚拟机上cd,切换到该目录下,对文件进行解压相关操作。

解压:

- sudo tar -zxf ~/下载/hadoop-2.6.0.tar.gz -C /usr/local

- cd /usr/local/

- sudo mv ./hadoop-2.6.0/ ./hadoop

- sudo chown -R hadoop ./hadoop

- cd /usr/local/hadoop

- ./bin/hadoop version 查看是否安装成功

hadoop到这里就结束了,伪分布式或其他方式配置参考林老师的教程,学习spark可以暂时不继续配hadoop

6.Java部分

①cd /usr/lib

②sudo mkdir jvm #创建/usr/lib/jvm目录用来存放JDK文件

③cd ~

④cd Downloads

⑤sudo tar -zxvf ./jdk-8u162-linux-x64.tar.gz -C /usr/lib/jvm #把JDK文件解压到/usr/lib/jvm目录下

⑥cd ~

⑦vim ~/.bashrc

文件开头摁住a:append修改文件(esc退出编辑,wq保存文件)添加:

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

⑧source ~/.bashrc

⑨java -version 查看是否安装成功

7.Spark部分

①sudo tar -zxf ~/下载/spark-2.1.0-bin-without-hadoop.tgz -C /usr/local/

②cd /usr/local

③sudo mv ./spark-2.1.0-bin-without-hadoop/ ./spark

④sudo chown -R hadoop:hadoop ./spark # 此处的 hadoop 为你的用户名

⑤cd /usr/local/spark

⑥cp ./conf/spark-env.sh.template ./conf/spark-env.sh

去虚拟机找这个spark-env.sh文件,右击,vim编辑,首行添加

export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/bin/hadoop classpath)

⑦vim ~/.bashrc

首行添加:

export JAVA_HOME=/usr/lib/jvm/jdk1.8.0_162

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=$PATH:${JAVA_HOME}/bin:/usr/local/hbase/bin

export HADOOP_HOME=/usr/local/hadoop

export SPARK_HOME=/usr/local/spark

export PYTHONPATH=$SPARK_HOME/python:$SPARK_HOME/python/lib/py4j-0.10.4-src.zip:$PYTHONPATH

export PYSPARK_PYTHON=python3

export PATH=$HADOOP_HOME/bin:$SPARK_HOME/bin:$PATH

PYTHONPATH这一行有个py4j-0.10.4-src.zip,这个zip文件的版本号一定要和“/usr/local/spark/python/lib”目录下的py4j-0.10.4-src.zip文件保持版本一致。

⑧source ~/.bashrc

⑨cd /usr/local/spark

⑩bin/run-example SparkPi 2>&1 | grep “Pi is” 验证spark是否安装成功,成功则会输出圆周率

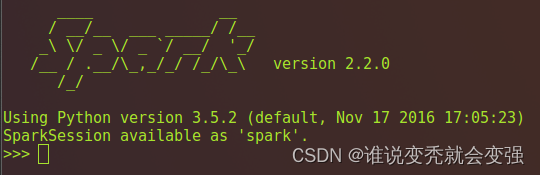

运行pyspark

bin/pyspark

如图所示即为运行成功,exit()退出。

注意事项

所有shell指令务必按顺序执行,本人亲测有效。

要仔细注意FTP传到虚拟机的文件在哪里,解压的时候若切换到了错误的目录,会提示文件不存在。

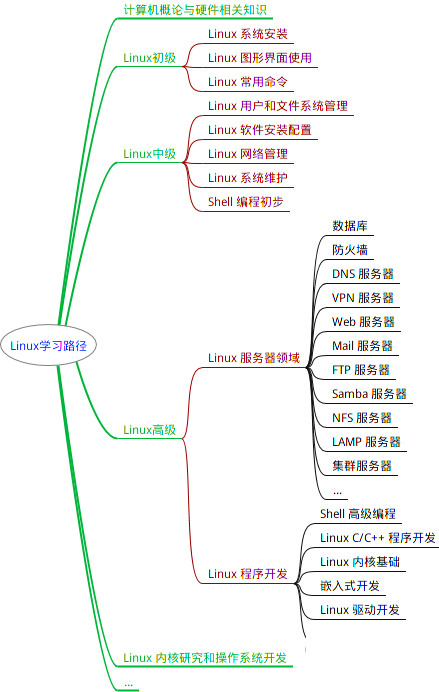

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Linux运维工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

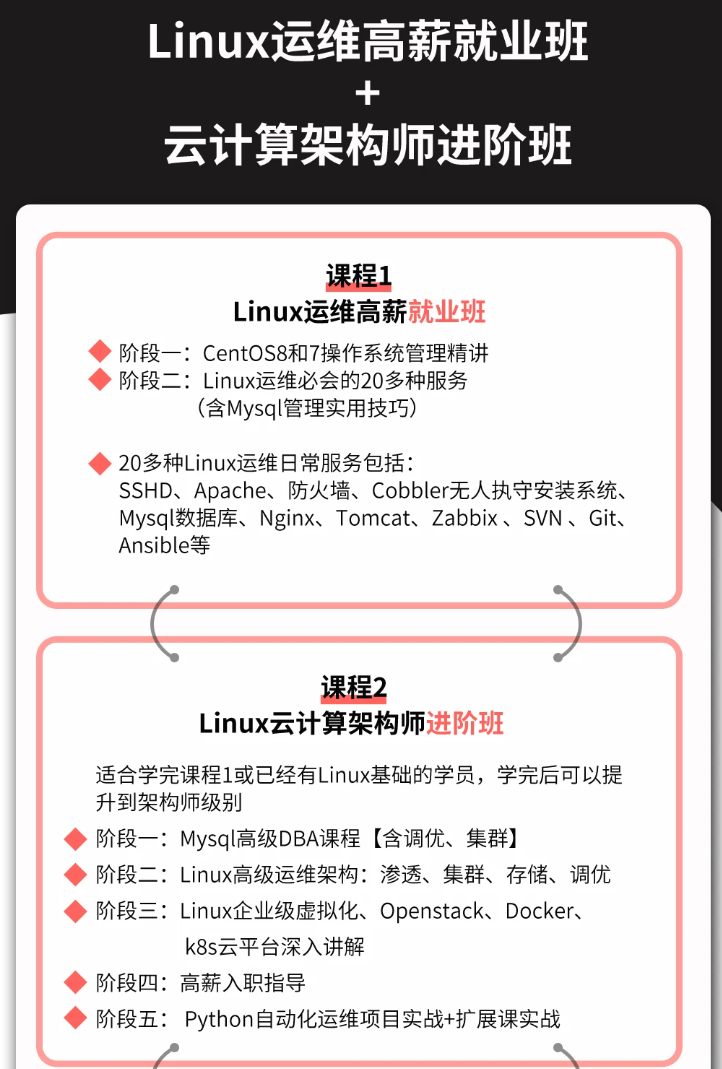

因此收集整理了一份《2024年Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Linux运维知识点,真正体系化!

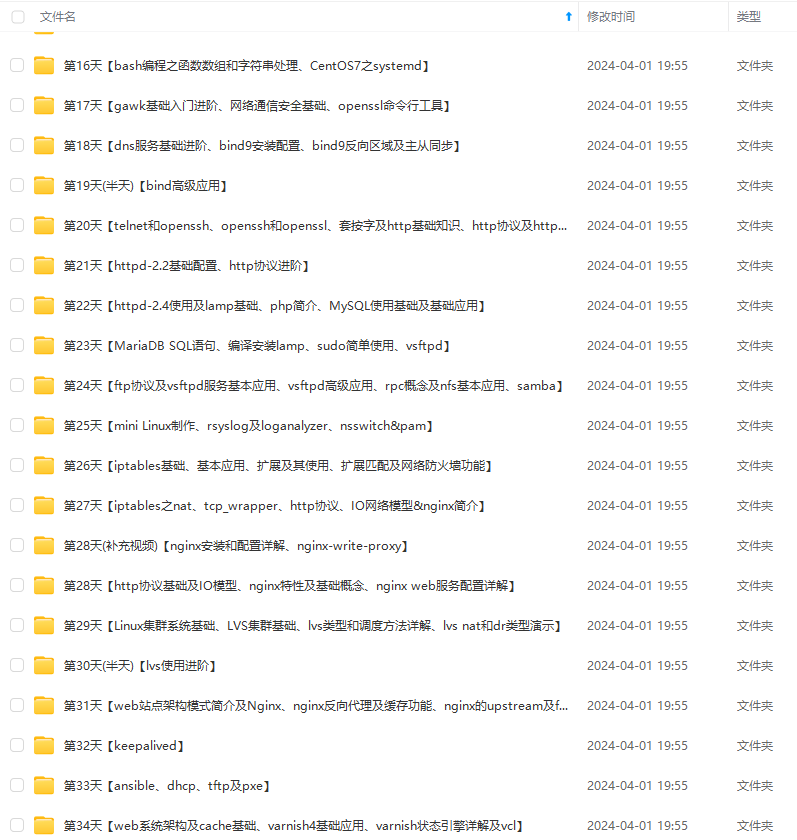

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip1024b (备注Linux运维获取)

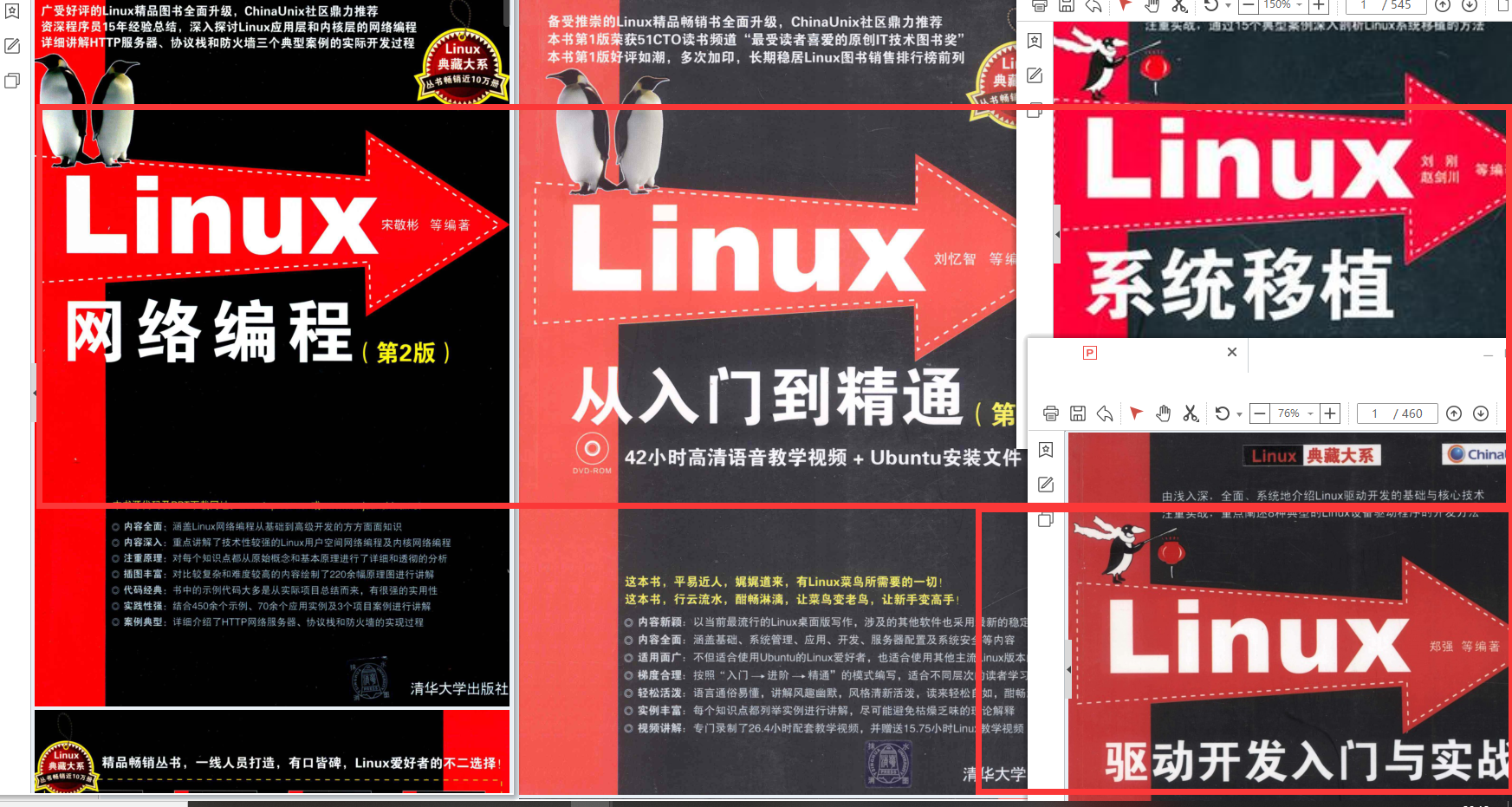

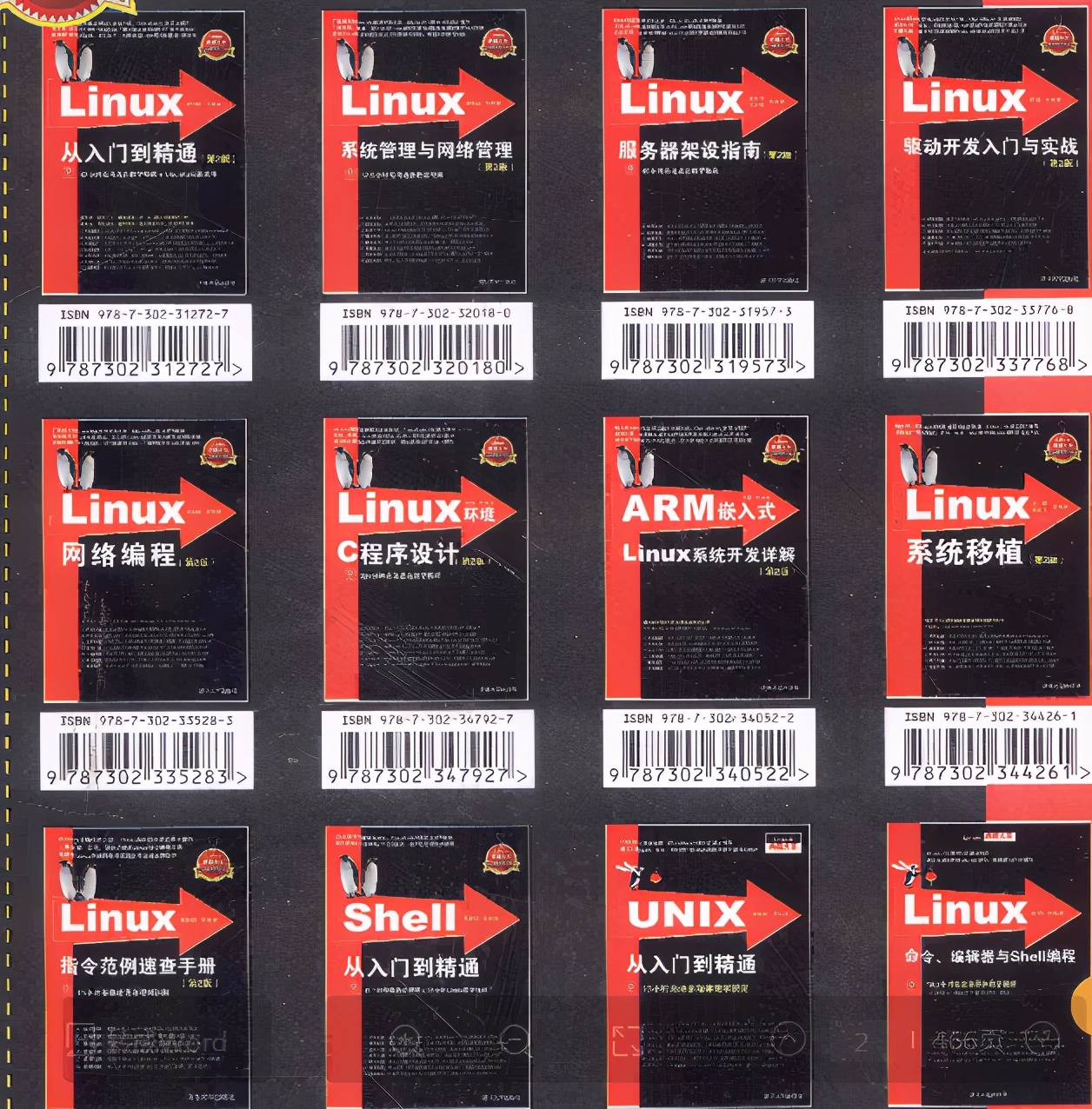

最全的Linux教程,Linux从入门到精通

======================

-

linux从入门到精通(第2版)

-

Linux系统移植

-

Linux驱动开发入门与实战

-

LINUX 系统移植 第2版

-

Linux开源网络全栈详解 从DPDK到OpenFlow

第一份《Linux从入门到精通》466页

====================

内容简介

====

本书是获得了很多读者好评的Linux经典畅销书**《Linux从入门到精通》的第2版**。本书第1版出版后曾经多次印刷,并被51CTO读书频道评为“最受读者喜爱的原创IT技术图书奖”。本书第﹖版以最新的Ubuntu 12.04为版本,循序渐进地向读者介绍了Linux 的基础应用、系统管理、网络应用、娱乐和办公、程序开发、服务器配置、系统安全等。本书附带1张光盘,内容为本书配套多媒体教学视频。另外,本书还为读者提供了大量的Linux学习资料和Ubuntu安装镜像文件,供读者免费下载。

本书适合广大Linux初中级用户、开源软件爱好者和大专院校的学生阅读,同时也非常适合准备从事Linux平台开发的各类人员。

需要《Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

一个人可以走的很快,但一群人才能走的更远。如果你从事以下工作或对以下感兴趣,欢迎戳这里加入程序员的圈子,让我们一起学习成长!

AI人工智能、Android移动开发、AIGC大模型、C C#、Go语言、Java、Linux运维、云计算、MySQL、PMP、网络安全、Python爬虫、UE5、UI设计、Unity3D、Web前端开发、产品经理、车载开发、大数据、鸿蒙、计算机网络、嵌入式物联网、软件测试、数据结构与算法、音视频开发、Flutter、IOS开发、PHP开发、.NET、安卓逆向、云计算

.net/forums/4304bb5a486d4c3ab8389e65ecb71ac0)

AI人工智能、Android移动开发、AIGC大模型、C C#、Go语言、Java、Linux运维、云计算、MySQL、PMP、网络安全、Python爬虫、UE5、UI设计、Unity3D、Web前端开发、产品经理、车载开发、大数据、鸿蒙、计算机网络、嵌入式物联网、软件测试、数据结构与算法、音视频开发、Flutter、IOS开发、PHP开发、.NET、安卓逆向、云计算

https://dblab.xmu.edu.cn/blog/7/

https://dblab.xmu.edu.cn/blog/7/

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?