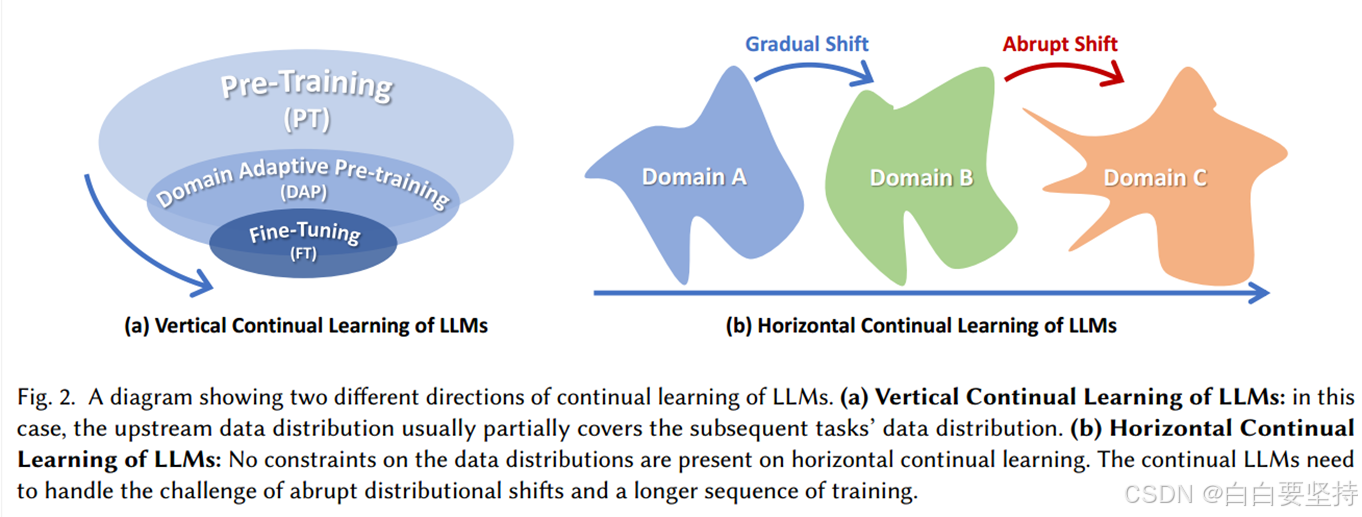

一篇关于持续学习及大语言模型持续学习的综述文章,正文以垂直连续性(或垂直连续学习)和水平连续性(或水平连续学习)为主要框架,重点介绍LLM垂直持续学习的方法,即,顶层持续预训练CPT、中间层领域自适应持续预训练DAP、底层持续微调CFT。接着描述了数据集、评价指标及展望方向。附录包含了传统方法的问题定义及分析、评价指标。

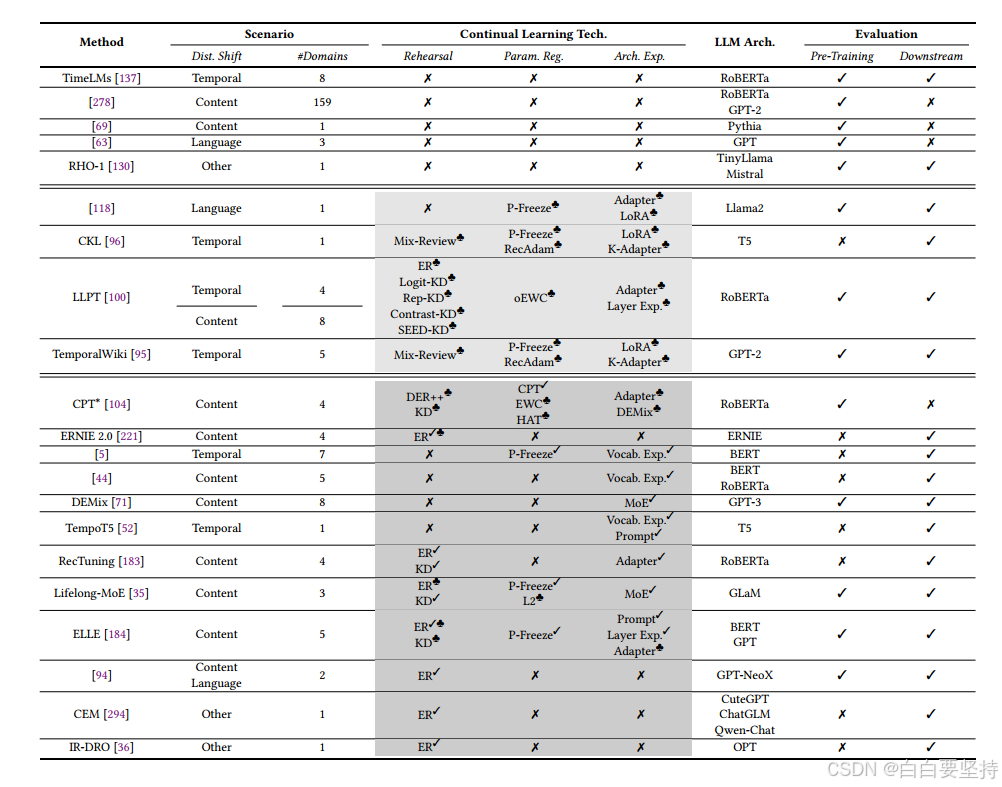

文中包含了传统持续学习及LLM持续学习的不同关注点。

LLM持续预训练

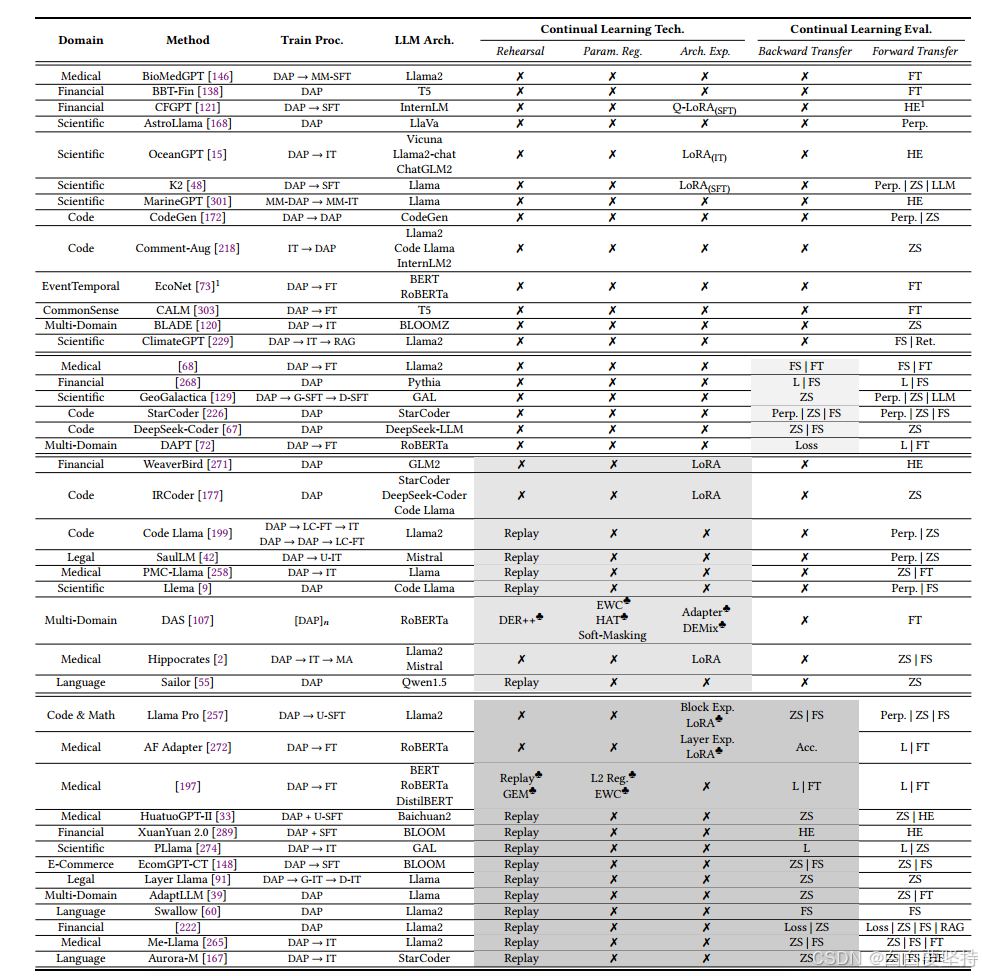

LLM领域自适应预训练

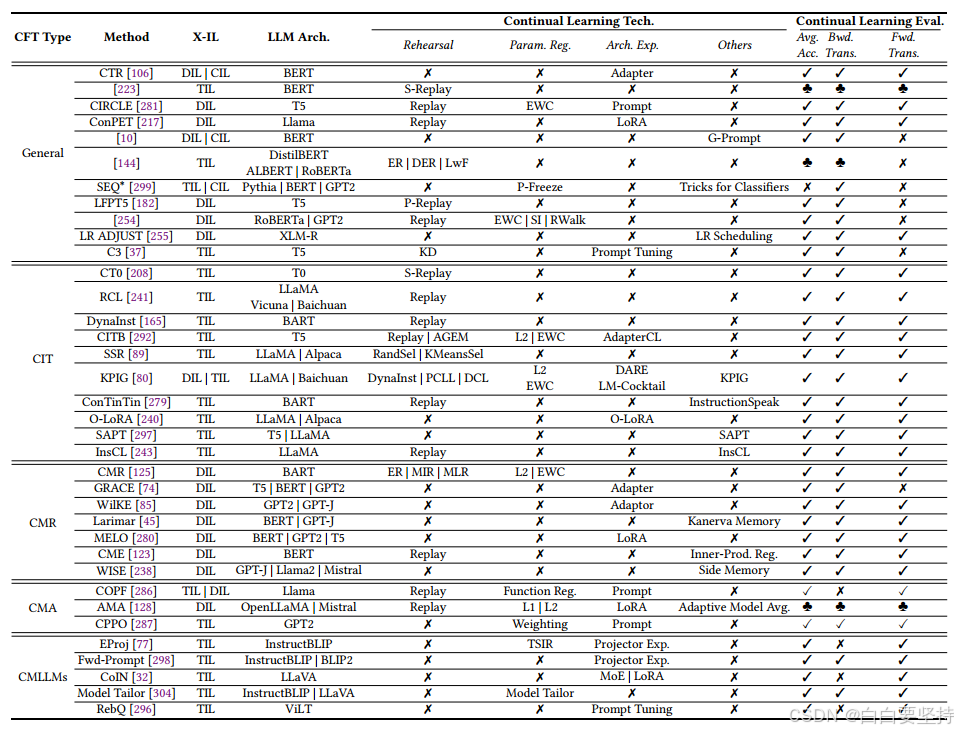

LLM持续微调

Shi H, Xu Z, Wang H, et al. Continual learning of large language models: A comprehensive survey[J]. arXiv preprint arXiv:2404.16789, 2024.

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?