先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Python全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Python知识点,真正体系化!

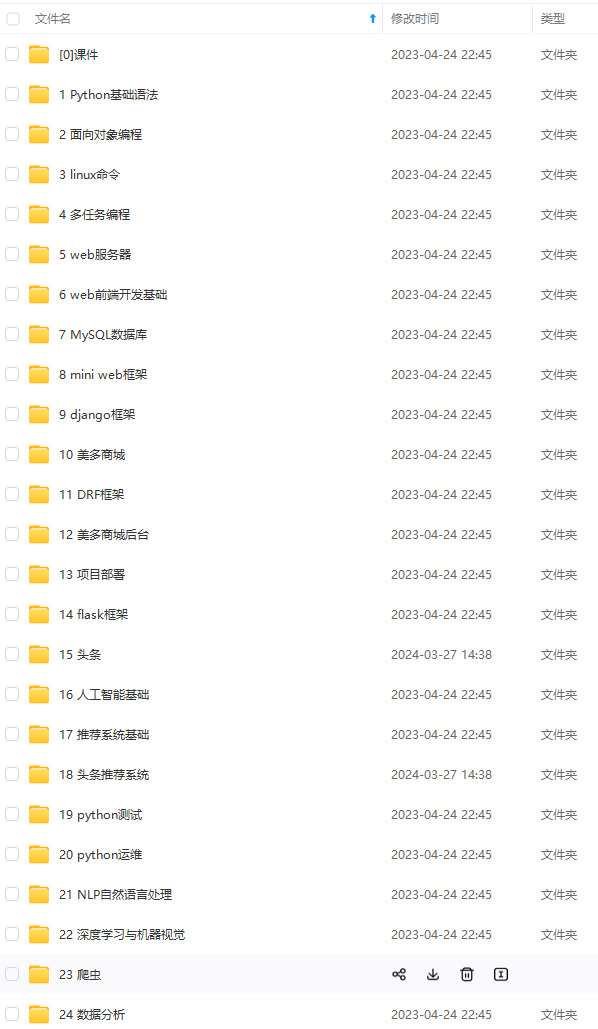

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024c (备注Python)

正文

except requests.exceptions.RequestException as e:

access_results.append(f'Failed to access: {link}, Error: {e}')

输出访问结果

for result in access_results:

print(result)

winsound.Beep(1000, 500) # 爬取完毕响铃提示

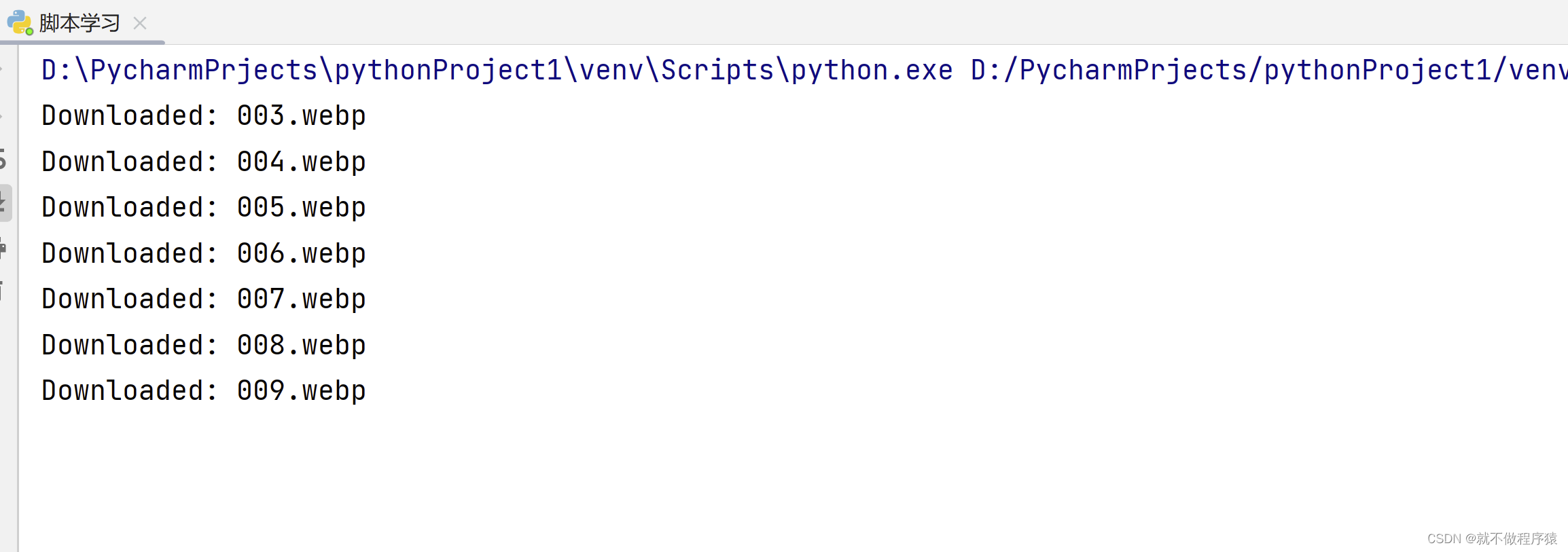

直接运行,可以看到下载成功了,当然在运行过程中,因为网络问题会出现下载失败的问题,可以多运行几次,进行覆盖。

虽然这算是个半自动爬虫,但是在网页有很多图片的时候,会大大提高效率,这种手动绕过JavaScript动态渲染也是初学者可以使用的思路。

## 全自动版

当然我觉得这样太慢,后来又补充了一个版本,是全自动化的了。

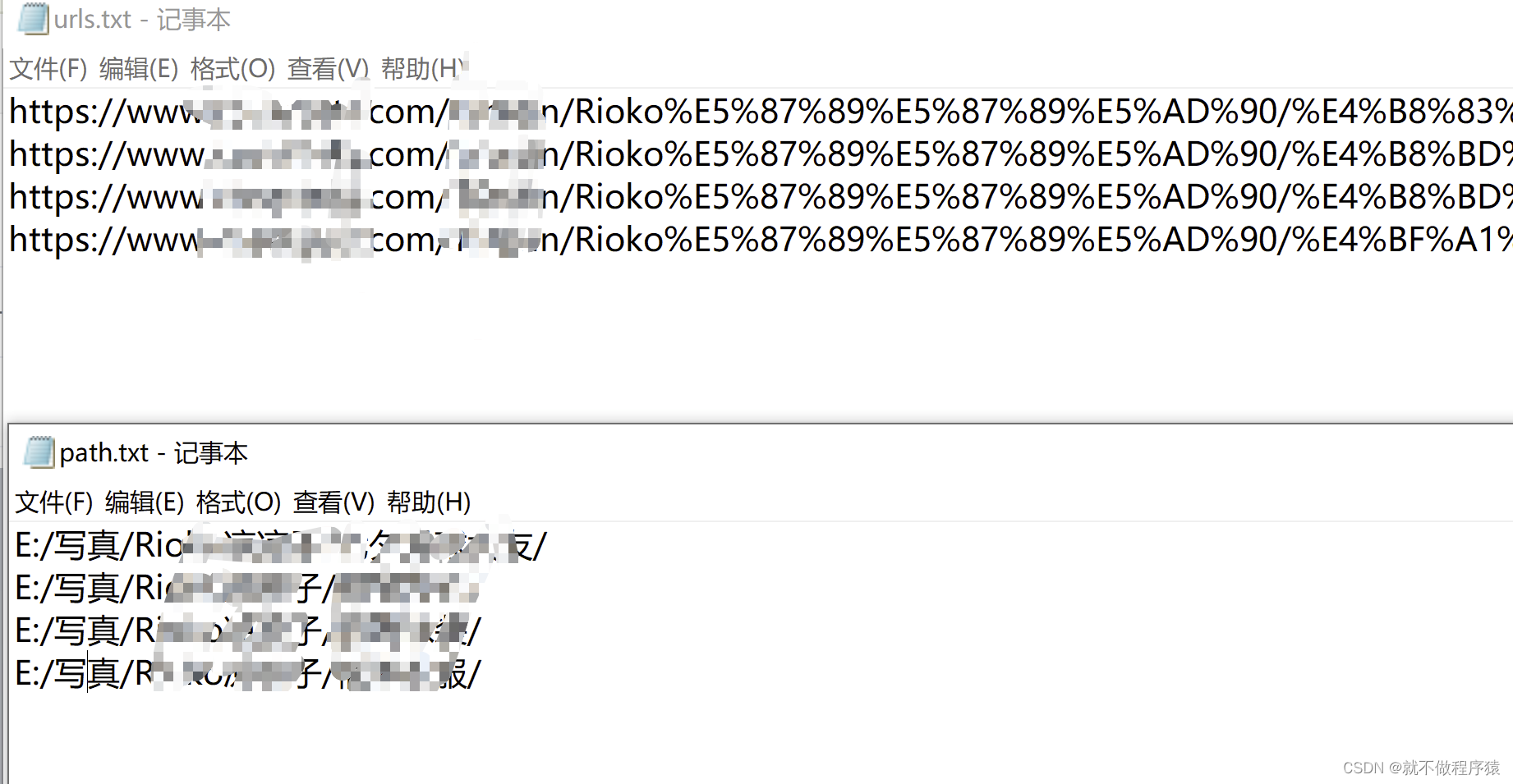

这次使用了selenium这个库,来进行等待JavaScript渲染,你可以一次下载多个网页,只需要把图片存放的路径和每个页面的url一一对应存放即可。如图所示

这是源码:

import requests

from bs4 import BeautifulSoup

import selenium

from selenium import webdriver

from selenium.webdriver.support import expected_conditions as EC

from selenium.webdriver.chrome.options import Options

from selenium.webdriver.support.ui import WebDriverWait

import time

import winsound

import os

from selenium.webdriver.common.by import By

#模拟浏览器

with open(‘E:/path.txt’, ‘r’, encoding=‘utf-8’) as path_file, open(‘E:/urls.txt’, ‘r’,encoding=‘utf-8’) as url_file:

paths = path_file.readlines()

urls = url_file.readlines()

if len(paths) != len(urls):

raise ValueError(‘URL和路径的数量不一致’)

for path, url in zip(paths, urls):

download_folder = path.strip()

url = url.strip()

print(download_folder)

options = webdriver.ChromeOptions()

options.add_argument(

“Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/123.0.6312.59 Safari/537.36”)

driver = webdriver.Chrome(options=options)

driver.get(url)

wait = WebDriverWait(driver, 30)

wait.until(EC.visibility_of_element_located((By.TAG_NAME, 'img')))

html = driver.page_source

img = driver.page_source

file_path = 'E:/111.txt'

with open(file_path, 'w', encoding='utf-8') as f: #覆盖写入

f.write(html)

print('网页HTML已保存到文件中')

# 设置代理和自定义请求头

proxies = {

'http': 'http://192.168.43.242:7890',

'https': 'http://192.168.43.242:7890',

}

headers = {

'User-Agent': "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/123.0.6312.59 Safari/537.36",

'Accept-Language': 'zh-CN,zh;q=0.8,zh-TW;q=0.7,zh-HK;q=0.5,en-US;q=0.3,en;q=0.2',

'Accept-Encoding': 'gzip, deflate, br',

'Upgrade-Insecure-Requests': '1',

'Sec-Fetch-Dest': 'document',

'Sec-Fetch-Mode': 'navigate',

'Sec-Fetch-Site': 'none',

'Sec-Fetch-User': '?1',

'Te': 'trailers',

'Connection': 'close',

}

# 定义文件下载路径

if os.path.exists(download_folder):

print("文件夹已经存在!")

else:

os.makedirs(download_folder) #自动创建文件夹

# 从文件中读取HTML内容

with open(file_path, 'r', encoding='utf-8') as file:

html_content = file.read()

# 使用 BeautifulSoup 解析HTML内容

soup = BeautifulSoup(html_content, 'html.parser')

# 查找所有的img标签并获取其src属性值

img_tags = soup.find_all('img')

image_links = [tag.get('src') for tag in img_tags]

# 定义用于存储访问结果的列表

access_results = []

# 遍历所有图片链接并尝试访问,如果失败,下载第二次

for link in image_links:

response = requests.get(link, headers=headers, proxies=proxies)

if response.status_code == 200:

access_results.append(f'Successfully accessed: {link}')

#下载图片

file_name = link.split('/')[-1]

# 拼接保存路径

save_path = download_folder + file_name

with open(save_path, 'wb') as f:

f.write(response.content)

print(f'Downloaded: {file_name}')

else:

access_results.append(f'Failed to access: {link}, Status code: {response.status_code}')

print("重新下载一遍!")

response = requests.get(link, headers=headers, proxies=proxies)

if response.status_code == 200:

access_results.append(f'Successfully accessed: {link}')

# 下载图片

file_name = link.split('/')[-1]

# 拼接保存路径

save_path = download_folder + file_name

with open(save_path, 'wb') as f:

f.write(response.content)

print(f'Downloaded: {file_name}')

else:

print(f"第二次下载{link}失败")

# 输出访问结果

for result in access_results:

print(result)

winsound.Beep(1000, 1000) # 参数分别为频率和持续时间(以毫秒为单位)

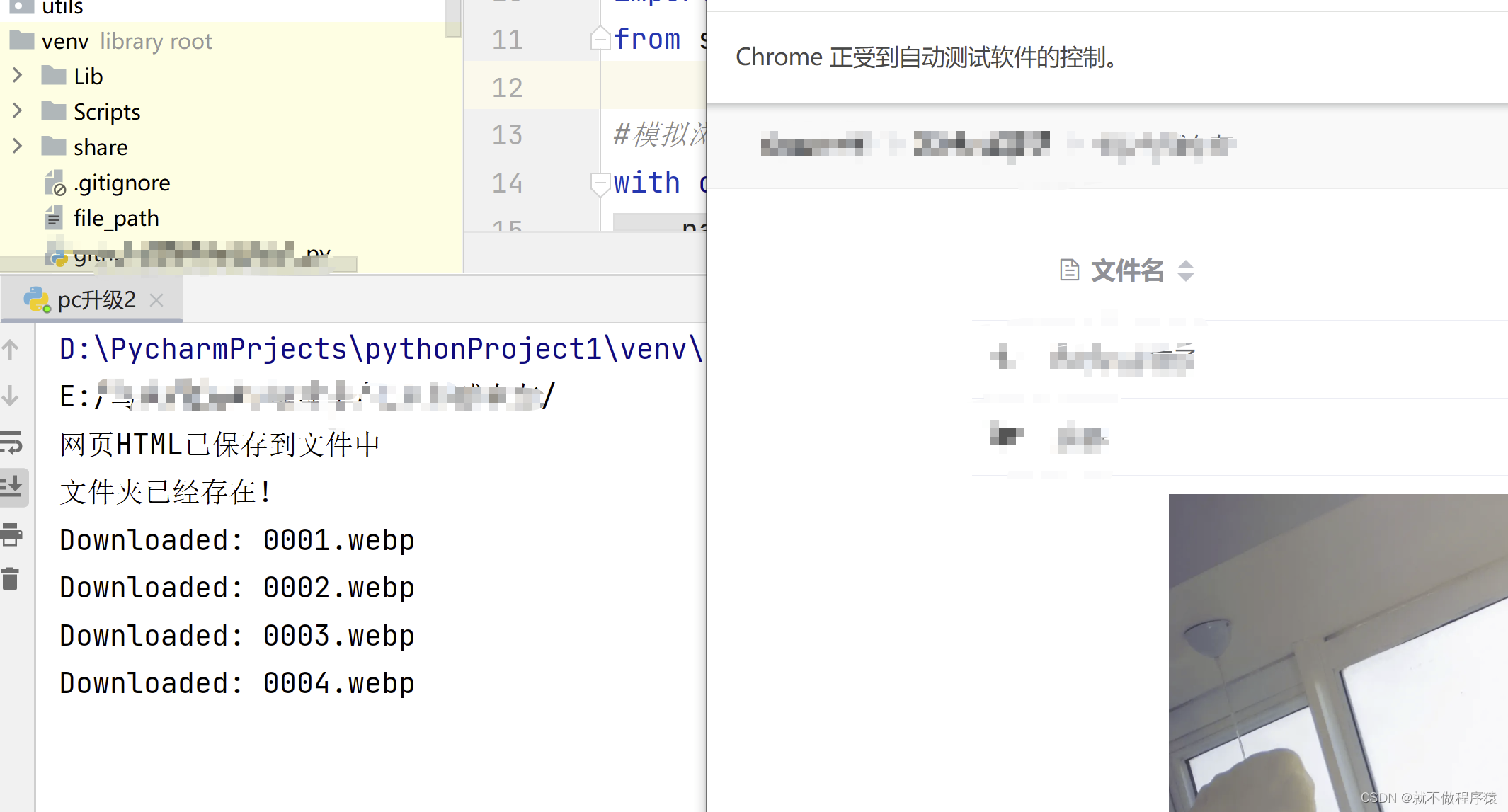

运行:

可以看到网站的图片被下载了,并且python开启的浏览器也渲染出了图片。

这样就可以爬取你想要的图片并且节省大量时间了。

### 最后

不知道你们用的什么环境,我一般都是用的Python3.6环境和pycharm解释器,没有软件,或者没有资料,没人解答问题,都可以免费领取(包括今天的代码),过几天我还会做个视频教程出来,有需要也可以领取~

给大家准备的学习资料包括但不限于:

Python 环境、pycharm编辑器/永久激活/翻译插件

python 零基础视频教程

Python 界面开发实战教程

Python 爬虫实战教程

Python 数据分析实战教程

python 游戏开发实战教程

Python 电子书100本

Python 学习路线规划

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

入研究,那么很难做到真正的技术提升。**

**需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)**

[外链图片转存中...(img-BzmzDjZZ-1713370910062)]

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

446

446

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?