参数整流线性激活函数(PReLU),全称Parametric ReLU,在解决ReLU激活函数会出现的dead relu神经元死亡的现象的同时,引入一个新的可学习的参数对激活函数进行控制。

函数表达式

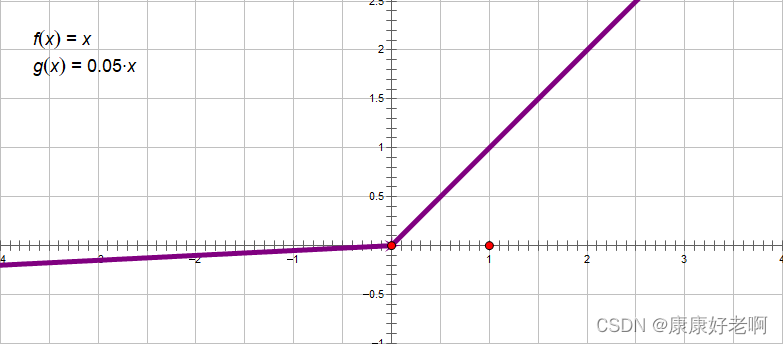

f ( x ) = m a x { α x , x } , 其中 α < < 1 f(x)=max\{\alpha x,x\},其中\alpha<<1 f(x)=max{αx,x},其中α<<1

当 x < 0 x<0 x<0时,函数值为 f ( x ) = α x f(x)=\alpha x f(x)=αx,比如像 f ( x ) = 0.001 x f(x)=0.001x f(x)=0.001x,但是 α \alpha α不是固定的,也是一个需要通过梯度下降去学习的参数;当 x > 0 x>0 x>0时,函数值为 f ( x ) = x f(x)=x f(x)=x

函数图像

函数特性

优点:

- 可以在一定程度上解决ReLU出现的dead ReLU问题,虽然斜率 α \alpha α的值很小,但是依然存在梯度可以更新

- α \alpha α需要通过学习来确定,更加适应不同的神经网络

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?