本次我们项目采用阿里云服务器,采用以下技术及框架协议,进行数据分析:

- HDFS

- Hive

- Spark SQL

- Zeppelin

当然我们也可以利用数据库清洗好的数据,采用

1.Tableau

2.Python+echarts+web前端

3.腾讯云、阿里云BI报表

4.当然我们也可以采用Excel的数据透视表、数据透视图来制作

一、云服务器中虚拟机的配置

1.Hadoop的配置

参考以下博客,将阿里云服务器centos7.2下搭建hadoop伪分布式环境进行配置。

一定要注意:java的配置环境!!!

防止hadoop找不到java!

2.数据库MySQL的配置

参考以下博客

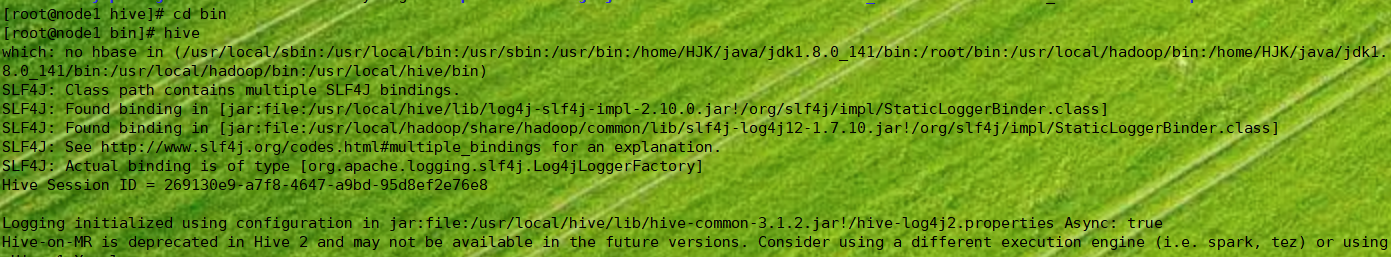

3.安装hive的配置

在local的目录下

wget https://mirrors.aliyun.com/apache/hive/hive-3.1.2/apache-hive-3.1.2-bin.tar.gz将 tar 包解压缩到 /usr/local/ 目录下,并重命名为 hive:

tar -zxvf apache-hive-x.y.z-bin.tar.gz

mv apache-hive-x.y.z-bin hive

配置环境变量

在 ~/.bashrc 或者 /etc/bashrc 中添加以下内容:

export HADOOP_HOME=/usr/local/hadoop

export HIVE_HOME=/usr/local/hive

export PATH=$PATH:$HADOOP_HOME/bin:$HIVE_HOME/bin

使修改立即生效:

source ~/.bashrc

至此,Hive 的安装和配置完成了。

配置环境变量:可以在 /etc/profile 文件中添加以下环境变量:

export HADOOP_HOME=/usr/local/hadoop

export HIVE_HOME=/usr/local/hive

export PATH=$PATH:$HADOOP_HOME/bin:$HIVE_HOME/bin

-

source /etc/profile然后初始化元数据库

-

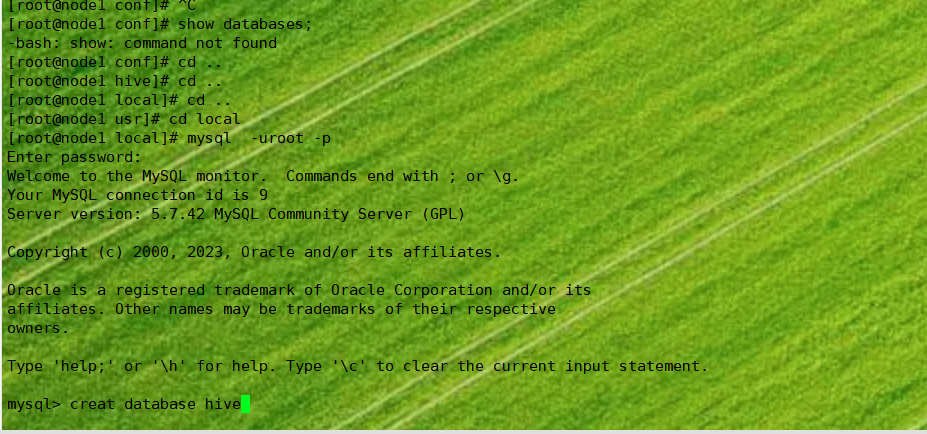

配置 Hive 元数据库:Hive 使用一个元数据库来存储元数据信息。可以使用如下命令创建 MySQL 数据库,并授权 Hive 用户使用该数据库:

-

mysql -u root -p create database metastore; grant all privileges on metastore.* to 'hive'@'localhost' identified by 'your_password';然后,需要将 Hive 配置文件

hive-site.xml中的javax.jdo.option.ConnectionURL、javax.jdo.option.ConnectionUserName和javax.jdo.option.ConnectionPassword等属性设置为 MySQL 连接信息。 -

启动 Hive:可以使用以下命令启动 Hive:

hive

如果一切顺利,你应该能够看到 Hive 的命令行界面,并可以执行 Hive SQL 命令了。

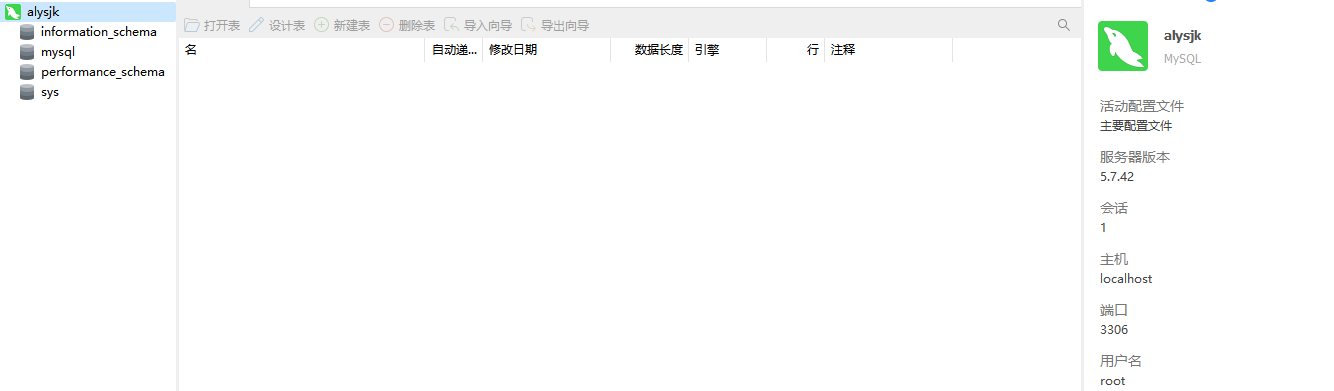

4.hive连接数据库

7416

7416

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?