题目:Camouflaged Object Detectionwith Feature Grafting and Distractor AwareINTRODUCTION

代码链接:https://github.com/syxvision/FDNet

Abstract

伪装目标检测(COD)的任务是准确地分割融入环境中的伪装目标,由于目标与背景之间的纹理在视觉上难以区分,这比普通检测更具挑战性。本文首次提出了一种新的基于特征嫁接和干扰感知的网络(FDNet)来处理COD任务。具体地说,我们使用CNN和Transformer来并行编码多尺度图像。为了更好地发挥这两种编码器的优势,设计了一个基于交叉注意力的特征移植模块,将从Transformer分支提取的特征移植到CNN分支中,然后在特征融合模块中进行特征聚合。干扰物感知模块被设计用于明确地建模COD任务中的两个可能的干扰物,以改进粗糙伪装图。我们还提出了最大的人工伪装对象数据集ACOD2K,它包含2000幅带有注释的图像。我们在四个广泛使用的基准数据集和ACOD2K数据集上进行了广泛的实验。实验结果表明,本文的方法所得到的结果要好于其他方法.该代码和ACOD2K将在https://github.com/syxvision/FDNet上提供。

INTRODUCTION

使用Transformer和CNN来利用不同尺度上的信息,其中Transformer为丰富的上下文信息建模长期依赖性,CNN挖掘边缘信息的局部细节。

基于交叉注意的特征嫁接模块,它以自底向上的方式融合特征以产生粗略的预测图 。

干扰感知模块,通过对两种类型的干扰进行建模,并在地面实况的监督下探索潜在的伪装区域来指导学习。

为COD社区贡献了一个新的COD数据集,从互联网上收集并标注了2000张人工伪装图像,构成了目前最大的人工伪装数据集,命名为ACOD2K

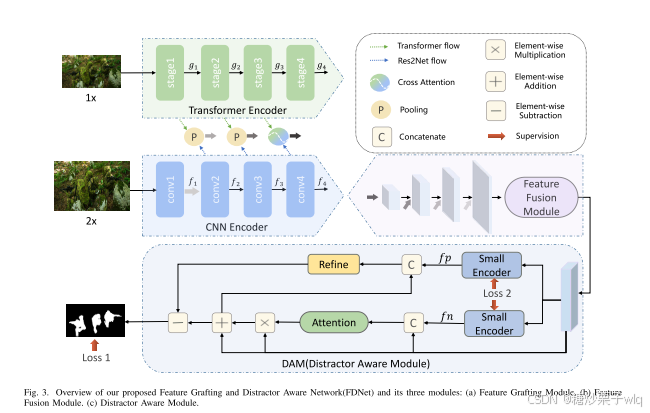

Overall Architecture

设计了一个基于交叉注意的特征嫁接模块,对这两个尺度的特征进行聚合,既提取有价值的语义线索,又充分抑制了冗余信息和背景噪声。然后将多尺度特征送入特征融合模块进行解码,通过自下而上的密集连接实现编码信息的更高效传输。最后,将其发送到双分支干扰感知模块中以细化特征图,并使用地面实况进行监督。

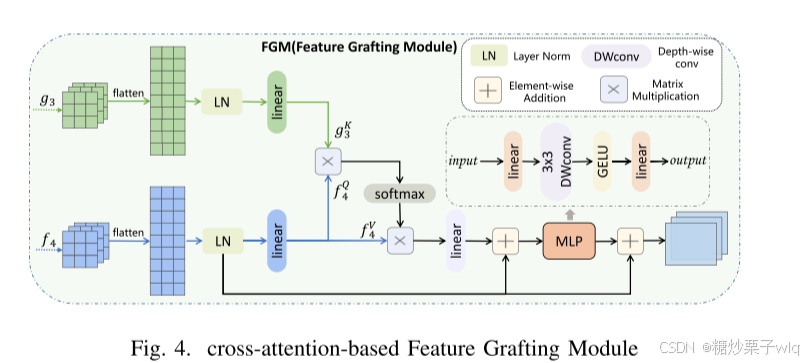

Feature Grafting Module

选择在具有相同特征分辨率的特征组上移植特征。由于子标度的分辨率是主标度的两倍,因此gi,fi+1; i = 1,2,3的分辨率相同。对于前两个组,使用池进行特征嫁接来维护和突出显示有用的信息。在神经网络中,更深层次的特征具有更丰富的语义线索。对于使用具有丰富全局上下文信息的Transformer提取的g3。对于使用CNN提取的f4,其具有与全局信息互补的边缘细节信息。我们认为,使用简单的融合方法,如合并、级联或相加,对于这两个特征之间的相互学习不够有效,并且不能很好地抑制来自CNN的背景噪声。因此,我们使用交叉注意力将从主尺度学习到的全局语义线索纳入子尺度的每个像素中。

cross-attention-based Feature Grafting Module

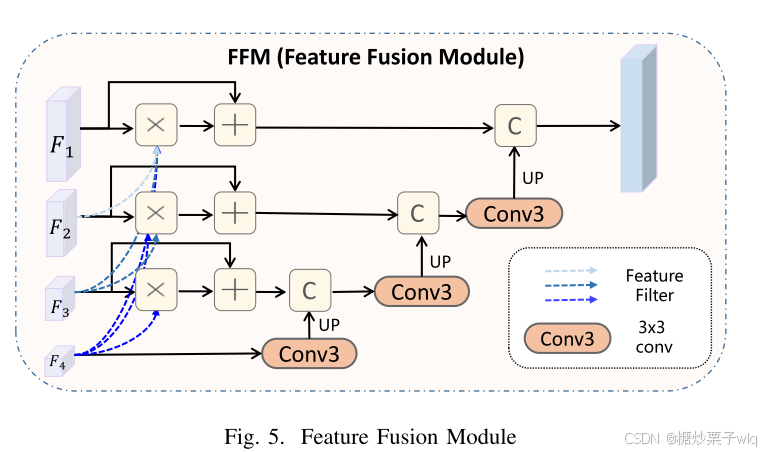

Feature Fusion Module

首先将其与当前层特征元素相乘,以抑制可能导致异常的背景干扰,然后通过残差相加来保留原始信息。

Distractor Aware Module

第一阶段生成的粗略预测图中存在两种类型的干扰项,(i)被隐藏但未被检测到的对象,称为假阴性;(ii)未被隐藏但被误检测的对象,称为假阳性。为了解决这个问题,我们提出了一个双分支干扰感知模块,明确建模的潜在干扰,旨在提高分割结果的准确性。

Datasets

ACOD2K、公开数据集CAMO 、CHAMELON 、COD10K和NC4K。使用来自COD10K的3040幅图像和来自CAMO的1000幅图像进行训练,并使用其他数据集进行测试。对于ACOD2K,我们将其按8 ∶ 2的比例分为训练集与测试集。

CONCLUSION

1、提出了一种新的COD网络FDNet;

2、设计了特征移植模块来提取有价值的语义信息并抑制背景噪音;

3、在干扰感知模块中,我们通过细化这两种类型的干扰,得到更准确的预测地图;

4、构建了一个新的人工伪装数据集ACOD2K

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?