服务器部署2

拉取LLama-Factory

#克隆项目

git clone https://github.com/hiyouga/LLaMA-Factory.git

# 安装项目依赖

cd LLaMA-Factory

pip install -r requirements.txt

pip install transformers stream generator bitsandbytes tiktoken auto-gptg optimum

pip install --upgrade tensorflow

pip uninstall flash-attn -y

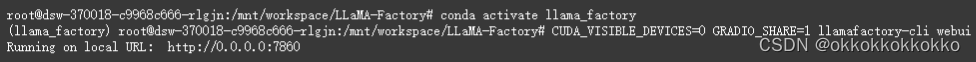

# 运行

CUDA_VISIBLE_DEVICES=0 GRADIO_SHARE=1 llamafactory-cli webui

运行成功:

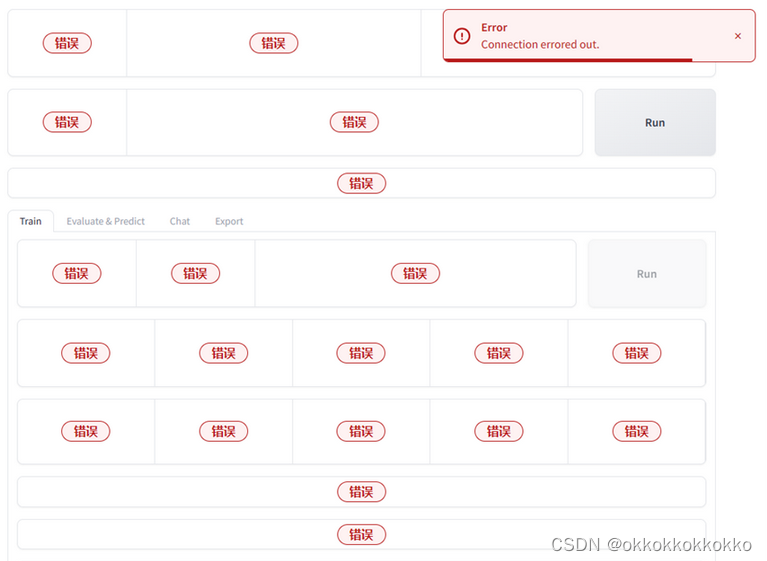

但是启动后发现全是ERROR

但是启动后发现全是ERROR

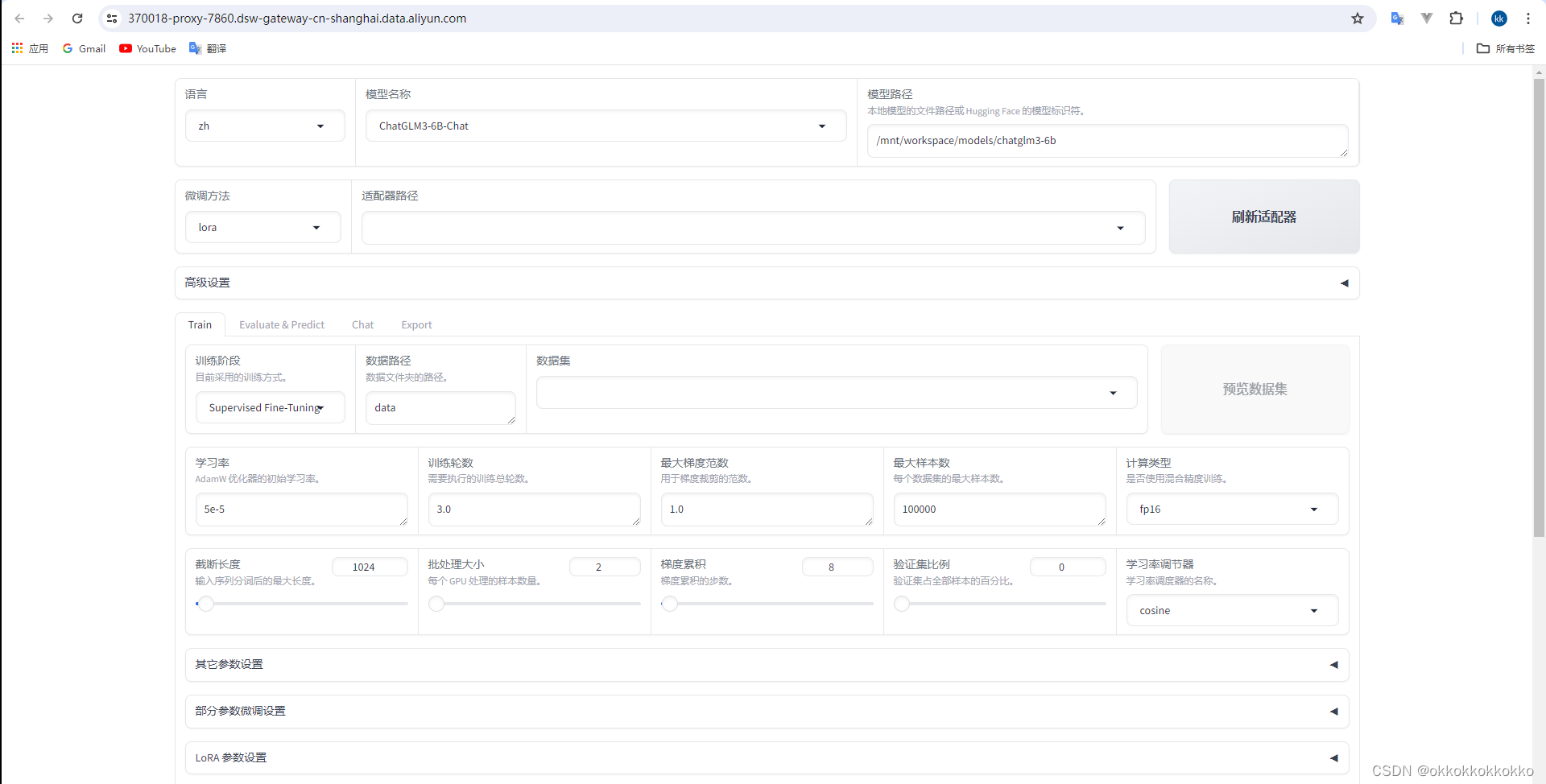

经查询发现是阿里云服务器在该平台上需多加几行命令:

经查询发现是阿里云服务器在该平台上需多加几行命令:

pip install -e .【torch,metrics】

pip install --no-deps -e .

export GRADIO_SERVER_PORT=7860 GRADIO_ROOT_PATH=/${JUPYTER_NAME}/proxy/7860/

再次启动后,启动成功

完成部署,可以准备微调

完成部署,可以准备微调

914

914

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?