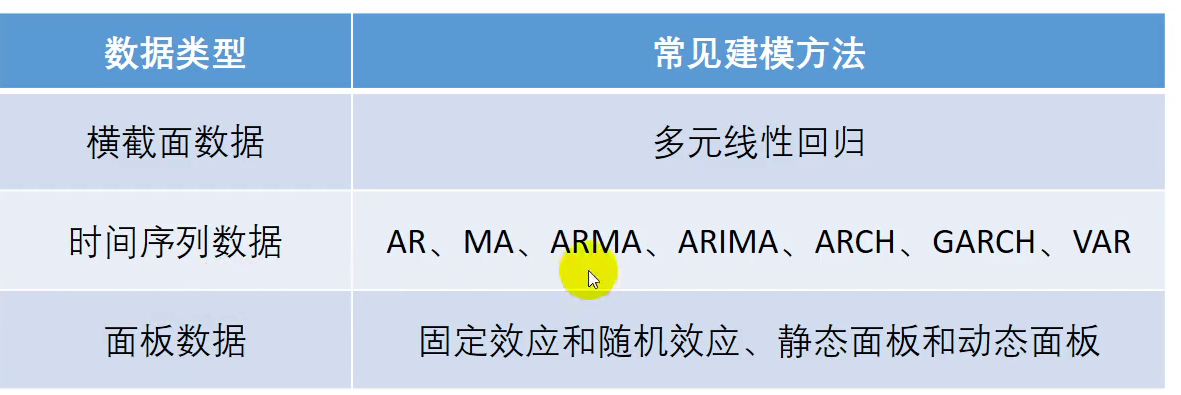

一.数据的分类

(1)横截面数据:某一时点上收集的不同的数据

(2)时间序列数据:对同一对象在不同时连续观察所得到的数据

(3)面板数据:横截面数据与时间序列数据综合起来的一种数据

二.多元线性回归

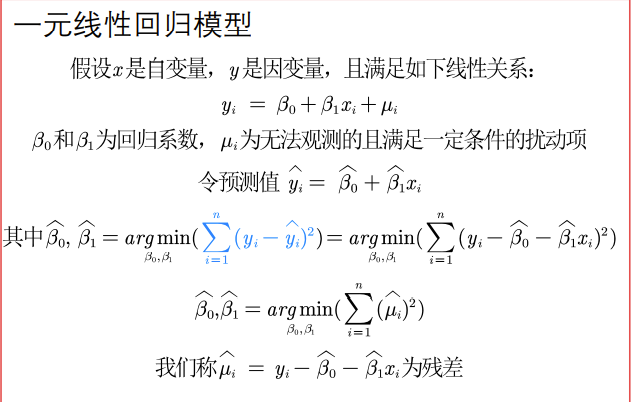

1.一元线性回归

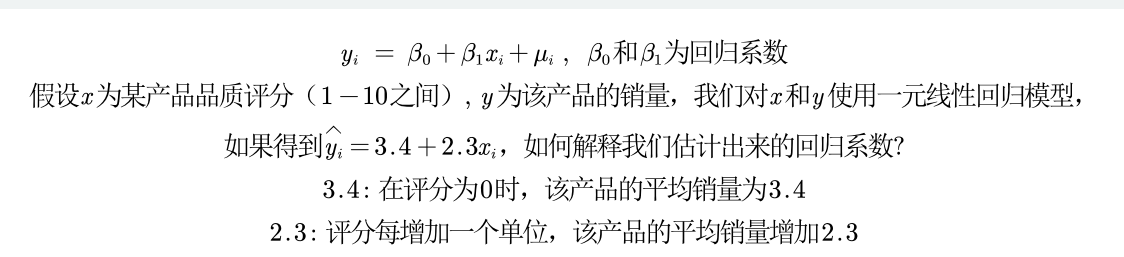

2.回归系数的解释

遗漏变量会导致内生性

3.内生性

扰动项和所有的自变量x均不相关,则称该回归模型具有外生性(如果相关则具有内生性,内生性会导致回归系数估计不准确)

误差项:包含了所有与y相关但是没有添加到回归模型的变量,如果这些变量和我们已添加的自变量相关,则存在内生性。

4.核心解释变量和控制变量

无内生性假设太强可以弱化此假设。将解释变量分为核心解释变量和控制变量。

核心解释变量:我们最感兴趣的变量与扰动项不相关即可。

控制变量:我们对这些变量不感兴趣,但这些变量对核心解释变量有影响的变量。

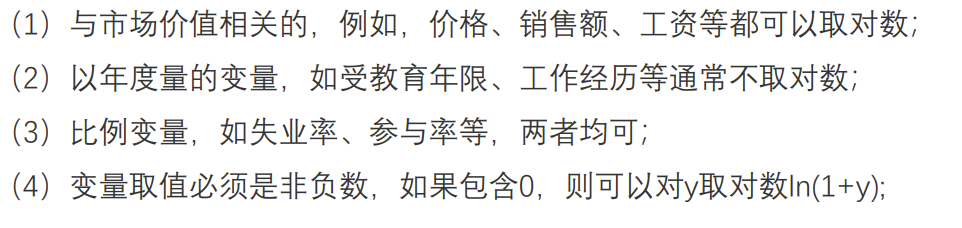

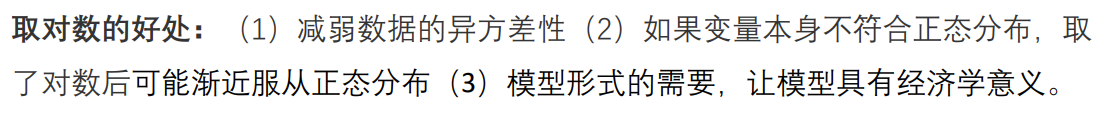

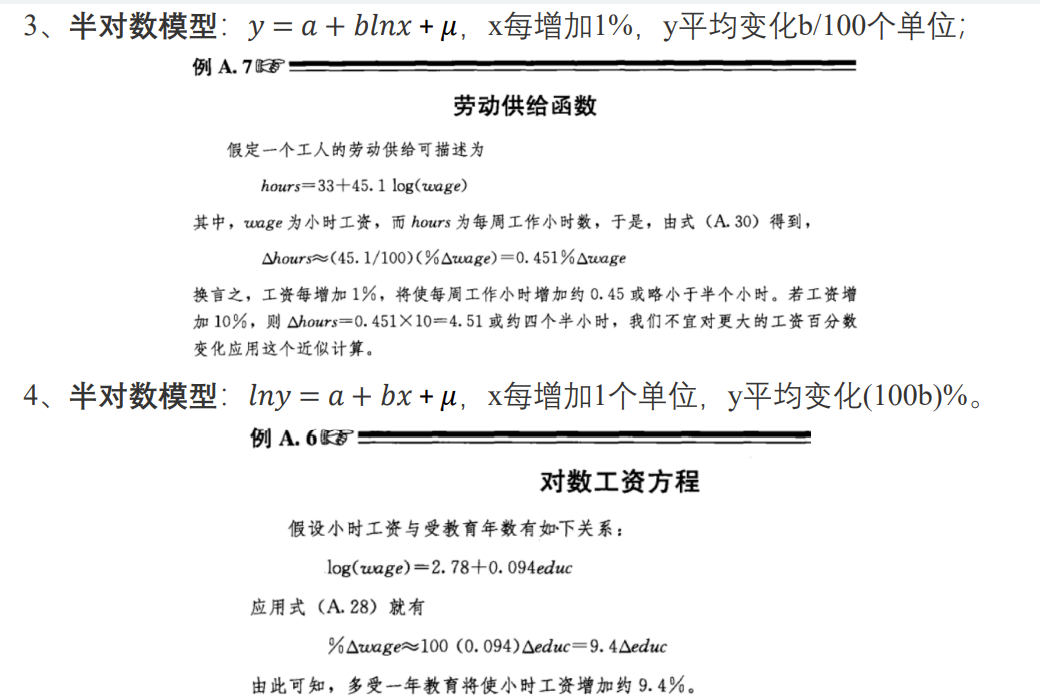

5.什么时候取对数

取对数意味着原被解释变量对解释变量的弹性,即百分比的变化而不是数值的变化。

取对数条件:

取对数好处:

三.Stata操作

(1)数据描述性统计

定量变量:summarize

定性数据:tabulate 变量名,gen(A) 生成对应的虚拟变量

四.异方差

1.概念

异方差:就是方差会发生变化

同方差:方差稳定不发生变化

2.检验异方差

(1)画图检验

STATA命令:

// 作评价量的概率密度估计图

kdensity 评价量

(2)假设检验

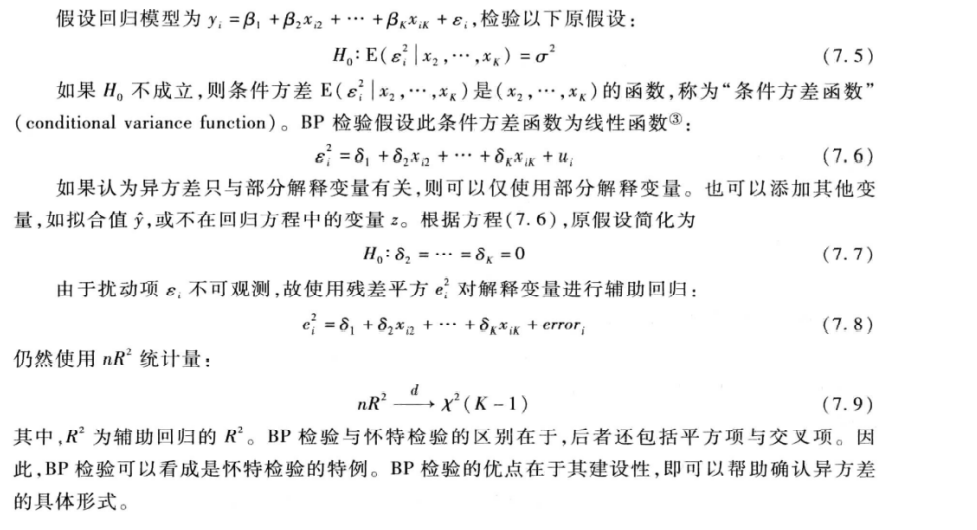

1.BP检验

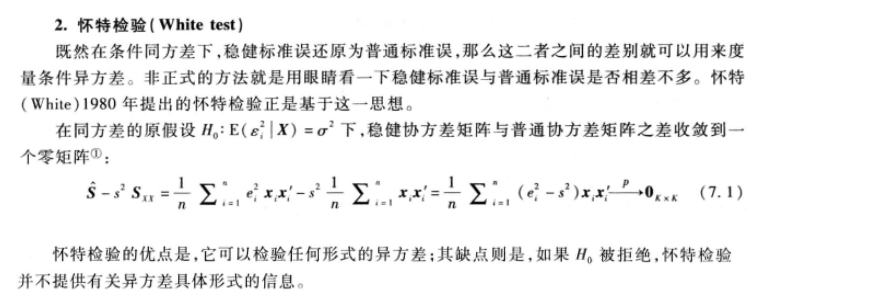

2.怀特检验

原假设:不存在异方差

p值小于0.05,说明在95%置信区间下拒绝原假设,即存在异方差

// 异方差BP检验

estat hettest ,rhs iid

// 异方差怀特检验

estat imtest,white

3.解决方法

(1)使用OLS+稳健的标准误

(2)广义最小二乘GLS

原理:方差较小的数据包含的信息更多,我们可以给予信息量大的数据更大的权重(即方差较小的数据给予更大的权重)

regress 评价量,r

五.多重共线性

1.判别

多重共线性是指一个变量和其他变量相关

(1)发现系数估计值的符号不对;

(2)某些重要的解释变量t值低,而R方不低

(3)当一不太重要的解释变量被删除后,回归结果显著变化;

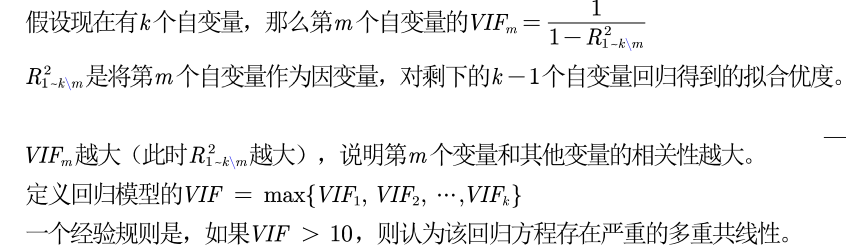

2.检验

方差膨胀因子

//回归结束后使用

// 计算VIF

estat vif

六.逐步回归分析

// 逐步回归(不能有完全多重共线性的影响)

// 向前逐步回归(后面的r表示稳健的标准误)

stepwise reg 评价量, r pe(0.05)

// 向后逐步回归(后面的r表示稳健的标准误)

stepwise reg 评价量, r pr(0.05)

// 向后逐步回归的同时使用标准化回归系数(在r后面跟上一个b即可)

stepwise reg 评价量 , r b pr(0.05)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?