前面介绍的支持向量机都是在数据线性可分条件下的,但是当我们拿到训练数据时,并不一定能知道数据是否线性可分。

若是低维数据我们可以通过可视化的方式观察是否线性可分,而高维数据则很难判断其是否线性可分了。

例如下边的图中的红点和蓝点无法用一条直线分隔开,就属于典型的线形不可分问题。

对线性不可分数据强行构建线性支持向量机分类可能会导致很差的分类效果,接下来我们就介绍一下如何在数据线性不可分条件下构建非线性支持向量机。

核技巧

把数据从低维空间映射到一个更高维的特征空间,可以将数据集变成线性分类问题,从而也就可以用线性支持向量机来解决,我们把这种方法称作核技巧。

核技巧应用到支持向量机,其基本想法就是通过一个非线性变换将输入空间(欧氏空间Rn或离散集合)对应于一个特征空间(希尔伯特空间H),使得在输入空间Rn中的超曲面模型对应于特征空间H中的超平面模型(支持向量机)。

核技巧的想法是,在学习与预测中只定义核函数K(x,z),而不显式地定义映射函数。对于给定的核K(x,z),特征空间x和映射函数的取法并不唯一,可以取不同的特征空间,即便是在同一特征空间里也可以取不同的映射。

核函数在支持向量机中的应用

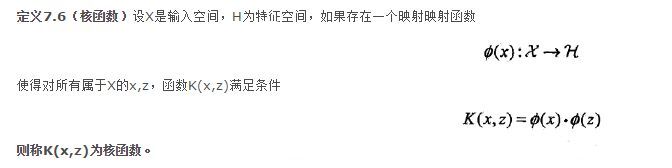

下边我们来介绍一下正定核:

通常来说,我们一般提到的核函数就是指正定核。

简单介绍一下常用的其他几类核函数:

1266

1266

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?