问题:

习题2-1

问题一:为什么平方损失函数不适用于分类问题?

(1)回顾定义

平方损失函数(quadratic loss function)是一种常用的损失函数,它在机器学习和统计中经常被用来度量预测结果与真实结果之间的差距。

平方损失函数定义为:

,其中y是真实值,f(x)是模型预测值。

平方损失函数的特点是:

对称性:平方损失函数对于预测值高于或低于真实值的错误给予相同的惩罚。

局部性:平方损失函数只在预测值与真实值相差较大的地方给予较大的惩罚,而在预测值与真实值相差较小的。

(2)回答问题

平方损失函数不适用于分类问题,主要原因是它不能很好地处理分类问题中标签离散的情况。在分类问题中,标签是离散的,每个标签之间的距离没有实际意义。预测值和标签两个向量之间的平方差这个值不能反应分类这个问题的优化程度。比如分类1、2、3,真实分类是1,而被分类到2和3错误程度应该是一样的,但是明显当我们预测到2的时候是损失函数的值为1/2而预测到3的时候损失函数为2,这里再相同的结果下却给出了不同的值,这对我们优化参数产生了误导。

(简单来说:因为平方损失函数对每个类别的错误率进行单独计算,而不是对类别之间的错误率进行计算。对于分类问题,我们希望最小化不同类别之间的错误率,而不是最小化每个类别的错误率。平方损失函数只关注预测值与真实值之间的差异,而忽略了类别之间的差异。)

问题二:交叉熵损失函数不适用于回归问题?

(1)回顾定义

交叉熵损失函数(Cross Entropy Loss)是在处理分类问题中常用的一种损失函数。它主要应用于多分类和二分类问题,并且它的主要作用是衡量一个样本的真实标签和预测概率之间的差异。

交叉熵损失函数的具体公式为:L = -[y log(y^)],其中y是真实标签,y^是预测概率。

交叉熵损失函数的主要优势在于,它可以很好地处理分类问题中的离散标签。对于连续标签的预测问题,如回归问题,使用均方误差(Mean Squared Error,MSE)等损失函数更为合适。

(2)回答问题

交叉熵损失函数不适用于回归问题,主要原因是回归问题中的目标是找到一个模型来预测连续变量的值,而不是对离散类别进行分类。

交叉熵损失函数主要用于分类问题,它关注的是如何最小化模型预测的类别与真实类别之间的差异。在回归问题中,我们通常关注的是预测结果与真实结果之间的差距,而不是预测结果的类别。

因此,交叉熵损失函数不适用于回归问题。

对于回归问题,通常使用均方误差(Mean Squared Error,MSE)等损失函数来度量预测结果与真实结果之间的差距,从而进行模型优化。

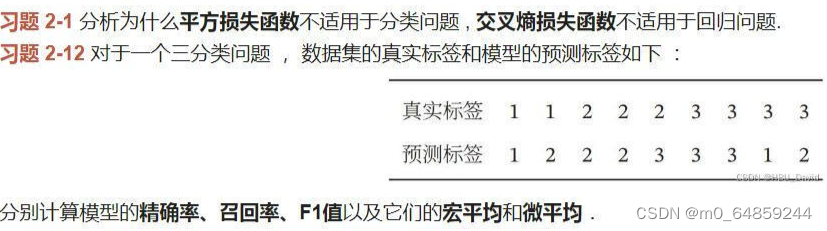

习题2-12

1、知识回顾

(1)精确率

精确率(Precision)是指在模型预测结果中,预测正确的正样本数占总预测为正样本数的比例。在分类问题中,我们通常将样本分为正负两类,其中正类是需要被模型预测的类别,而负类则是不需要被预测的类别。

精确率的计算公式:

精确率的取值范围为0到1之间,值越高表示模型预测正确的正样本数占比越高,模型的效果越好。

(2)召回率

召回率(Recall)是一种衡量分类模型性能的指标,它表示实际为正例的样本中,被模型预测为正例的样本数量所占的比例,也可以理解为模型能够正确找出实际正例的能力。召回率通常用于二分类问题的评估,也可以在多分类问题中计算每个类别的召回率。

召回率的计算公式:

需要注意的是,召回率不考虑模型预测为负例而实际为负例的情况,因此召回率无法反映出负例样本的分类情况。在实际问题中,需要综合考虑多种指标来评估模型性能。

(3)F值

F值是F检验的统计量,用于检验所有自变量对因变量的联合作用是否显著。在分类问题中,F值定义为精确率和召回率的调和平均值,通常称为F1值。

F值的计算公式:

将精确率和召回率相加,然后用2除以这个和值,得到的结果即为F1值。F1值越大,表明模型在精确率和召回率方面的表现越好,分类效果也越好。

除了F值外,还有其他指标可以用于评估分类模型的性能,如准确率、精确率、召回率和AUC值等。这些指标各有特点,需要根据具体情况选择合适的指标来评估模型的性能。

(4)宏平均

宏平均(Macro-average)是一种在多类别分类问题中常用的平均方法,它对每个类别单独计算性能指标(如准确率、召回率和F1分数),然后对所有类别的指标取平均。每个类别被视为同等重要,不考虑类别的样本数量。

宏平均计算公式:

(5)微平均

微平均(Micro-average)是在多类别分类问题中另一种常用的平均方法。与宏平均不同,微平均在计算性能指标时考虑了每个类别的样本数量,对所有类别的贡献进行平等对待。

微平均计算公式:

在存在数据不均衡问题的情况下,使用微平均得到的结果通常更加可信。

2、回答问题

(1)精确率

(2)召回率

(3)F1值

(4)宏平均

(5)微平均

1032

1032

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?