1、消费者消费消息

1.1、屏蔽 kafka debug 日志

<configuration>

<!-- 如果觉得idea控制台日志太多,src\main\resources目录下新建logback.xml,屏蔽kafka debug -->

<logger name="org.apache.kafka.clients" level="debug" />

</configuration>

1.2、消费者消费消息

package com.atguigu.kafka.consumer;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import java.time.Duration;

import java.util.Arrays;

import java.util.Properties;

public class KafkaConsumer1 {

/**

* 主函数入口,创建并运行一个Kafka消费者来消费主题"foo"和"bar"的消息。

*

* @param args 命令行参数(未使用)

*/

public static void main(String[] args) {

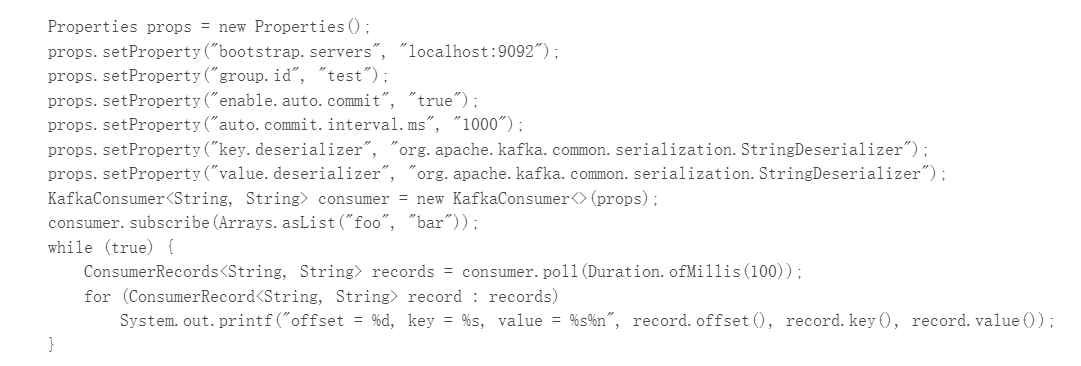

// 初始化Kafka消费者配置

Properties props = new Properties();

props.setProperty("bootstrap.servers", "192.168.74.148:9092"); // Kafka broker的地址和端口

props.setProperty("group.id", "my_group2"); // 消费者组ID

props.setProperty("enable.auto.commit", "true"); // 自动提交偏移量

props.setProperty("auto.commit.interval.ms", "1000"); // 自动提交偏移量的时间间隔

props.setProperty("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer"); // 键的反序列化器

props.setProperty("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer"); // 值的反序列化器

props.setProperty(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, "earliest");

// 使用配置创建KafkaConsumer实例

KafkaConsumer<String, String> consumer = new KafkaConsumer<>(props);

// 订阅要消费的主题

consumer.subscribe(Arrays.asList("my_topic3"));

// 持续消费消息

while (true) {

// 从Kafka服务器拉取一批消息

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

// 遍历并处理收到的消息记录

for (ConsumerRecord<String, String> record : records)

System.out.printf("offset = %d, key = %s, value = %s%n", record.offset(), record.key(), record.value());

}

}

}

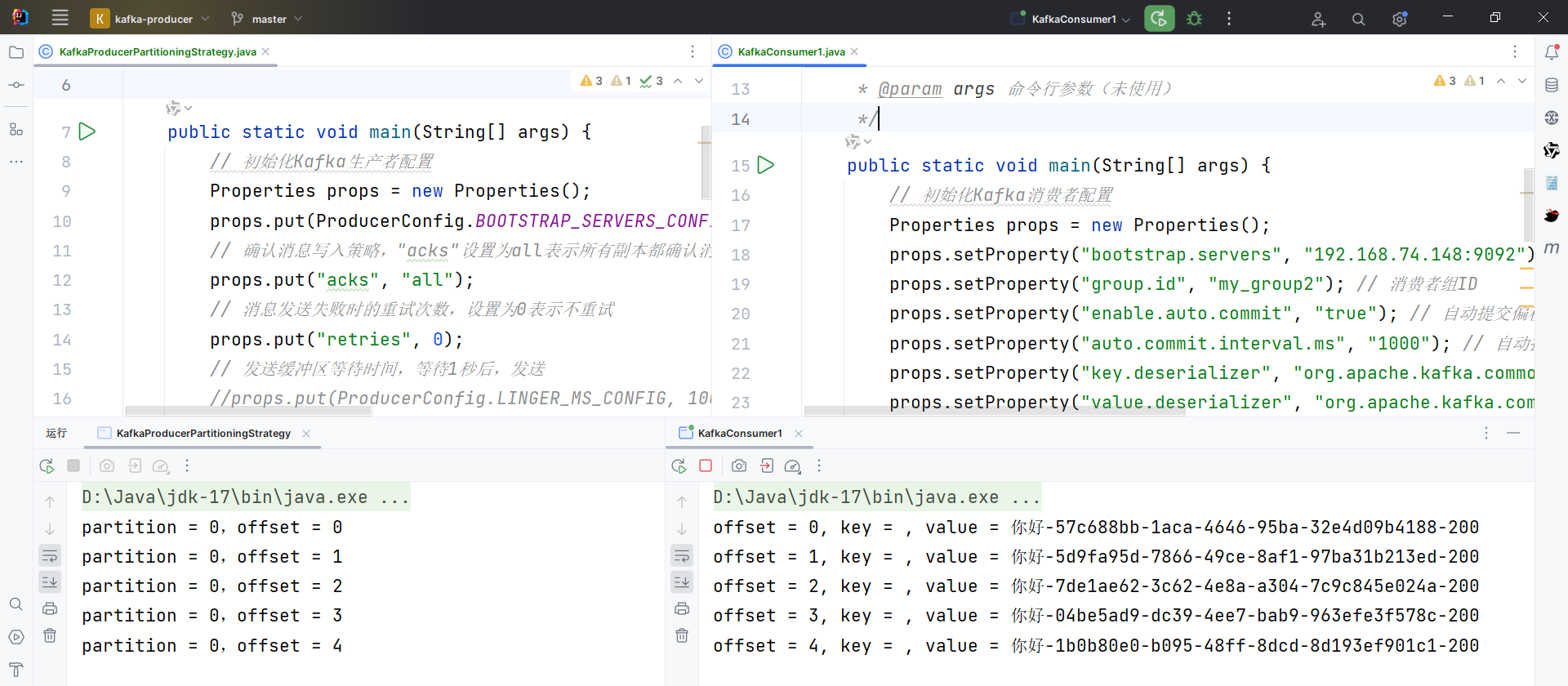

1.3、生产者发送消息

package com.atguigu.kafka.producer;

import org.apache.kafka.clients.producer.*;

import java.util.Properties;

import java.util.UUID;

public class KafkaProducerPartitioningStrategy {

public static void main(String[] args) {

// 初始化Kafka生产者配置

Properties props = new Properties();

props.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "192.168.74.148:9092"); // 指定Kafka broker的地址和端口

// 确认消息写入策略,"acks"设置为all表示所有副本都确认消息接收后才会响应

props.put("acks", "all");

// 消息发送失败时的重试次数,设置为0表示不重试

props.put("retries", 0);

// 发送缓冲区等待时间,等待1秒后,发送

//props.put(ProducerConfig.LINGER_MS_CONFIG, 1000);

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer"); // 指定键的序列化器

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer"); // 指定值的序列化器

// 分区器选择RoundRobinPartitioner,实现消息在主题分区间的轮询分配

//props.put(ProducerConfig.PARTITIONER_CLASS_CONFIG, "org.apache.kafka.clients.producer.RoundRobinPartitioner" );

//配置自定义分区策略

//props.put(ProducerConfig.PARTITIONER_CLASS_CONFIG, "com.atguigu.kafka.producer.MyPartitioner");

// 创建Kafka生产者实例

Producer<String, String> producer = new KafkaProducer<>(props);

for (int i = 0; i < 5; i++) {

producer.send(new ProducerRecord<String, String>("my_topic3",

"",

"你好-" + UUID.randomUUID().toString()+"-"+200), new Callback() {

@Override

public void onCompletion(RecordMetadata recordMetadata, Exception e) {

if (e == null) {

System.out.println("partition = " + recordMetadata.partition()

+",offset = " + recordMetadata.offset());

}

}

});

}

producer.close();

}

}

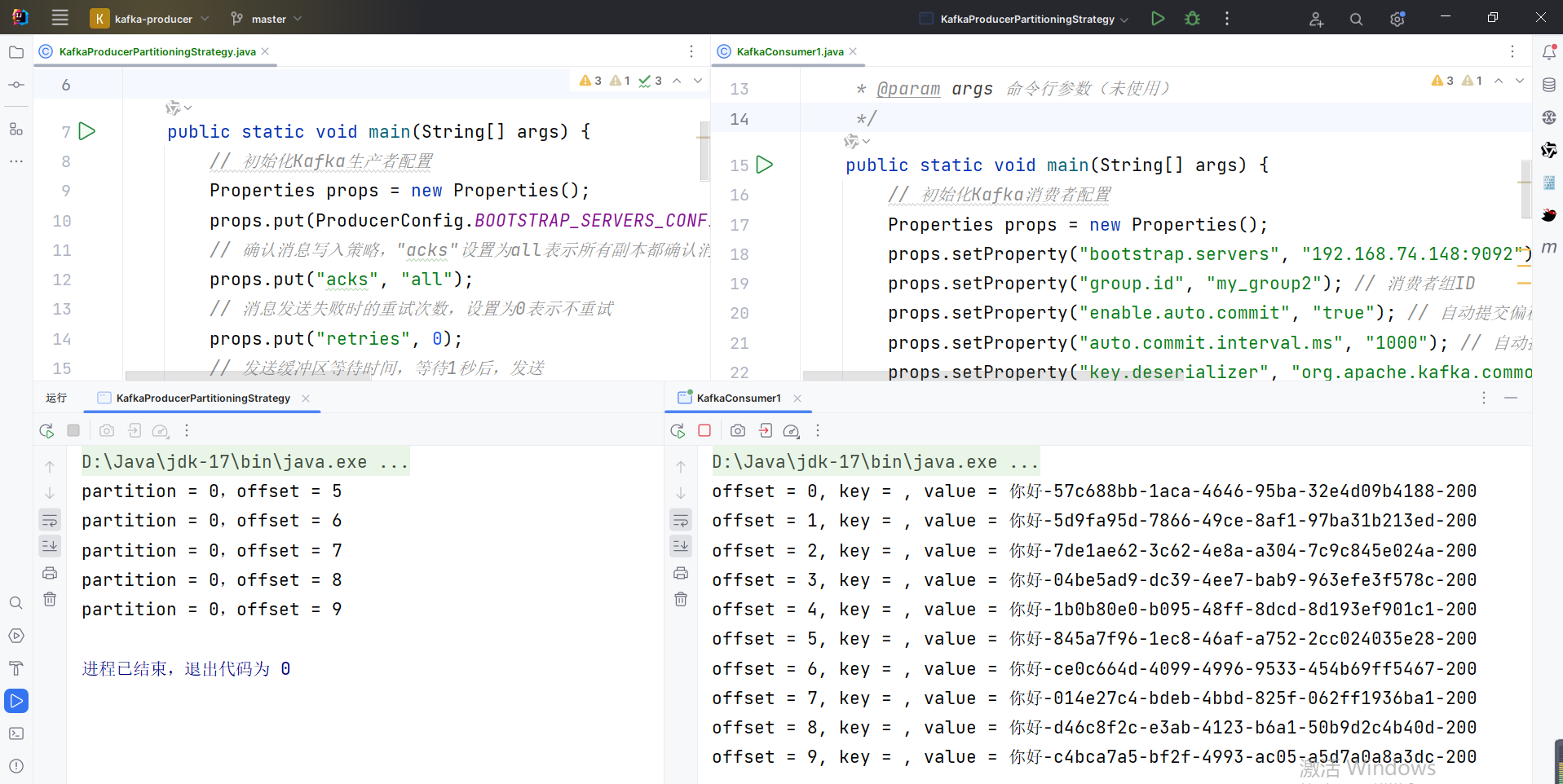

1.3.1、第一次发送消息

1.3.2、第二次发送消息

两次发送消息都在同一个分区,所以消费者消费消息的offset是接着第一次发送offset=4开始

1126

1126

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?