一、简述:

整合Whisper, YOLOv5和ChatGLM可以创建一个强大的多功能系统,针对特定应用如工地安全管理进行优化。这里是如何将这三种技术连接起来的概述:

1. Whisper用于语音识别:捕捉现场的指令和对话,实时转换为文本数据,便于进一步处理。

2. YOLOv5用于图像识别:用于实时监控视频流,检测和识别工地上是否有工人未佩戴安全帽,以及其他潜在安全风险。

3. ChatGLM用于数据分析和自动响应:利用转换的文本和图像识别结果,ChatGLM可以分析数据,提供安全建议,自动生成安全报告,或者在检测到安全隐患时触发警报。

将这三种技术整合到一起,可以实现一个自动化的、高效的安全监控系统,不仅可以提升安全性,还能通过预防事故来降低成本。这种系统的实施将大大提高工地的管理效率和安全标准。

二、如何整合三者?

GLM根据语音识别传出的文字对任务进行分解,然后弄成参数传递到后续的行动库,如果任务分解中识别到一个任务是识别安全帽,打开摄像头,即可调用安全帽识别项目。现在面临的问题是:如何整合三者?

要整合Whisper, YOLOv5和ChatGLM,可以采用以下步骤和脚本:

1. 语音识别(Whisper)

首先,使用Whisper处理语音输入并提取文本:

import whisper

def transcribe_audio(audio_path):

model = whisper.load_model("base")

result = model.transcribe(audio_path)

return result["text"]

2. 任务解析和参数传递(ChatGLM)

使用ChatGLM来解析语音识别结果并分解任务,根据任务内容制定行动计划:

from transformers import GPT2LMHeadModel, GPT2Tokenizer

def parse_tasks(text):

tokenizer = GPT2Tokenizer.from_pretrained("gpt2")

model = GPT2LMHeadModel.from_pretrained("gpt2")

inputs = tokenizer.encode(text, return_tensors="pt")

outputs = model.generate(inputs, max_length=50)

return tokenizer.decode(outputs[0], skip_special_tokens=True)

def execute_task(task):

if "安全帽识别" in task:

open_camera_and_detect_helmets()

3. 安全帽识别(YOLOv5)

如果任务需要,调用YOLOv5来识别图像中的安全帽:

import cv2

from yolov5 import detect

def open_camera_and_detect_helmets():

cap = cv2.VideoCapture(0) # 打开摄像头

while True:

ret, frame = cap.read()

if ret:

# 运行YOLOv5模型来识别安全帽

detections = detect.run(weights='yolov5s.pt', imgsz=640, source=frame)

if "helmet" in detections:

print("安全帽识别成功")

cv2.imshow("Camera", frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

4.整合流程

将上述脚本整合到一个系统中,根据语音输入自动执行相关安全检测:

audio_text = transcribe_audio('path_to_audio.mp3')

task = parse_tasks(audio_text)

execute_task(task)

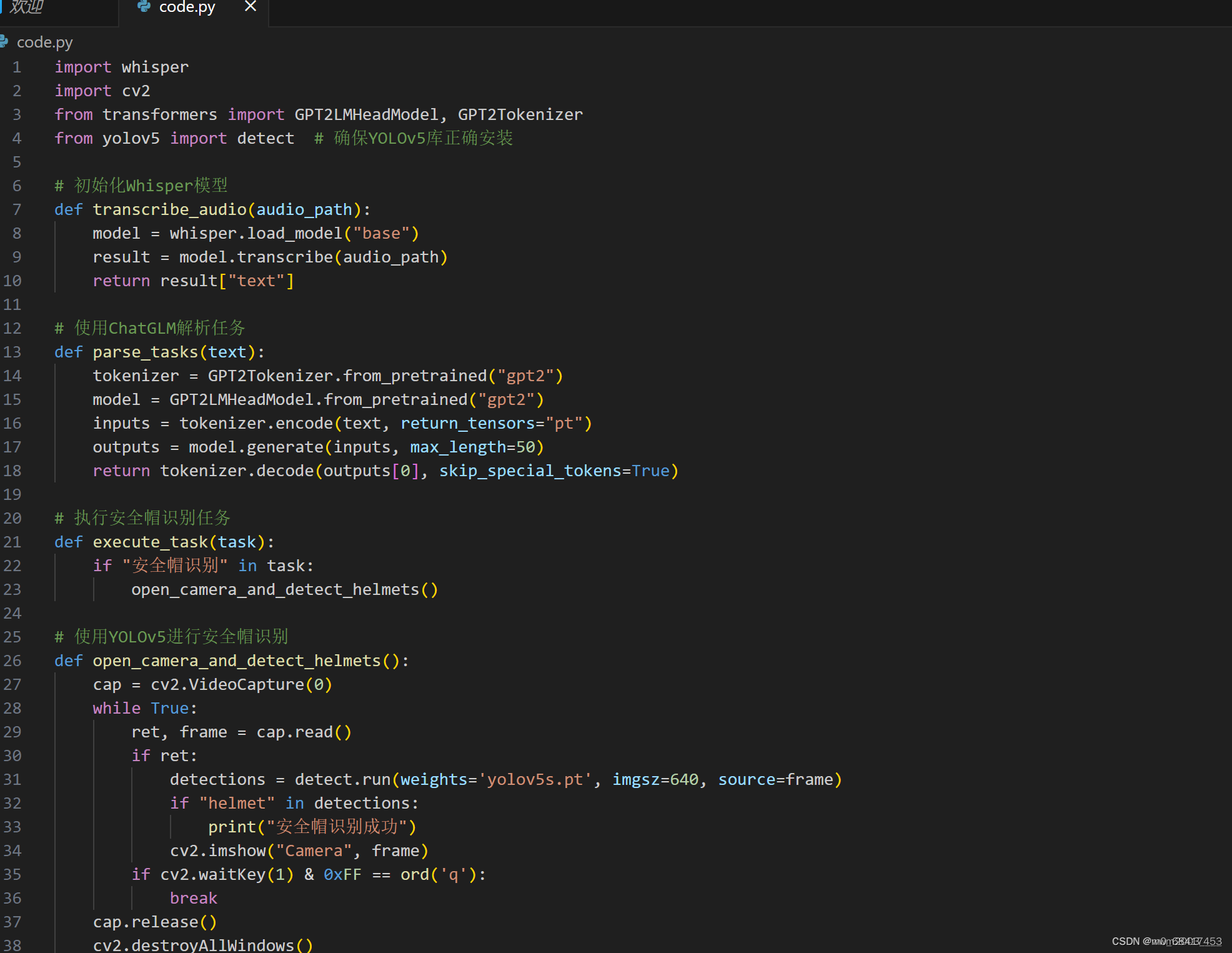

三、根据上述操作和代码展示,加上之前博客中提及的部署以及同组同学有关chatGLM的本地部署

最终可得完整代码:

import whisper

import cv2

from transformers import GPT2LMHeadModel, GPT2Tokenizer

from yolov5 import detect # 确保YOLOv5库正确安装

# 初始化Whisper模型

def transcribe_audio(audio_path):

model = whisper.load_model("base")

result = model.transcribe(audio_path)

return result["text"]

# 使用ChatGLM解析任务

def parse_tasks(text):

tokenizer = GPT2Tokenizer.from_pretrained("gpt2")

model = GPT2LMHeadModel.from_pretrained("gpt2")

inputs = tokenizer.encode(text, return_tensors="pt")

outputs = model.generate(inputs, max_length=50)

return tokenizer.decode(outputs[0], skip_special_tokens=True)

# 执行安全帽识别任务

def execute_task(task):

if "安全帽识别" in task:

open_camera_and_detect_helmets()

# 使用YOLOv5进行安全帽识别

def open_camera_and_detect_helmets():

cap = cv2.VideoCapture(0)

while True:

ret, frame = cap.read()

if ret:

detections = detect.run(weights='yolov5s.pt', imgsz=640, source=frame)

if "helmet" in detections:

print("安全帽识别成功")

cv2.imshow("Camera", frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

# 主程序

def main():

audio_text = transcribe_audio('path_to_audio.mp3')

task = parse_tasks(audio_text)

execute_task(task)

if __name__ == "__main__":

main()

2221

2221

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?