| 文章来源于:“鹅厂技术派”公众号

近期,腾讯混元文生图大模型全面升级并对外开源。目前,企业与个人开发者可以在 Hugging Face 平台及 Github 上,免费获取包含模型权重、推理代码、模型算法等完整模型,并支持商用。

这是业内首个中文原生的DiT架构文生图开源模型,支持中英文双语输入及理解,参数量15亿。

升级后的混元文生图大模型采用了与 sora 一致的DiT架构,不仅可支持文生图,也可作为视频等多模态视觉生成的基础。

评测数据显示,最新的腾讯混元文生图模型效果远超开源的 Stable Diffusion 模型,是目前效果最好的开源文生图模型;整体能力属于国际领先水平。

首个中文原生DiT架构

升级后的腾讯混元文生图大模型采用了全新的DiT架构(DiT,即Diffusion With Transformer),这也是Sora和 Stable Diffusion 3 的同款架构和关键技术,是一种基于Transformer架构的扩散模型。

过去,视觉生成扩散模型主要基于 U-Net 架构,但随着参数量的提升,基于 Transformer 架构的扩散模型展现出了更好的扩展性,有助于进一步提升模型的生成质量及效率。

腾讯混元是业界最早探索并应用大语言模型结合 DiT 结构的文生图模型之一。从 2023 年 7 月起,腾讯混元文生图团队就明确了基于DiT架构的模型方向,并启动了新一代模型研发。今年初,混元文生图大模型已全面升级为DiT架构。

在DiT架构之上,腾讯混元团队在算法层面优化了模型的长文本理解能力,能够支持最多 256 字符的内容输入,达到行业前沿水平。

同时,在算法层面创新实现了多轮生图和对话能力,可实现在一张初始生成图片的基础上,通过自然语言描述进行调整,从而达到更满意的效果。

中文原生也是腾讯混元文生图大模型的一大亮点,此前,像 Stable Diffusion 等主流开源模型核心数据集以英文为主,对中国的语言、美食、文化、习俗都理解不够。混元文生图是首个中文原生的DiT模型,具备中英文双语理解及生成能力,在古诗词、俚语、传统建筑、中华美食等中国元素的生成上表现出色。

评测结果显示,新一代腾讯混元文生图大模型视觉生成整体效果,相比前代提升超过 20%,在语义理解、画面质感与真实性方面全面提升,在多轮对话、多主体、中国元素、真实人像生成等场景下效果提升显著。

攻克多项技术难点

混元文生图从 2023 年 7 月起就明确了基于 Transformer 架构的文生图模型未来会有更大的潜力,并启动了长达半年时间的研发、优化和打磨。

这里存在两大难点:首先,Transformer架构本身并不具备文生图能力;其次,DiT本身对算力和数据量要求极高,文生图领域缺乏高质量的图片描述与图像样本训练数据。

在此背景下,腾讯混元文生图如何做出基于DiT架构的文生图模型?又在原DiT基础上做了哪些改进?

//算法层改进

针对模型算法本身,腾讯混元文生图模型:

● 让DiT架构具备了长文本理解能力:在模型中加入了LLM的组件,该组件能力包括语义理解,以及文生图的扩充和优化。腾讯混元文生图架构支持最长256个字符(业界主流是77个)的图片生成指令;同时利用多模态大语言模型,对简单/抽象的用户指令文本进行强化,转写成更丰富/具象的画面文本描述,最终提升文生图的生成效果。

● 增加了中文原生的理解能力:采用了全套中文原生编码的Clip组件,让模型的中文语义理解能力更强,同时也支持英文。

● 增加多轮对话的能力:让模型具备上下文连贯的理解能力,同时通过技术手段控制同一话题与主体下图片主体的一致性。

//数据质量优化

针对文生图训练数据缺乏、普遍质量不高的问题,腾讯混元团队也通过系统化手段,提升了训练数据的规模与质量。

语言模型数据质量优化

● 构建结构化图片描述能力提升文生图训练数据文本质量,并结合领域专家模型和构建文本注入Caption模型增强图片描述的知识性,提升文生图训练图文数据质量。

● 构建覆盖多维度、多主题的改写指令数据集,通过保障数据的多样性使得改写模型具备较强的泛化性。

图片训练数据处理流程(数据管道)优化

● 对数据分类分层:数据管道利用高效、精准、多元化的打标算子,在图片获取的同时,对图片内容进行理解,将图片的质量进行区分,按图片质量的高低,服务于不同精度的模型

● 制定数据质量评估机制指导数据质量优化:为了给模型提供高质量、类目均衡的样本,同时降低训练数据分布变化带来的风险,腾讯混元文生图团队提出了数据班车的机制,通过对比线上模型与变化样本分布后的模型效果的方式,从主体、风格、场景等多角度评估训练样本改变对模型带来的收益情况,并且形成了可迭代的训练样本调整机制。

//工程加速

为了更好地提升模型训练与运行效率,提升算力资源利用率,腾讯混元文生图团队为该模型构建专属工程加速工具库:

● 工程优化方面,腾讯混元文生图团队通过ONNX图优化减少冗余操作和显存消耗、通过优化kernel及融合算子减少计算量、内存访问以及预计算中间结果,降低实时计算需求,提高计算效率。

● 数据构造方面,腾讯混元文生图团队通过数据筛选保证蒸馏过程中整体数据分布与蒸馏前近似性,并重点挑选高质量数据以满足对细节质感要求高的场景。

● 模型蒸馏方面,腾讯混元文生图团队采用自研的基于渐进式蒸馏的方法,确保训练过程的稳定性、准确性的同时保证可扩展性,合理控制压缩成本和压缩效率,实现经济高效的模型压缩。

同时,针对大模型训练和推理场景,腾讯自研了Angel机器学习平台,主要包含负责训练的AngelPTM和负责推理的AngelHCF两大部分。其中,AngelPTM训练速度相比主流开源框架提升 1.6倍,AngelHCF推理速度相比业界主流框架提升 1.3倍。

可以把机器学习平台比作一条多车道的高速公路,大模型就像许许多多的重型卡车,可以在高速公路上高速行驶;相比之下,较落后的技术平台就像是乡间的泥泞小道,只通行一辆小车也颠簸、缓慢。

腾讯混元文生图大模型就是基于Angel机器学习平台进行训练,大幅提升了训练效率。

--效果提升明显--

细粒度语义理解(语义理解准确,准确性提升,同时画面质感提升)

“一只长靴猫手持亮银色的宝剑,身着铠甲,眼神坚毅,站在一堆金币上,背景是暗色调的洞穴,图像上有金币的光影点缀。”

复杂语义理解&质感提升

“一张细致的照片捕捉到了一尊雕像的形象,这尊雕像酷似一位古代法老,头上出人意料地戴着一副青铜蒸汽朋克护目镜。这座雕像穿着复古时髦,清爽的白色T恤和合身的黑色皮夹克,与传统的头饰形成鲜明对比。背景是简单的纯色,突出了雕像的非传统服装和蒸汽朋克眼镜的复杂细节。”

人像真实感与画面质感

“中年亚洲男性穿着休闲装在办公室中微笑着,他的表情充满自信,展现出优雅的气质。”

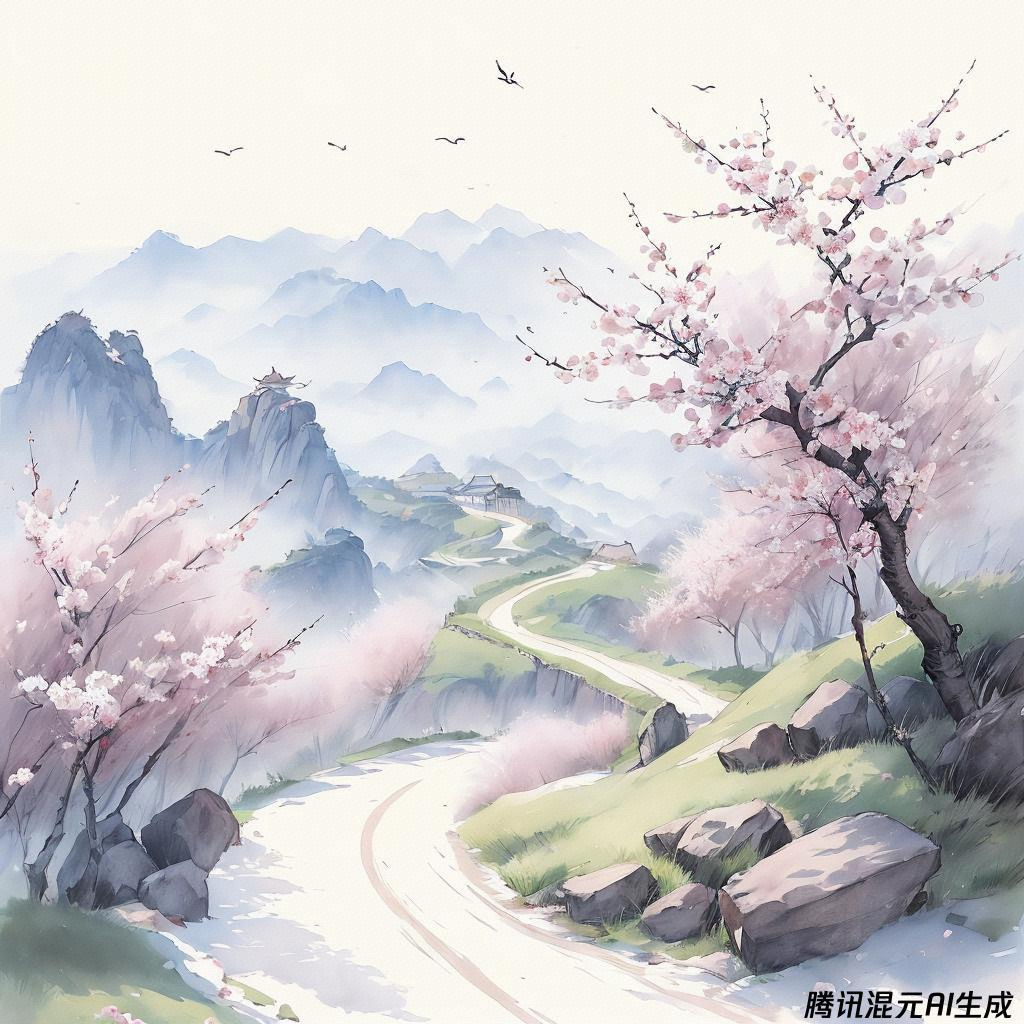

中国元素

“水墨画,一条蜿蜒的山径,杏花如雪般铺满道路两侧,花瓣随风飘落,显得格外美丽,背景是春天的山野,镜头是中景。”

多轮对话

多轮对话效果展示

无需从头训练,便可打造专属的AI应用

基于此次开源的文生图模型,开发者及企业无需从头训练,即可直接用于推理,并可基于混元文生图打造专属的AI绘画应用及服务,能够节约大量人力及算力。透明公开的算法,也让模型的安全性和可靠性得到保障。

同时,基于开放、前沿的混元文生图基础模型,将有利于在以 Stable Diffusion 等为主的英文开源社区之外,丰富以中文为主的文生图开源生态,形成更多样的原生插件,推动中文文生图技术研发和应用。

实际上,腾讯混元文生图能力,已经广泛被用于素材创作、商品合成、游戏出图等多项业务及场景中。

今年初,腾讯广告基于腾讯混元大模型,发布了一站式 AI 广告创意平台腾讯广告妙思,可为广告主提供文生图、图生图、商品背景合成等多场景创意工具,有效提高了广告生产及投放效率。《央视新闻》《新华日报》《深圳特区报》《南方都市报》《羊城晚报》等20余家媒体,也已经将腾讯混元文生图用于新闻内容生产。

“腾讯混元文生图的研发思路就是实用,坚持从实践中来,到实践中去。此次把最新一代模型完整开源出来,是希望与行业共享腾讯在文生图领域的实践经验和研究成果,丰富中文文生图开源生态,共建下一代视觉生成开源生态,推动大模型行业加速发展。”腾讯文生图负责人芦清林表示。

目前,腾讯已开源了超 170 个优质项目,均来源于腾讯真实业务场景,覆盖微信、腾讯云、腾讯游戏、腾讯AI、腾讯安全等核心业务板块,目前在Github上已累计获得超 47 万开发者关注及点赞。

——完——

记得关注我们,及时接收精彩内容哦~

公众号/视频号:腾讯太极机器学习平台

腾讯太极机器学习平台,致力于让用户更加聚焦业务AI问题解决和应用,一站式解决算法工程师在应用过程中特征处理、模型训练、模型服务等工程问题。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?