作为一名运维人员,每天面对各种各样的告警,有很多根本不知道什么原因,无从下手。针对这个痛点,决定使用大模型作为辅助工具,将告警问题输出给它,让它给你反馈指导意见。

一、本地部署大模型

本次大模型的部署使用了一款开源工具ollama,这个工具很火,大家可以多了解一下哦。

下载地址:https://ollama.com/

进入页面后可以看到Download字样(个人觉得这点比好多网站都方便很多,一眼就知道那里能下载)根据你自己的环境进行下载,我这里选择了window版本的。其他版本官方也给了详细的部署说明。

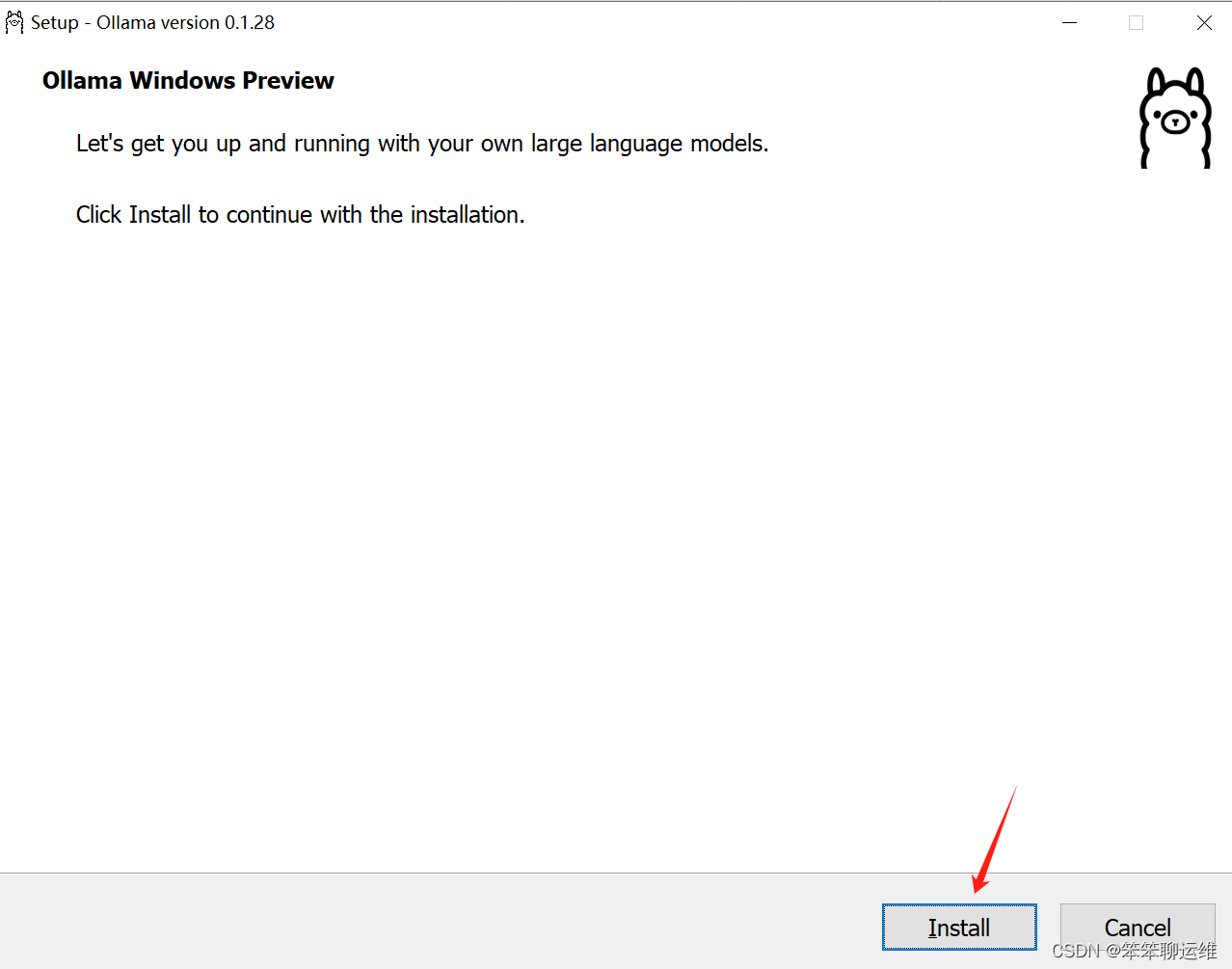

双击打开后,直接点击install即可。

安装完成后打开电脑的cmd,输入如下命令

ollama pull 你要使用的模型

ollama run 你的模型

例如我安装qwen,则命令如下

①ollama pull qwen:4b #拉取模型

②ollama run qwen:4b #运行模型

#ollama中支持多种模型,可以在官网查看大模型获取界面

本文介绍了一种使用Zabbix结合AI大模型解决运维告警问题的方法。首先,通过ollama工具在本地部署大模型,然后配置Zabbix进行监控。接着,设置邮箱并授权用于告警通知。利用Python脚本创建告警动作,当Zabbix触发告警时,脚本会将问题发送给大模型获取反馈。最后,调整告警配置并展示效果。

本文介绍了一种使用Zabbix结合AI大模型解决运维告警问题的方法。首先,通过ollama工具在本地部署大模型,然后配置Zabbix进行监控。接着,设置邮箱并授权用于告警通知。利用Python脚本创建告警动作,当Zabbix触发告警时,脚本会将问题发送给大模型获取反馈。最后,调整告警配置并展示效果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2249

2249

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?