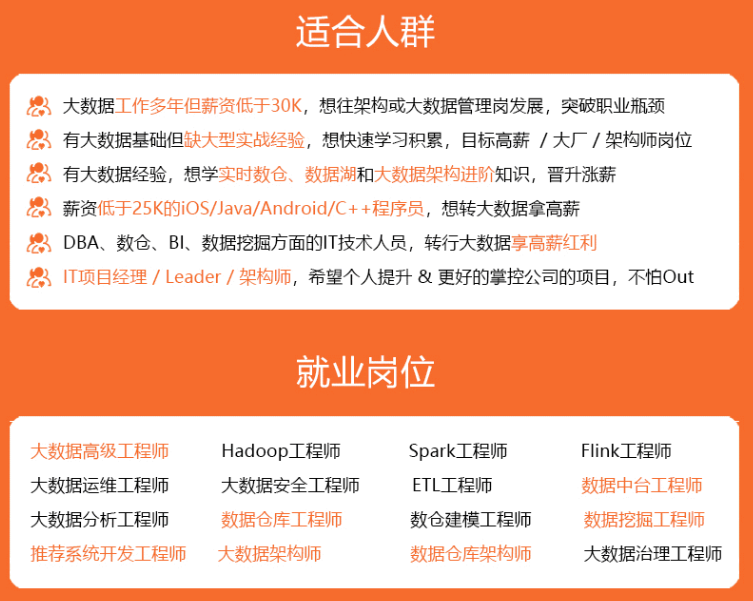

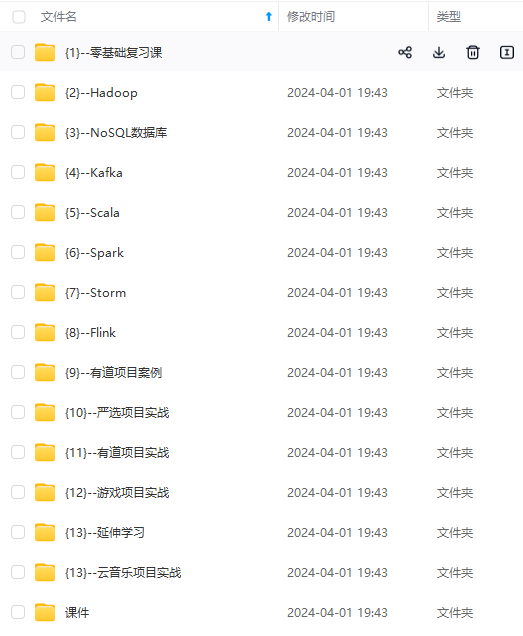

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

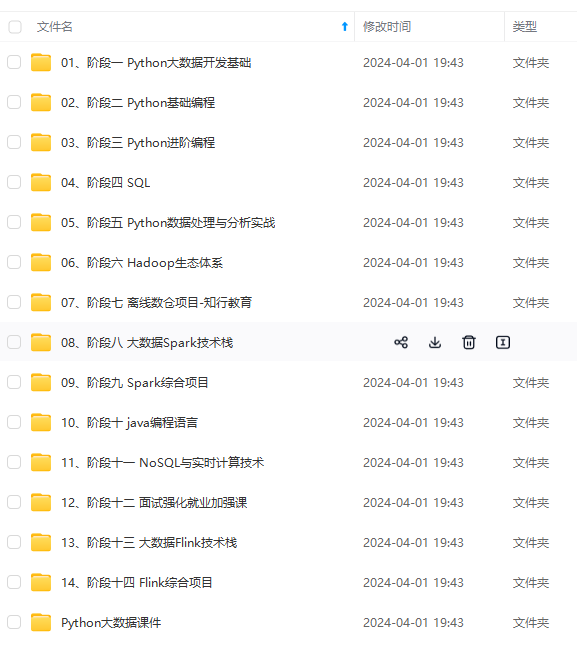

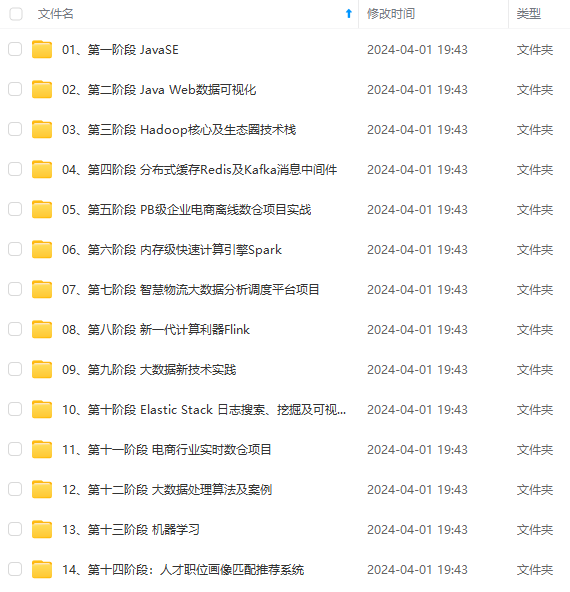

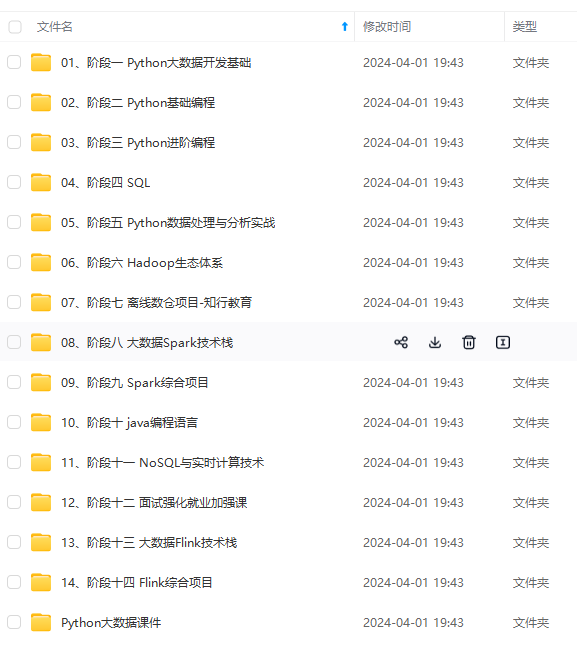

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

hadoop dfs -put E:/hadoop/myfile /test_dir

此时HDFS中test_dir文件层次结构:

hdfs dfs -ls -R /test_dir

如图:

3、使用Hadoop自带的hadoop-mapreduce-examples-2.8.3.jar程序包统计myfile目录下f1,f2,f3三个文件的单词数。hadoop-mapreduce-examples-2.8.3.jar位于hadoop-2.8.3\share\hadoop\mapreduce下面。

命令:

hadoop jar E:/hadoop/hadoop-2.8.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-2.8.3.jar wordcount /test_dir/myfile /test_dir/result

wordcount是hadoop-mapreduce-examples-2.8.3.jar的主类名。

/test_dir/myfile是jar程序包要统计的文件目录(若是具体的文件,则统计单个文件的单词数;若是文件夹,则统计该文件夹下所有文件中包含的单词数)。

/test_dir/result是最终存放统计结果的目录。注意,/test_dir/result目录必须是先前不存在的,让程序jar包运行时创建。

运行成功后,则会在result目录下生成两个文件:

其中part-r-00000文件存放了最终的统计结果,使用命令查看:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?