〔更多精彩AI内容,尽在 「魔方AI空间」 ,引领AIGC科技时代〕

本文作者:猫先生

引言:当AI开始“理解”真实世界

从自回归视频生成到跨模态3D头像重建,2025年的开源技术浪潮正以惊人的速度突破想象力边界。这些突破不仅降低了AI创作的门槛,更让“生成”从单模态走向多维度协同——视频、图像、3D、语言的界限正在消失。

本文精选12项重磅开源技术,揭开AI生成范式革命的神秘面纱。

一、视频生成的范式革命:从逐帧创作到智能涌现

1、MAGI-1:国产自回归视频的“逻辑推理”突破

通过算法创新与专用算力架构,MAGI-1实现了视频块序列的自回归预测。不同于传统逐帧生成,其动态上下文建模能力让视频内容具备逻辑连贯性,为影视级内容生产提供新可能。

🔗项目主页:https://github.com/SandAI-org/Magi-1

2、Phantom:角色一致性的“记忆移植”

跨模态对齐技术让Phantom能记住角色特征——无论是单主体换装还是多人物互动,生成的视频始终保持身份一致性。这项技术特别适用于虚拟偶像、数字人直播等场景。

🔗项目主页:https://github.com/Phantom-video/Phantom

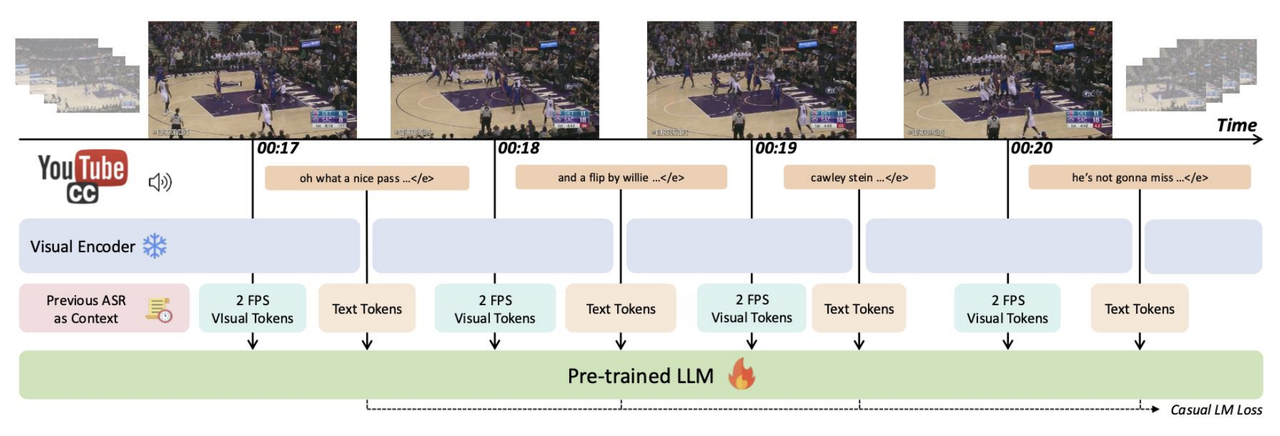

3、LiveCC:实时视频评论的“流式大脑”

通过流式语音转录与大规模预训练,LiveCC可实时生成视频解说、问答互动,甚至实现弹幕与画面的语义匹配。教育、直播领域或将迎来互动体验升级。

🔗项目主页:https://showlab.github.io/livecc/

二、多模态大模型的“智力竞赛”

4. Qwen3:MoE架构的“效率革命”

阿里最新Qwen3采用混合专家模型,通过动态路由分配计算资源,在保持多语言能力的同时,推理效率提升40%。其灵活的思维链设计,让复杂问题解决能力更接近人类专家。

🔗项目主页:https://github.com/QwenLM/Qwen3

5. Gemini 2.5 Pro:长上下文的“知识捕手”

支持200万token上下文窗口的Gemini 2.5 Pro,不仅能解析长篇小说,还能跨网页、图表、代码等多模态信息进行推理,堪称AI界的“文献综述大师”。

🔗项目主页:https://blog.google/technology/google-deepmind/gemini-model-thinking-updates-march-2025

三、图像生成的“可控性”突破

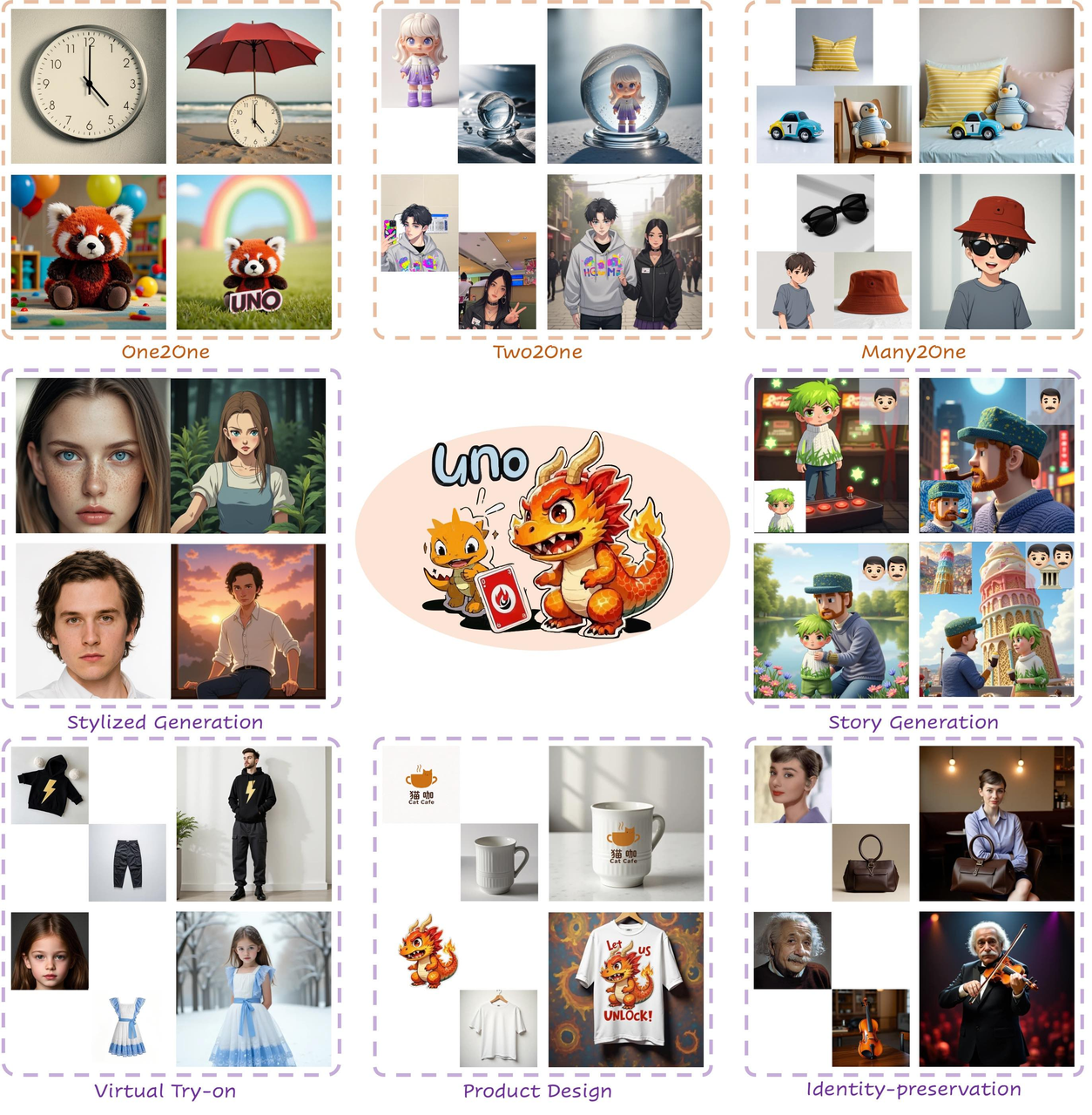

6. UNO框架:从单主体到多主体的“秩序革命”

字节跳动的UNO通过渐进式跨模态对齐,攻克多主体场景的一致性难题。无论是全家福合影还是复杂机械结构图,都能实现元素间的空间关系协调。

🔗项目主页:https://github.com/bytedance/UNO

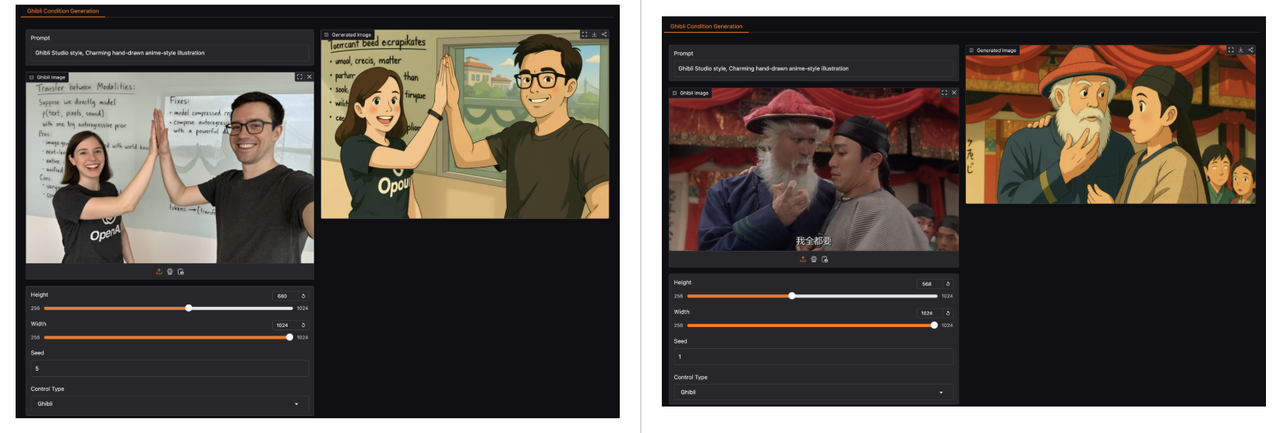

7. EasyControl:吉卜力美学的“基因编码”

仅用100张真实亚洲面孔训练,该模型成功捕捉吉卜力动画的色彩美学与面部特征,在二次元创作与虚拟偶像领域潜力巨大。

🔗项目主页:https://github.com/Xiaojiu-z/EasyControl.git

四、3D与动画的“平民化”进程

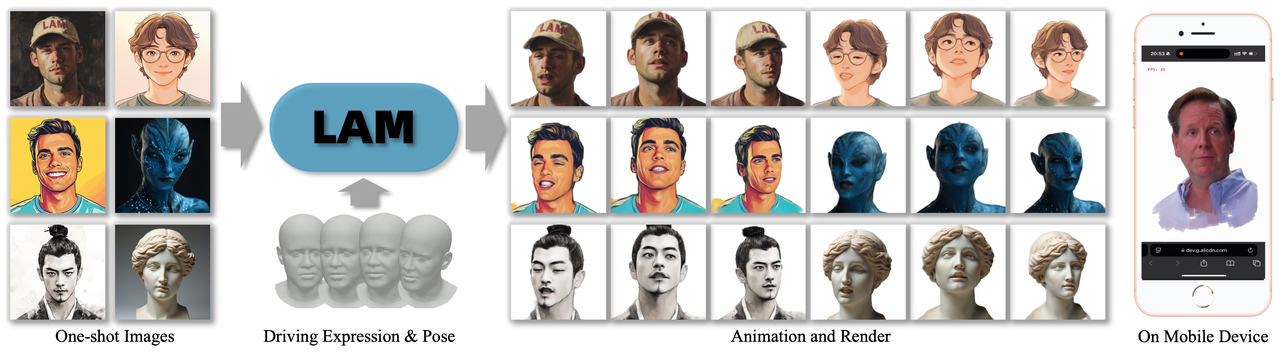

8. LAM:单图生成“可动灵魂”

中科院团队开发的LAM,仅需一张图片即可生成高斯风格3D可动画头像,且支持实时渲染。从游戏角色到虚拟主播,创作周期从周级压缩至分钟级。

🔗项目主页:https://aigc3d.github.io/projects/LAM/

9. DreamActor-M1:动画师的“数字分身”

通过DiT框架混合引导,该技术实现从微表情到全身动作的细粒度控制。生成的动画不仅保持身份特征,还能适配不同艺术风格。

🔗项目主页:https://github.com/HiDream-ai/HiDream-I1

五、降低创作门槛的“基础设施革命”

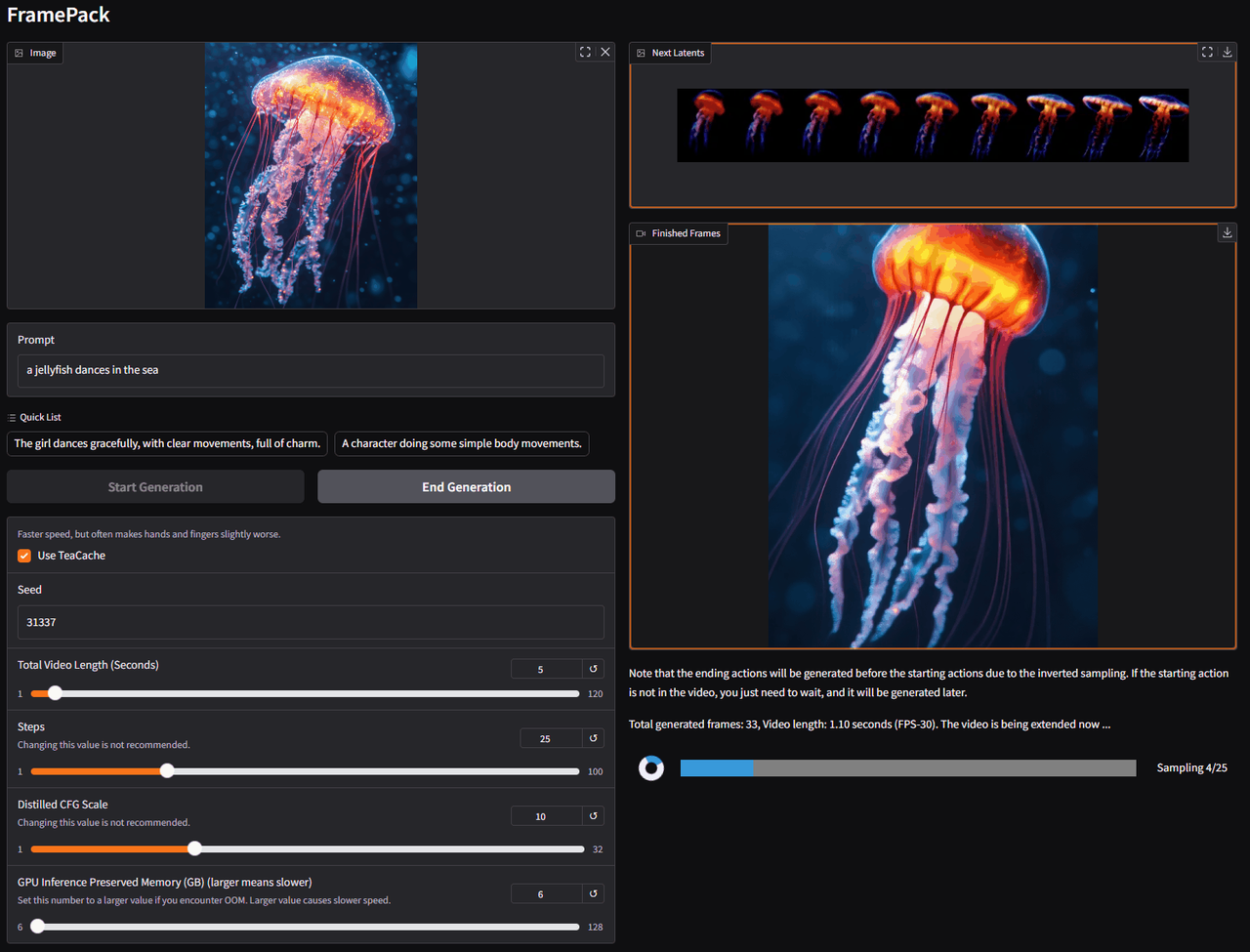

10. FramePack:消费级显卡的“千帧奇迹”

ControlNet作者Lvmin Zhang的杰作,通过动态分辨率优化与梯度累积技术,6GB显存即可生成4K视频。这意味着普通玩家也能体验AI视频创作。

🔗项目主页:https://github.com/lllyasviel/FramePack

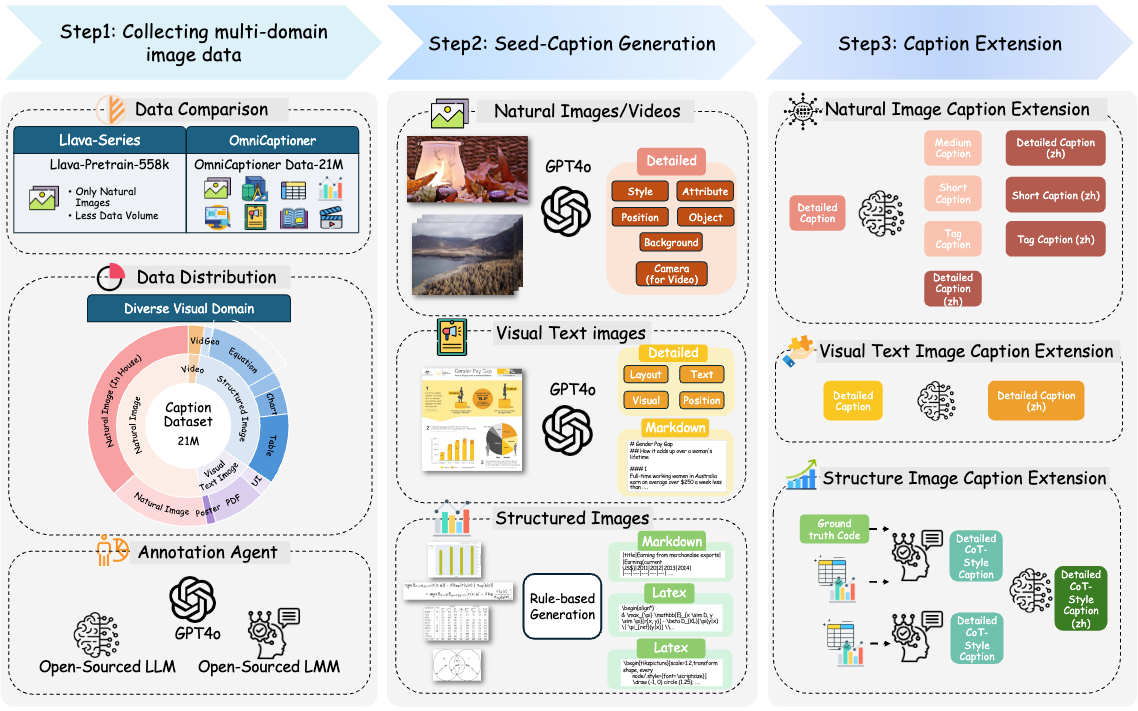

11. OmniCaptioner:视觉世界的“翻译官”

不仅能描述图像内容,还能解析结构化图表、医学影像等专业视觉数据,生成带逻辑关系的多模态文本,赋能无障碍技术研究。

🔗项目主页:https://alpha-innovator.github.io/OmniCaptioner-project-page/

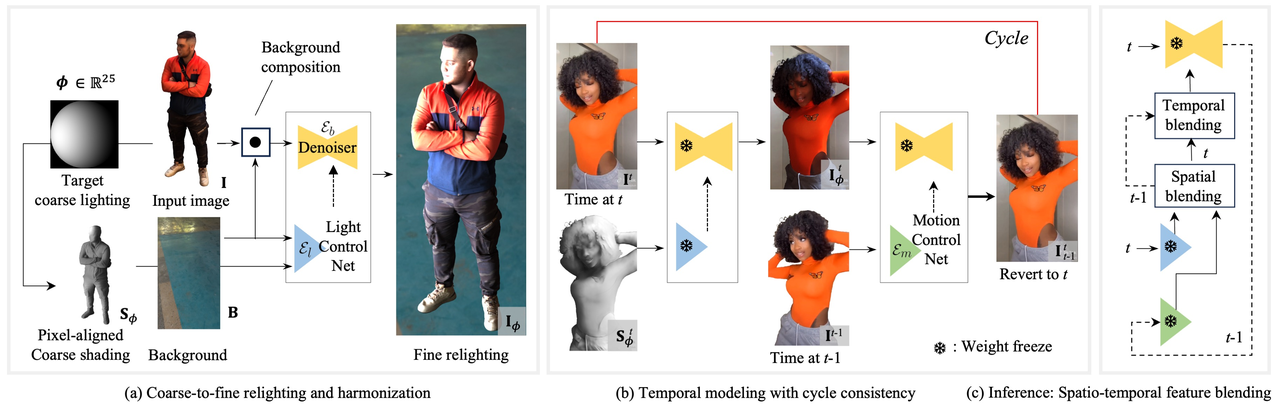

12、Comprehensive Relighting,一种用于重新照明和协调的通用且一致的模型

Comprehensive Relighting 是一种通用且一致的单眼人体重新照明和协调模型,能够从单张图像或视频中控制和协调任意身体部位的照明,并使其与背景场景完美融合。

🔗项目主页:https://github.com/QwenLM/QwQ

结语:开源生态正在重写AI规则

当MAGI-1用自回归模型解构视频创作,当Qwen3用MoE架构突破算力瓶颈,当LAM让3D建模走入平民时代——我们看到的不仅是技术突破,更是AI创作民主化的浪潮。这些开源项目正构建起一个“生成即服务”的新生态:开发者可以自由组合技术模块,创作者能低成本实现创意,而行业应用正在各个垂直领域加速落地。

正如控制论之父维纳所言:“技术的终极目标,是扩展人类能力。”当开源社区持续降低AI生成的技术壁垒,或许我们正在见证“人机协同”创作范式的真正到来。

立即探索这些黑科技

关注「魔方AI空间」和「魔方开源工坊」公众号,获取AGI技术深度解析与行业洞察。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?